セットアップなしで Weave 上で Groq モデルを試したい場合は、LLM Playground をお試しください。

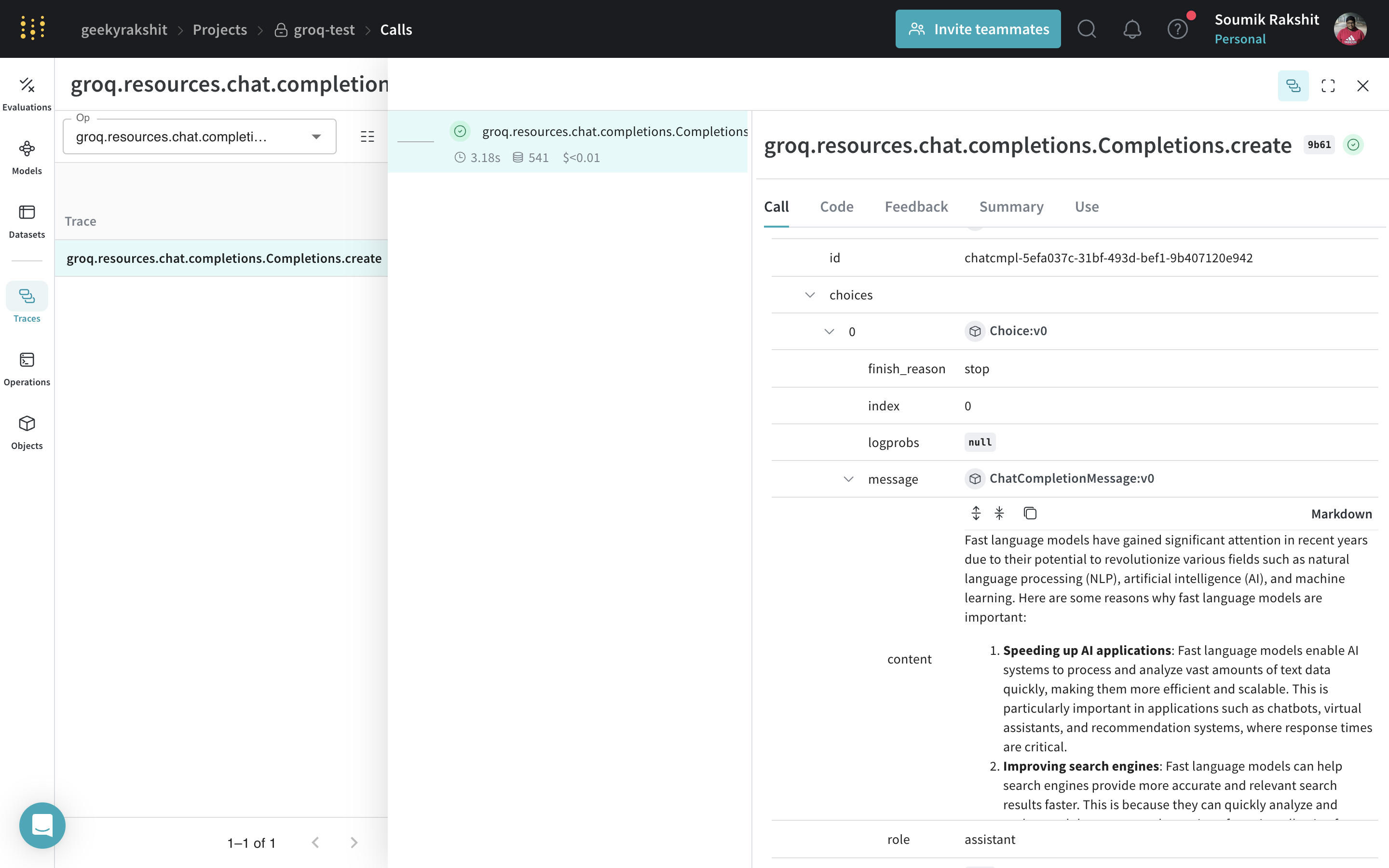

トレース

weave.init(project_name="<YOUR-WANDB-PROJECT-NAME>") を呼び出し、その後は通常どおりライブラリを使用してください。

|

|---|

| Weave は、Groq ライブラリ経由で行われたすべての LLM 呼び出しを追跡してログに記録します。トレースは Weave の Web インターフェースから確認できます。 |

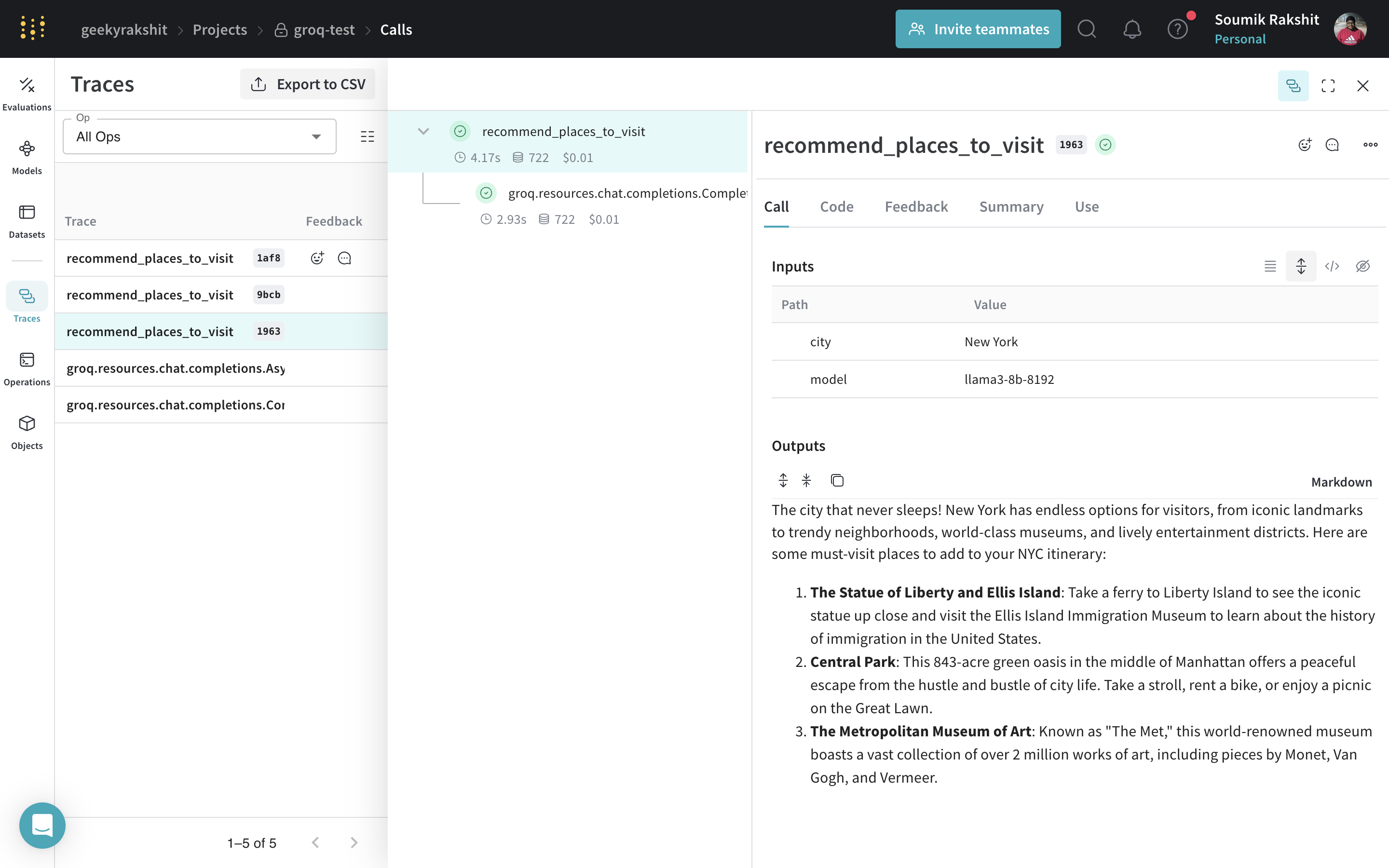

独自の op をトラッキングする

@weave.op でラップすると、入力・出力およびアプリのロジックのキャプチャが始まり、アプリ内をデータがどのように流れているかをデバッグできるようになります。op を深くネストして、トラッキングしたい関数のツリーを構築できます。これにより、git にコミットされていないアドホックな変更や細かな情報も含めて、実験を進める中でコードのバージョン管理が自動的に行われます。

@weave.op でデコレートされた関数を作成するだけです。

次の例では、都市内で訪れるべき場所を推薦する、@weave.op でラップされた関数 recommend_places_to_visit を使用しています。

|

|---|

recommend_places_to_visit 関数にデコレータ @weave.op を付与すると、その関数の入力と出力、および関数内部で行われるすべての LM 呼び出しがトレースされます。 |

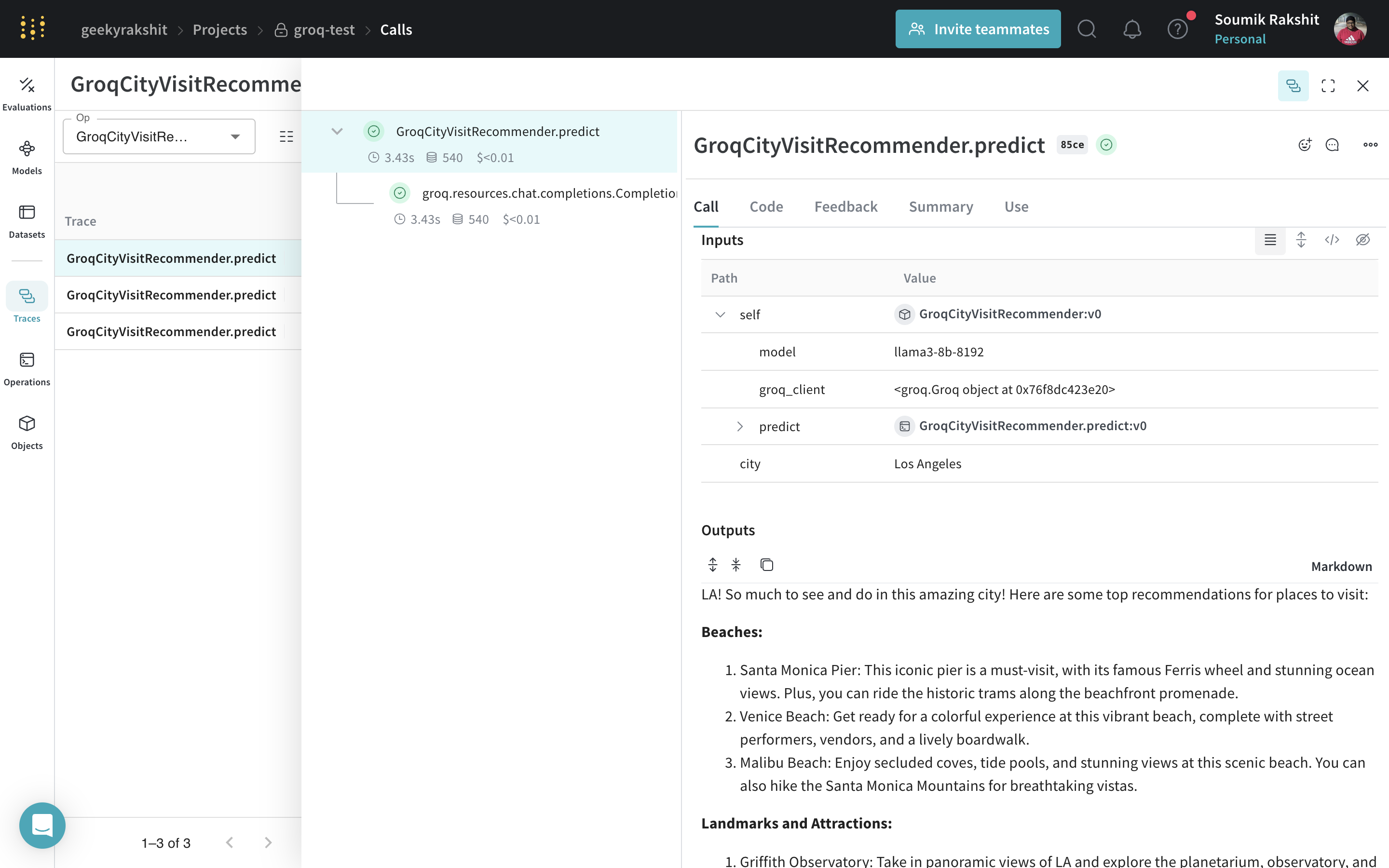

より簡単に実験するために Model を作成する

Model クラスを使うと、システムプロンプトや使用しているモデルなど、アプリの実験に関する詳細を記録・整理できます。これにより、アプリのさまざまなバージョンやイテレーションを整理して比較しやすくなります。

コードのバージョン管理や入出力の記録に加えて、Model はアプリケーションの動作を制御する構造化されたパラメータも保持するため、どのパラメータが最も有効だったかを簡単に見つけられます。また、Weave Models を serve や Evaluation と組み合わせて使用することもできます。

次の例では、GroqCityVisitRecommender を使って実験できます。これらのいずれかを変更するたびに、新しい GroqCityVisitRecommender の バージョン が作成されます。

|

|---|

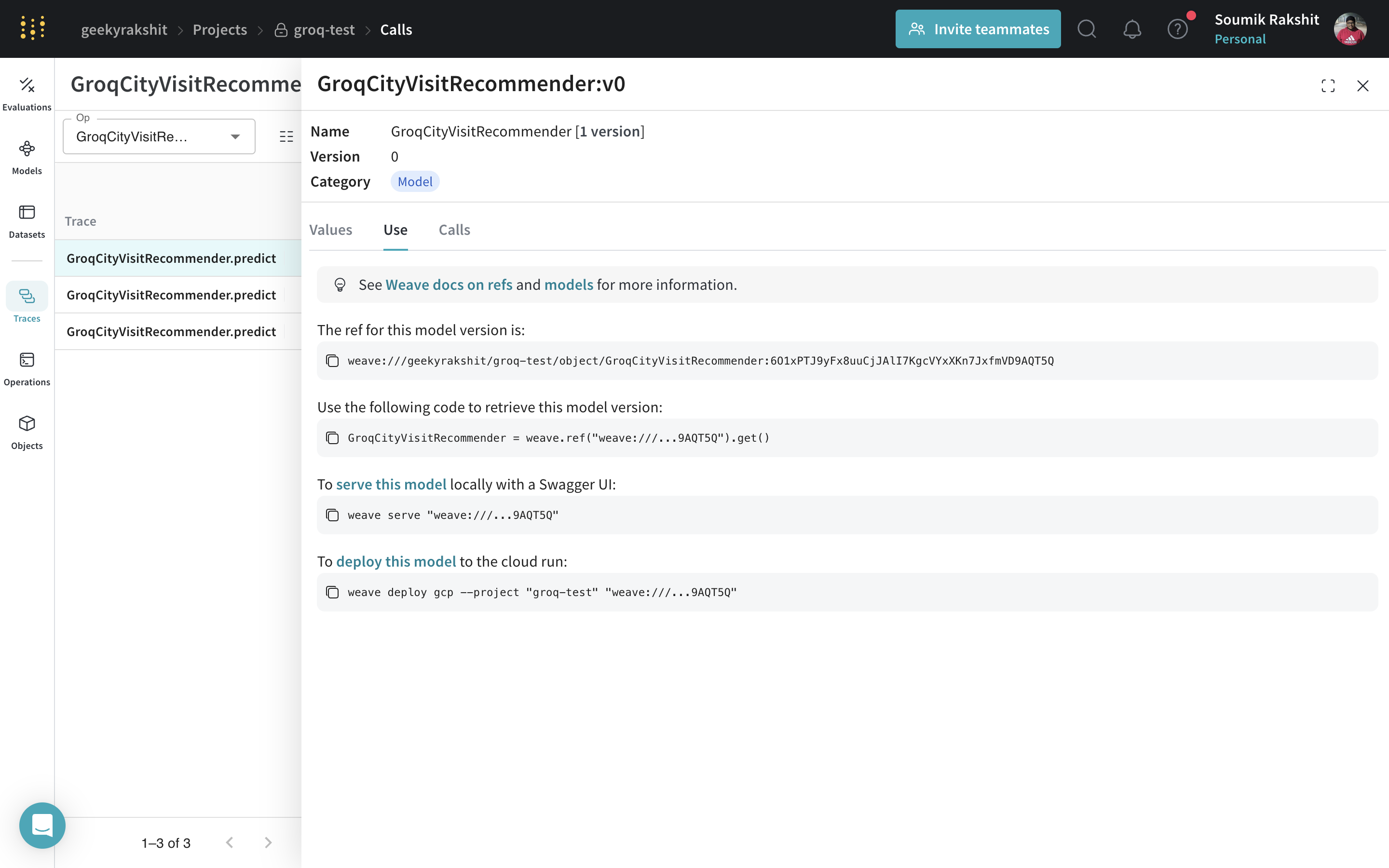

Model を使用した呼び出しのトレースとバージョン管理 |

Weave モデルの提供

weave.Model オブジェクトへの weave リファレンスがあれば、FastAPI サーバーを起動して、そのモデルをサーブできます。

ターミナルで次のコマンドを実行して、モデルをサーブできます: