学習内容

- コード内で Weave をインポートして設定する

weave.opデコレーターを使ってコードを追跡する- Weave UI でトレースを表示する

前提条件

- W&B アカウント

- Python 3.8 以上または Node.js 18 以上

- 必要なパッケージがインストールされていること:

- Python:

pip install weave openai - TypeScript:

npm install weave openai

- Python:

- 環境変数として設定した OpenAI の APIキー

新しいプロジェクトにトレースを記録する

weaveライブラリをコードにインポートします。- コード内で

weave.init('your_wb_team/project_name')を呼び出し、トラッキング情報を W&B の team と project に送信します。team を設定しない場合、トレースはあなたのデフォルト team に送信されます。指定した project が team 内に存在しない場合、Weave が新しく作成します。 - トラッキングしたい特定の関数に

@weave.op()デコレータ を追加します。Weave はサポートされている LLM への呼び出しを自動的にトラッキングしますが、Weave のデコレータを追加すると、特定の関数の入力、出力、およびコードをトラッキングできます。デコレータは TypeScript では次の構文を使用します:weave.op(your_function)

- Python

- TypeScript

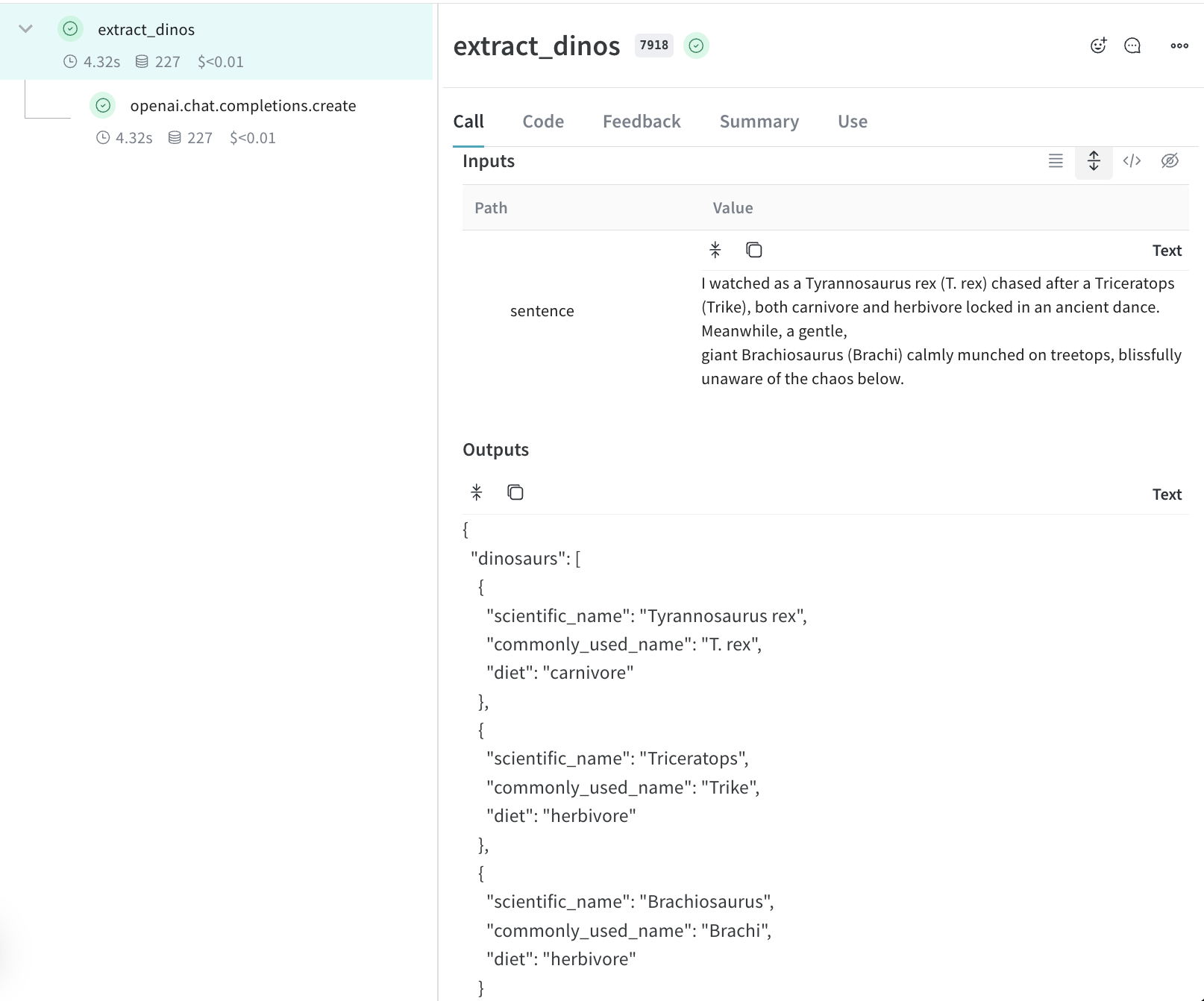

extract_dinos 関数を呼び出すと、Weave はターミナルにトレースを表示するためのリンクを出力します。出力は次のようになります:

アプリケーションのトレースをプロジェクト内で確認する

Traces についてさらに詳しく知る

- 関数をデコレートして呼び出し情報を取得する方法を学びましょう。

- ログされたトレース上でさまざまなモデルを試すには Playground を使ってください。

- インテグレーションを確認する。Weave は OpenAI、Anthropic をはじめとする多くの LLM ライブラリへの呼び出しを自動的にトラッキングします。使用している LLM ライブラリが現在のインテグレーションに含まれていない場合でも、

@weave.op()でラップすることで、他の LLM ライブラリやフレームワークへの呼び出しを簡単にトラッキングできます。