新しい Mistral v1.0 SDK をサポートしています。マイグレーションガイドはこちらをご覧ください。

トレース

weave.init() を呼び出します。

独自の op でラップする

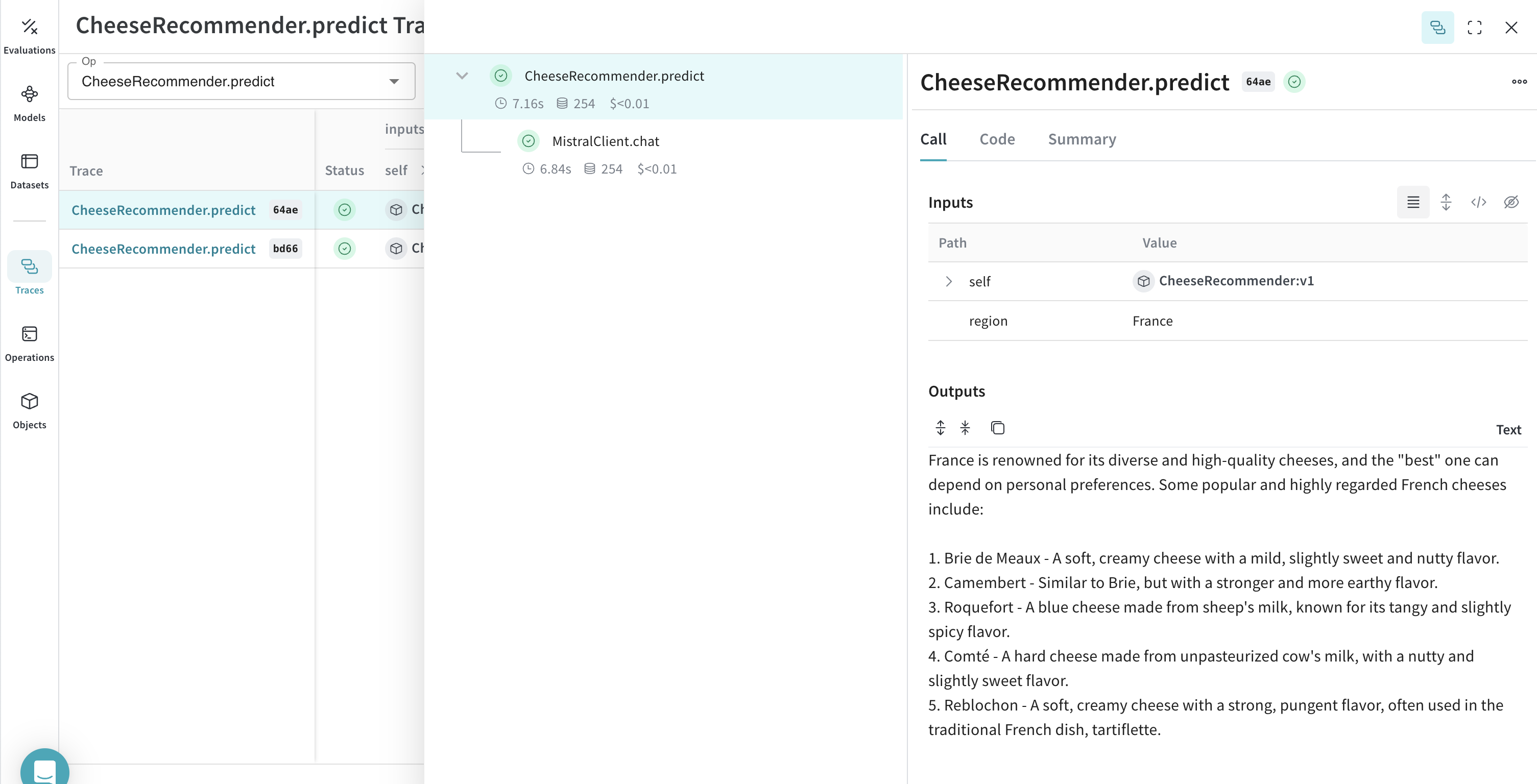

@weave.op() でデコレートした関数を作り、その中で mistralai.client.MistralClient.chat() を呼び出せば、Weave が入出力を自動で追跡します。このチーズレコメンダーで、これをどのように行うか見てみましょう。

実験をしやすくするために Model を作成する

Model クラスを使うと、システムプロンプトや使用しているモデルなど、アプリの実験に関する詳細を記録・整理できます。これにより、アプリのさまざまなイテレーションを体系的に整理し、比較しやすくなります。

コードのバージョン管理や入出力の記録に加えて、Model はアプリケーションの動作を制御する構造化パラメータも保持するため、どのパラメータが最も有効だったかを簡単に見つけることができます。Weave Models は serve や Evaluation と組み合わせて使うこともできます。

次の例では、model と country を変えて実験できます。これらのどちらかを変更するたびに、CheeseRecommender の新しい バージョン が作成されます。