- Quick access: Weave のサイドバー メニューから「Playground」を開いて新しいセッションを開始するか、Call ページから既存のプロジェクトをテストします。

- Message controls: チャット内でメッセージを直接編集、再試行、削除できます。

- Flexible messaging: 新しいメッセージをユーザー入力またはシステム入力として追加し、LLM に送信できます。

- Customizable settings: 好みの LLM プロバイダーを設定し、モデル設定を調整します。

- Multi-LLM support: チームレベルの APIキー の管理のもと、モデルを切り替えることができます。

- Compare models: 異なるモデルがプロンプトにどのように応答するかを比較できます。

- Custom providers: カスタムモデル向けに、OpenAI 互換の API エンドポイントをテストします。

- Saved models: ワークフローで再利用できるモデルプリセットを作成・設定します。

- プロバイダーの認証情報と詳細を追加する

- Playground にアクセスする

- LLM を選択する

- Playground の設定をカスタマイズする

- メッセージコントロール

- LLM を比較する

- カスタムプロバイダー

- 保存済みモデル

プロバイダの認証情報および各種情報を追加する

- Amazon Bedrock:

AWS_ACCESS_KEY_IDAWS_SECRET_ACCESS_KEYAWS_REGION_NAME

- Anthropic:

ANTHROPIC_API_KEY - Azure:

AZURE_API_KEYAZURE_API_BASEAZURE_API_VERSION

- Deepseek:

DEEPSEEK_API_KEY - Google:

GEMINI_API_KEY - Groq:

GROQ_API_KEY - Mistral:

MISTRAL_API_KEY - OpenAI:

OPENAI_API_KEY - X.AI:

XAI_API_KEY

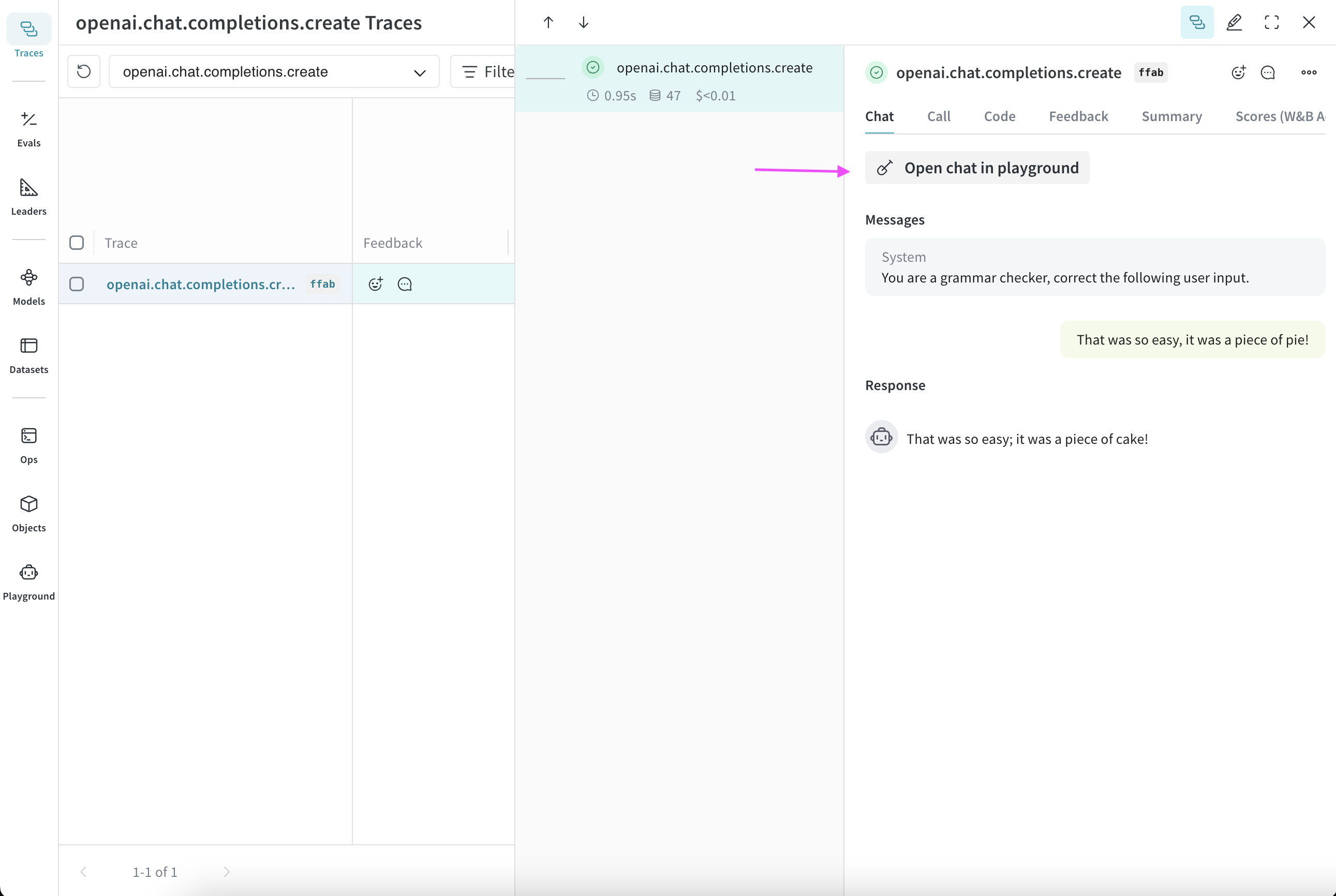

Playground にアクセスする

- シンプルなシステムプロンプト付きで新しい Playground ページを開く: Weave プロジェクトのサイドバーで Playground を選択します。Playground が同じタブで開きます。

- 特定の呼び出し用の Playground を開く:

- サイドバーで Traces タブを選択します。トレースの一覧が表示されます。

- トレースの一覧で、表示したい呼び出しの名前をクリックします。呼び出しの詳細ページが開きます。

- Open chat in Playground をクリックします。Playground が新しいタブで開きます。

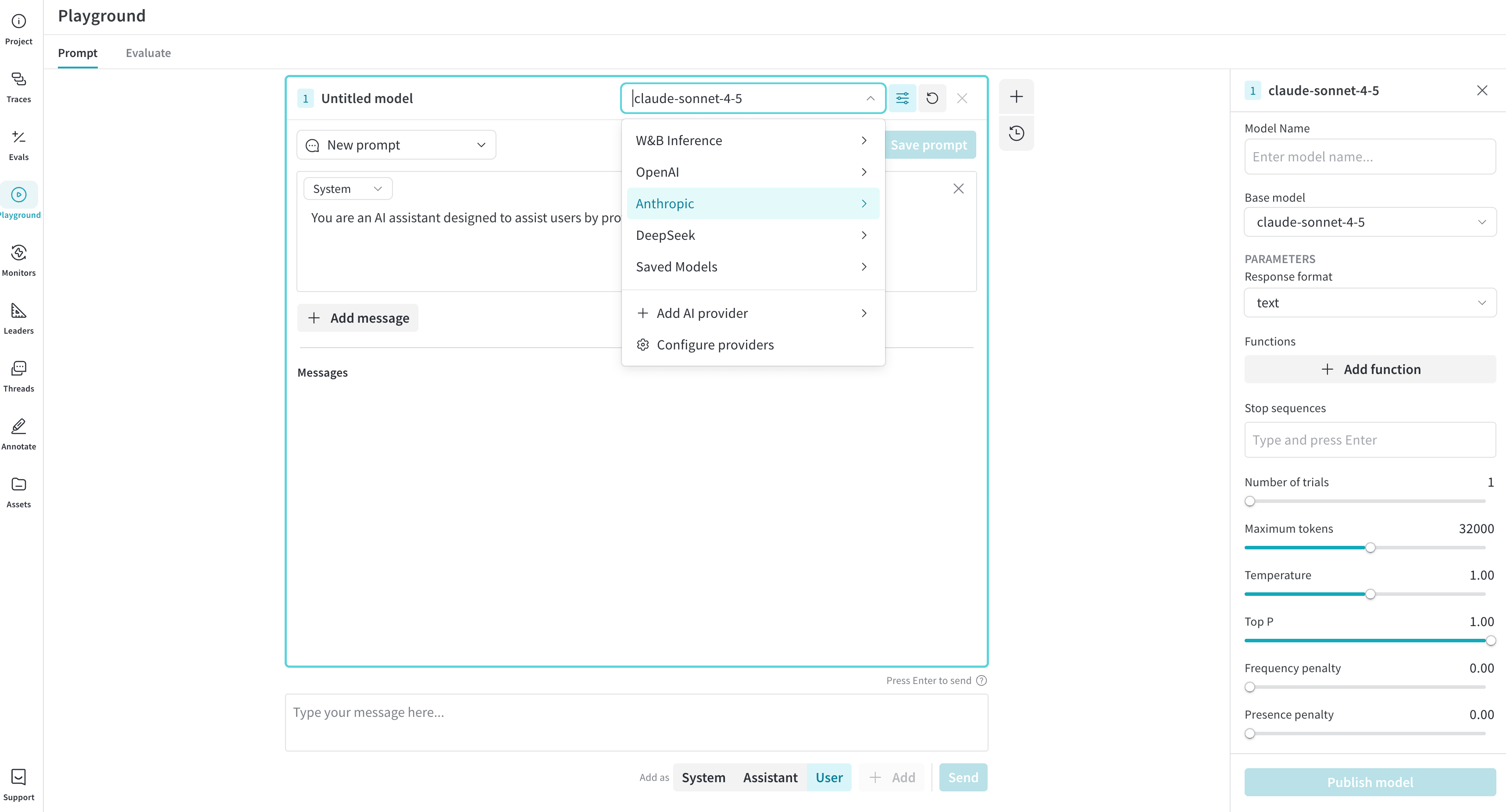

LLM を選択する

- Amazon Bedrock

- Anthropic

- Azure

- Deepseek

- Groq

- Mistral

- OpenAI

- X.AI

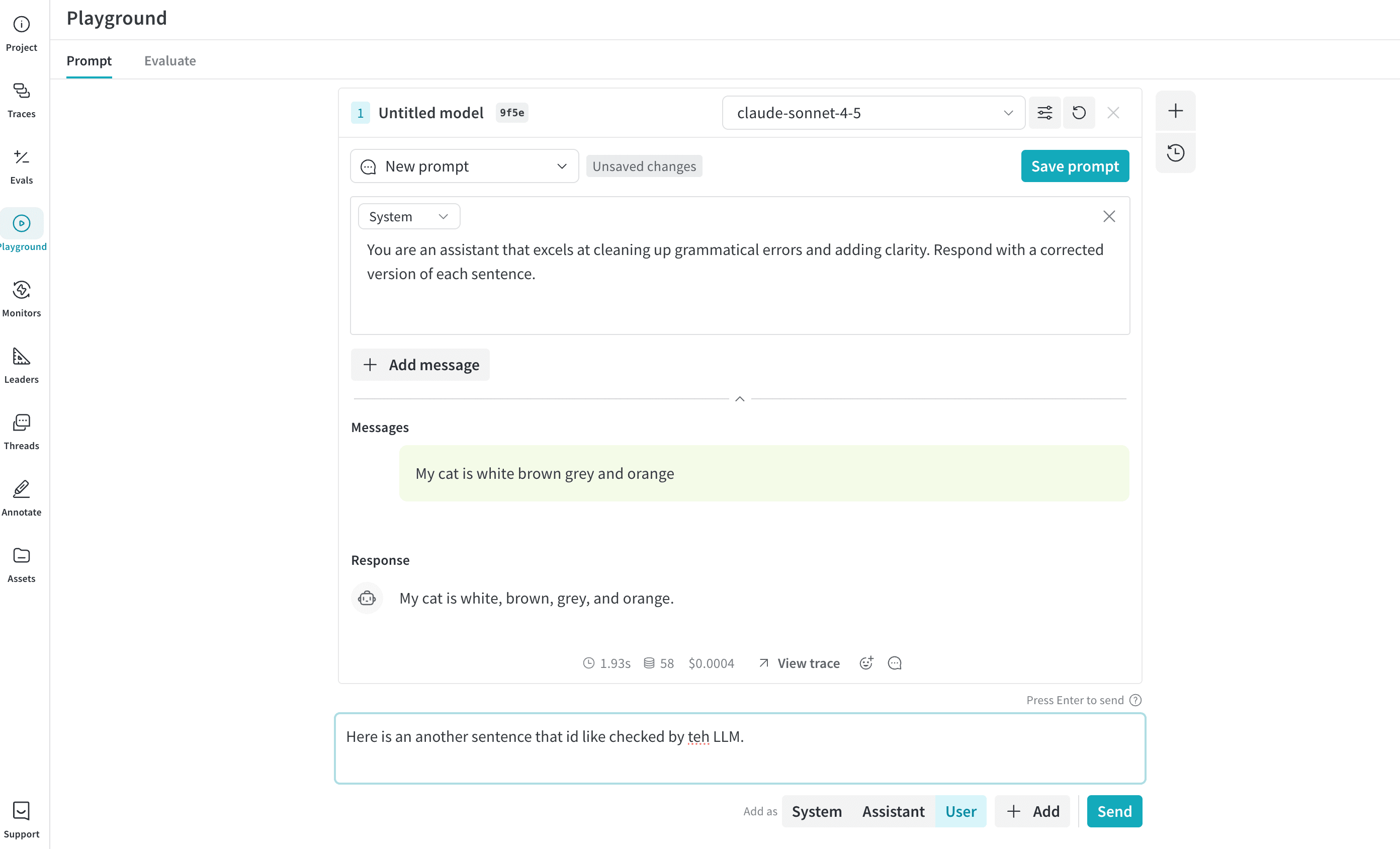

Playground の設定をカスタマイズする

LLM パラメータを調整する

- プロンプトヘッダー(メインパネル上部)で、チャット設定 () ボタンをクリックして、チャット設定 パネルを開きます。

- チャット設定 パネルで、必要に応じてパラメータを調整します。Weave の呼び出しトラッキングをオンまたはオフに切り替えたり、関数を追加したりできます。

- 変更は自動的に適用されます。パネルを閉じるには、もう一度 チャット設定 をクリックするか、右上隅の x をクリックします。チャット設定 ボタンのホバーテキストは、変更した設定の内容を表示するように更新されます。

1 です。試行回数を調整するには、チャット設定 パネルを開き、試行回数 の設定を調整します。

関数を追加する

メッセージの制御

プロンプト定義エリア

- プロンプトセレクタ: 既存の保存済みプロンプトを選択するか、新規に作成します。

- メッセージロールセレクタ: 定義中のメッセージのロール (System、Assistant、または User ロール) を指定します。

- プロンプトテキスト: モデルがどのように応答すべきかを定義する指示テキストを入力します。

- Add message ボタン: 実行前にプロンプトコンテキストに追加のメッセージを含められます。

- 補足的なシステムレベルの指示を追加する。

- 応答をガイドするための Assistant ロールのサンプルメッセージを提供する (few-shot プロンプティングなど)。

- 特定のシナリオをテストするためのユーザーメッセージをあらかじめ定義する。

Messages パネル

- プロンプト設定に含まれる、あらかじめ定義されたメッセージ

- メッセージコンポーザーから送信されたメッセージ

- モデルから返された応答

メッセージコンポーザー(入力フィールド)

メッセージ履歴を表示する

LLM を比較する

カスタムプロバイダー

カスタムプロバイダーを追加する

- サポートされているモデルプロバイダーの古いバージョン

- ローカルモデル

- プロンプトヘッダー(メインパネル上部)で Select a model ドロップダウンをクリックします。

- + Add AI provider を選択します。

- Custom Provider を選択します。

- ポップアップモーダルで、プロバイダー情報を入力します。

- Provider name:

openaiやollamaなど、プロバイダーの名前。 - API key: OpenAI APIキーなど、プロバイダーの APIキー。

- Base URL:

https://api.openai.com/v1/や、https://e452-2600-1700-45f0-3e10-2d3f-796b-d6f2-8ba7.ngrok-free.appのような ngrok の URL など、プロバイダーのベースとなるエンドポイント。 - Headers: (オプション)1 つ以上のカスタム HTTP ヘッダーのキーと値のペア。

- Models:

deepseek-r1やqwqなど、プロバイダーの 1 つ以上のモデル。 - Max tokens: (オプション)各モデルについて、そのモデルがレスポンスで生成できるトークン数の最大値。

- プロバイダー情報を入力したら、Add provider をクリックします。

- Select a model ドロップダウンから、新しいプロバイダーと利用可能なモデルを選択します。

カスタムプロバイダーを編集する

- プロンプトヘッダーの Select a model ドロップダウンをクリックし、+Configure providers を選択します。

- または、サイドバーメニューで Project を選択し、AI Providers タブを選択します。

- Custom providers テーブルで、更新したいカスタムプロバイダーを探します。

- 対象のカスタムプロバイダーの行の Last Updated 列で、編集ボタン(鉛筆アイコン)をクリックします。

- 表示されるモーダルウィンドウで、プロバイダー情報を編集します。

- Save をクリックします。

カスタムプロバイダを削除する

- プロンプトヘッダーで Select a model ドロップダウンをクリックし、+Configure providers を選択します。

- または、サイドバーのメニューで Project を選択し、AI Providers タブを開きます。

- Custom providers テーブルで、削除するカスタムプロバイダを探します。

- 対象のカスタムプロバイダのエントリの Last Updated 列で、削除ボタン(ゴミ箱アイコン)をクリックします。

- 表示されるモーダルで、プロバイダを削除することを確認します。この操作は元に戻せません。

- Delete をクリックします。

ローカルモデルをカスタムプロバイダとして使用する

- 使用しているオペレーティングシステム向けに ngrok をインストール します。

-

Ollama モデルを起動します:

-

別のターミナルで、必要な CORS ヘッダーを含む ngrok トンネルを作成します:

-

ngrok が起動すると、

https://xxxx-xxxx.ngrok-free.appのような公開 URL が表示されます。Playground で カスタムプロバイダを追加 する際、この URL を Base URL として使用します。

保存済みモデル

モデルを保存する

- プロンプトヘッダー(メインパネル上部)の Select a model ドロップダウンで、プロバイダーとモデルを選択します。

- プロンプトヘッダーで Chat settings () ボタンをクリックして、Chat settings パネルを開きます。

- Chat settings パネルで:

- Model Name(必須):保存するモデルの名前を入力します。

- 必要に応じてパラメータを調整します。Weave のコールトラッキングをオンまたはオフに切り替えたり、関数を追加することもできます。

- Publish model をクリックします。モデルは保存され、Select a model ドロップダウン内の Saved Models からアクセスできます。これで、保存したモデルを使用したり更新したりできます。

保存済みモデルを使用する

- プロンプトヘッダーの Select a model ドロップダウンで Saved Models を選択します。

- 保存済みモデルの一覧から、読み込みたいモデルを選択します。モデルが読み込まれ、Playground ですぐに使用できる状態になります。

保存済みモデルを更新する

- プロンプトヘッダーの Select a model ドロップダウンで、Saved Models を選択します。

- 保存済みモデルの一覧から、更新したい保存済みモデルを選択します。

- プロンプトヘッダーで、Chat settings () ボタンをクリックして Chat settings パネルを開きます。

- Chat settings パネルで、必要に応じてパラメータを調整します。Weave コールトラッキングのオン/オフを切り替えたり、関数を追加したりできます。

- Update model をクリックします。モデルが更新され、Select a model ドロップダウン内の Saved Models からアクセスできるようになります。保存済みモデルのバージョンは自動的にインクリメントされます。