- モデル性能の劣化の追跡

- 共有評価ワークフローの調整

リーダーボードの作成は Weave UI と Weave Python SDK でのみ利用できます。TypeScript ユーザーは Weave UI を使用してリーダーボードを作成および管理できます。

リーダーボードを作成する

UI を使用する

- Weave UI で Leaders セクションに移動します。表示されていない場合は、More → Leaders をクリックします。

- + New Leaderboard をクリックします。

- Leaderboard Title フィールドに、

summarization-benchmark-v1などのわかりやすい名前を入力します。 - 必要に応じて、このリーダーボードが何を比較するものかを説明するテキストを追加します。

- 表示する評価とメトリクスを定義するために、列を追加します。

- レイアウトが整ったら、リーダーボードを保存して公開し、他のユーザーと共有します。

列を追加する

- Evaluation: ドロップダウンから評価 run を選択します(事前に作成されている必要があります)。

- Scorer: その評価で使用されるスコアリング関数(例:

jaccard_similarity、simple_accuracy)を選択します。 - Metric: 表示する要約メトリクス(例:

mean、true_fractionなど)を選択します。

⋯) をクリックします。次の操作ができます。

- Move before / after – 列の位置を前後に移動する

- Duplicate – 列の定義をコピーする

- Delete – 列を削除する

- Sort ascending – リーダーボードのデフォルトの並び順を昇順に設定する(もう一度クリックすると降順に切り替え)

Python

-

テストデータセットを定義します。組み込みの

Datasetを使用するか、入力とターゲットのリストを手動で定義します。 -

1つ以上の scorer を定義します。

-

Evaluationを作成します。 -

評価対象のモデルを定義します。

-

評価を実行します。

-

リーダーボードを作成します。

-

リーダーボードを公開します。

-

結果を取得します。

エンドツーエンドの Python 例

Leaderboard を表示して解釈する

- Weave UI で Leaders タブを開きます。表示されていない場合は More をクリックし、Leaders を選択します。

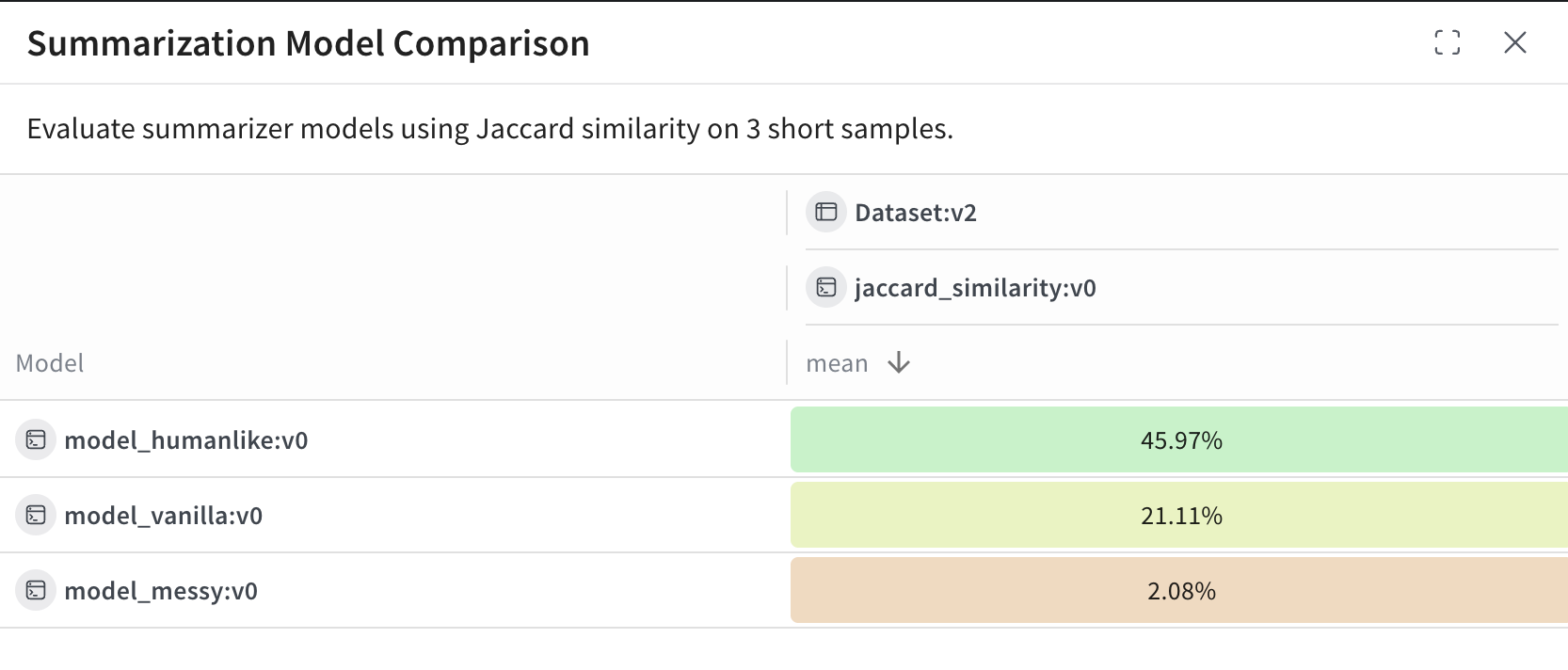

- Leaderboard の名前(例:

Summarization Model Comparison)をクリックします。

model_humanlike、model_vanilla、model_messy)を表します。mean 列には、そのモデルの出力と参照要約との平均 Jaccard 類似度が表示されます。

model_humanlikeが最も良い結果で、オーバーラップは約 46% です。model_vanilla(素朴な切り詰め)は約 21% です。model_messyは意図的に性能を低くしたモデルで、スコアは約 2% です。