Importez et journalisez votre fichier CSV de jeu de données

- Pour commencer, importez votre fichier CSV. Dans l’extrait de code suivant, remplacez le nom de fichier

iris.csvpar le nom de votre fichier CSV :

- Convertissez le fichier CSV en tableau W&B afin d’exploiter les tableaux de bord W&B.

- Ensuite, créez un Artifact W&B et ajoutez-y le tableau :

- Enfin, démarrez un nouveau run W&B pour suivre et consigner dans W&B à l’aide de

wandb.init:

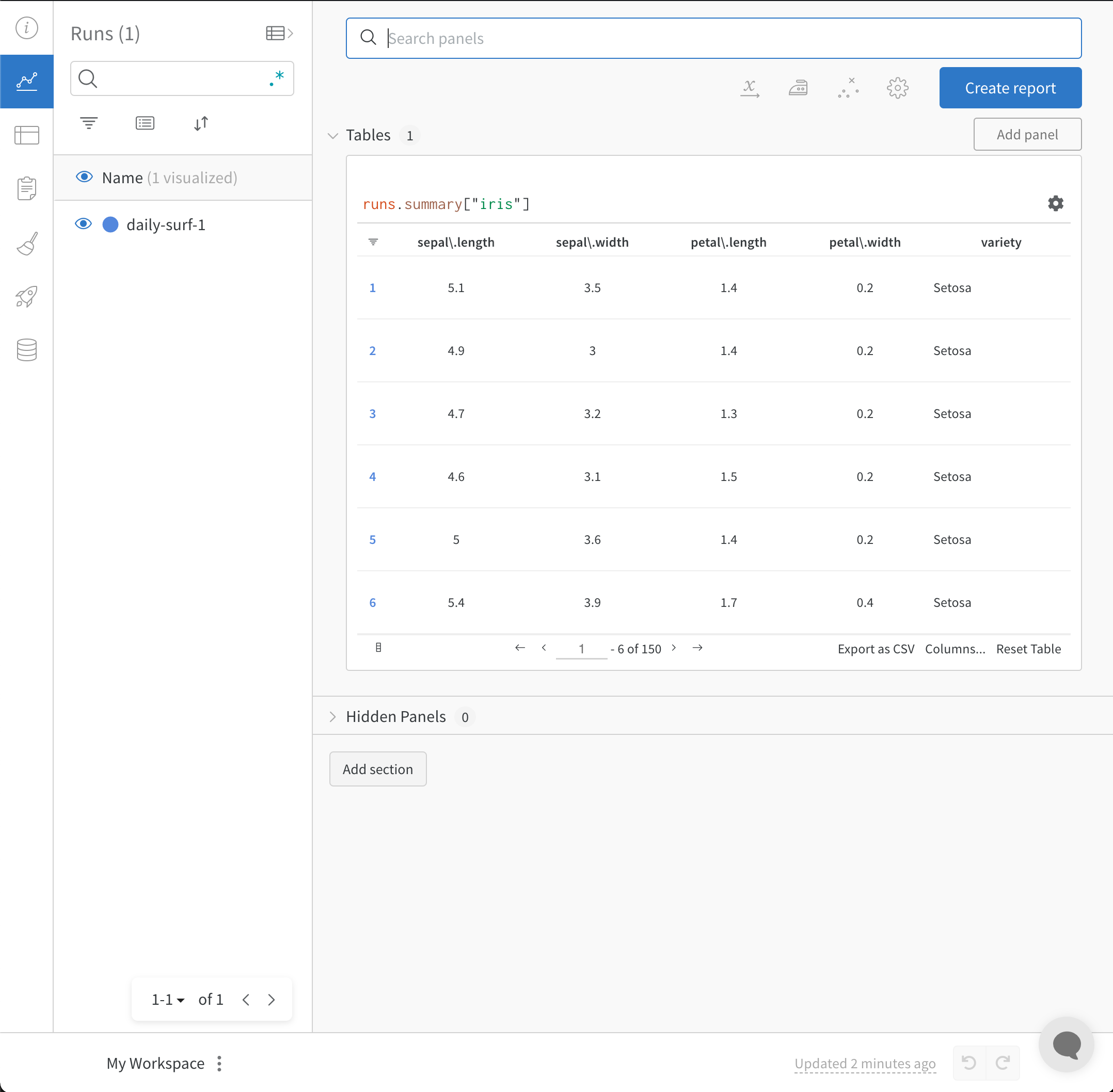

wandb.init() lance un nouveau processus en arrière-plan pour journaliser les données dans un run et les synchronise avec wandb.ai (par défaut). Consultez des visualisations en temps réel dans votre tableau de bord Workspace W&B. L’image suivante montre le résultat obtenu avec cet extrait de code.

Importez votre CSV d’expériences et journalisez-le

- Un nom pour le run de l’expérience

- Des notes initiales

- Des Tags pour différencier les expériences

- Les configurations nécessaires à votre expérience (avec l’avantage supplémentaire de pouvoir utiliser notre fonctionnalité Sweeps Hyperparameter Tuning).

| expérience | Model Name | Notes | Tags | Num Layers | Final Train Acc | Final Val Acc | Training Losses |

|---|---|---|---|---|---|---|---|

| expérience 1 | mnist-300-layers | Surapprentissage beaucoup trop important sur les données d’entraînement | [latest] | 300 | 0.99 | 0.90 | [0.55, 0.45, 0.44, 0.42, 0.40, 0.39] |

| expérience 2 | mnist-250-layers | Meilleur modèle actuel | [prod, best] | 250 | 0.95 | 0.96 | [0.55, 0.45, 0.44, 0.42, 0.40, 0.39] |

| expérience 3 | mnist-200-layers | Résultats inférieurs à ceux du modèle de référence. Débogage nécessaire | [debug] | 200 | 0.76 | 0.70 | [0.55, 0.45, 0.44, 0.42, 0.40, 0.39] |

| … | … | … | … | … | … | … | |

| expérience N | mnist-X-layers | NOTES | … | … | … | … | […, …] |

- Pour commencer, lisez votre fichier CSV et convertissez-le en dataframe Pandas. Remplacez

"experiments.csv"par le nom de votre fichier CSV :

-

Ensuite, démarrez un nouveau W&B Run pour suivre et consigner des données dans W&B à l’aide de

wandb.init():

run.log() pour cela :

define_metric. Cet exemple ajoute les métriques au summary de notre run avec run.summary.update():