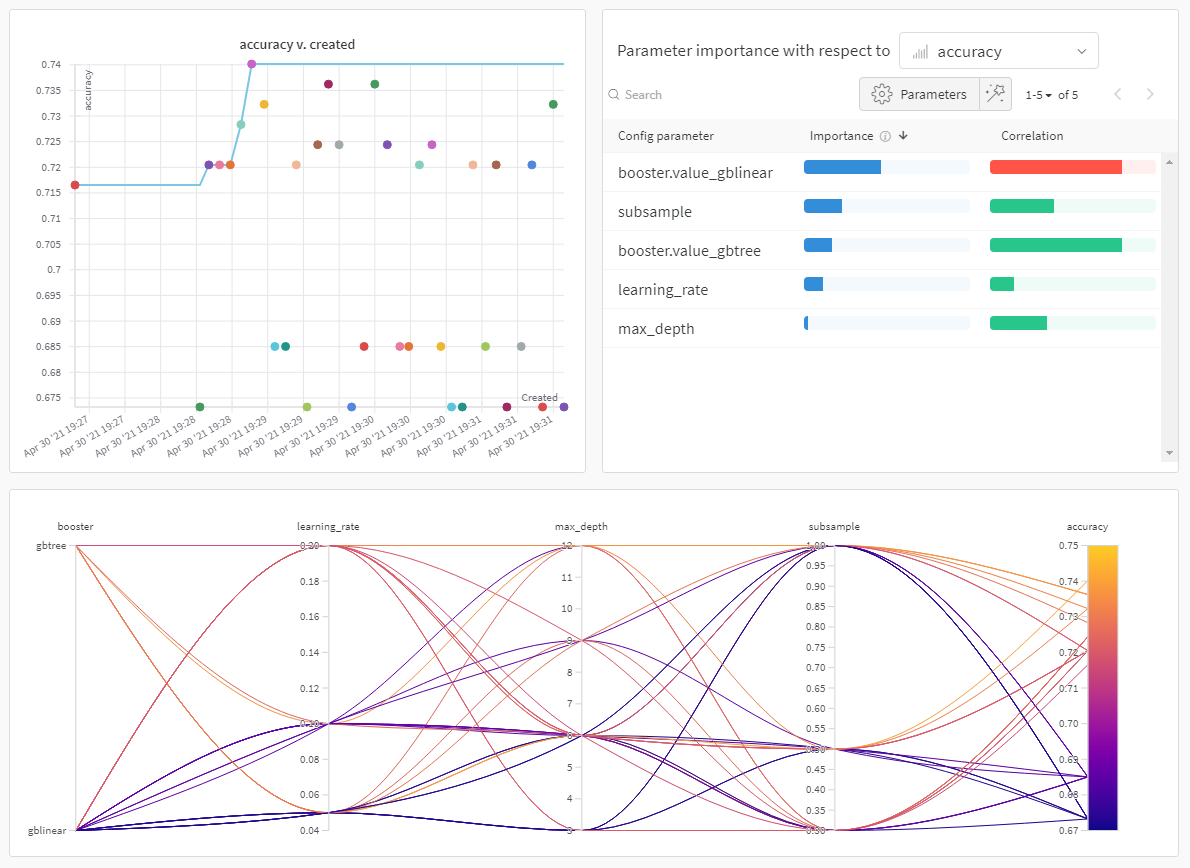

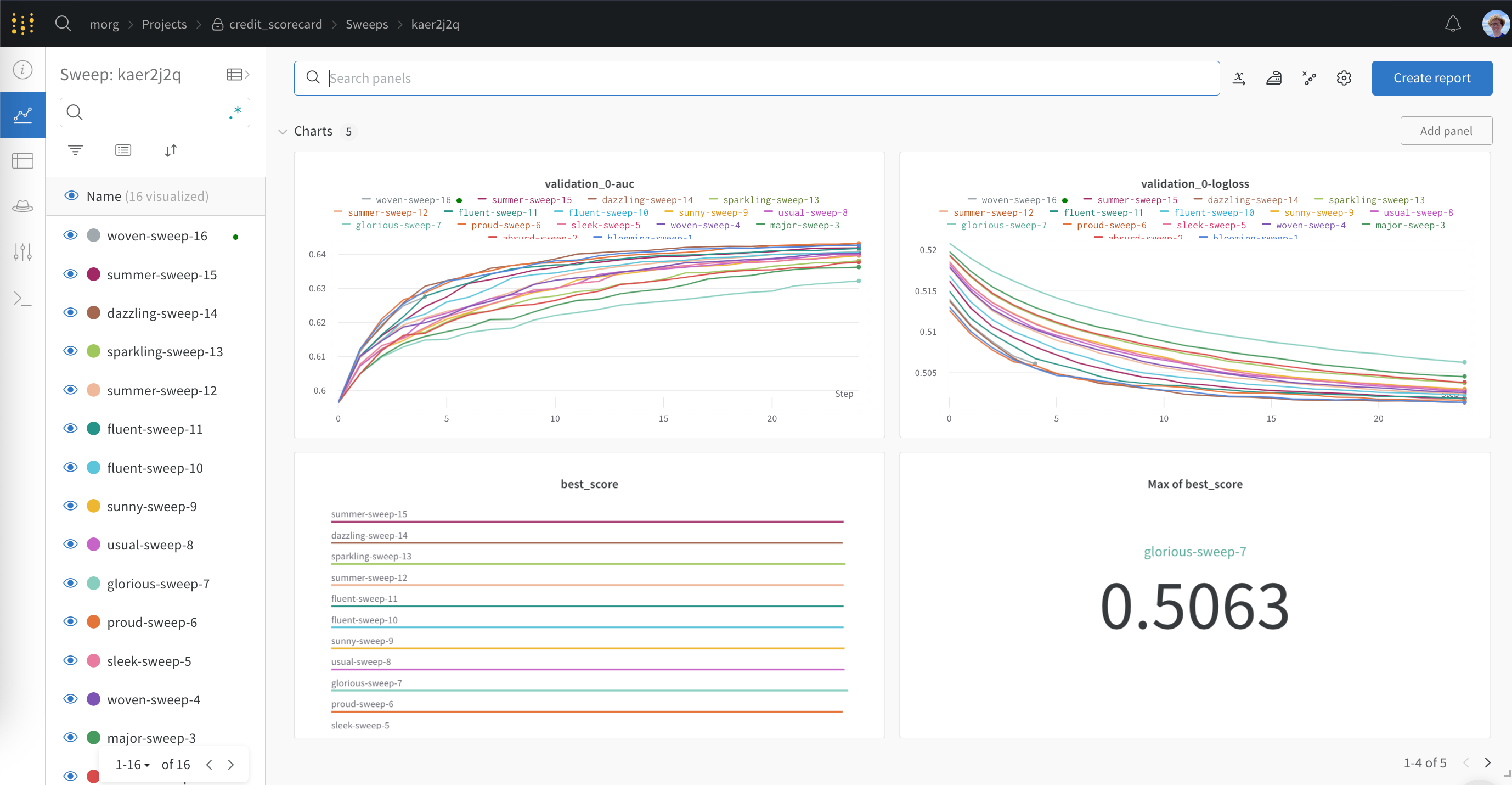

wandb ライブラリには、XGBoost での学習からメトリクス、設定、および保存されたブースターをログするための WandbCallback コールバックが用意されています。ここでは、XGBoost の WandbCallback による出力を表示するライブの W&B ダッシュボードを確認できます。

はじめに

WandbCallback を XGBoost に渡すだけです。

WandbCallback リファレンス

機能

WandbCallback を XGBoost モデルに渡すと、次のことを行います:

- booster モデルの設定を W&B にログします

- XGBoost によって収集された rmse や accuracy などの評価メトリクスを W&B にログします

- XGBoost によって収集された学習メトリクスを(

eval_setにデータを指定した場合)W&B にログします - 最良スコアおよび最良イテレーションをログします

- 学習済みモデルを保存し、W&B Artifacts にアップロードします(

log_model = Trueの場合) log_feature_importance=True(デフォルト)のとき、特徴量重要度のプロットをログしますdefine_metric=True(デフォルト)のとき、wandb.Run.summaryに最良の評価メトリクスを記録します

引数

-

log_model: (boolean) True の場合、モデルを保存し、W&B Artifacts にアップロードします -

log_feature_importance: (boolean) True の場合、特徴量重要度の棒グラフをログします -

importance_type: (str) 木ベースのモデルに対しては{weight, gain, cover, total_gain, total_cover}のいずれかを指定します。線形モデルの場合は weight を指定します。 -

define_metric: (boolean) True(デフォルト)の場合、run.summaryには学習の最後のステップではなく、最良ステップ時点でのモデル性能を記録します。

Sweeps を使ってハイパーパラメータをチューニングする