仕組み

- W&B Run を作成します。

- 学習率やモデルタイプなどのハイパーパラメータの辞書を設定(

wandb.Run.config)に保存します。 - 学習ループ内で

wandb.Run.log()を使って、精度や損失などのメトリクスを時間経過とともにログします。 - モデルの重みや予測結果のテーブルなど、その run の出力を保存します。

はじめに

- W&B クイックスタート を読んで、データセットのアーティファクトを作成・トラッキング・利用するために使用できる W&B Python SDK コマンドをステップバイステップで確認してください。

- この章では、次の内容について学びます。

- Experiment を作成する

- Experiments を設定する

- Experiments からデータを記録する

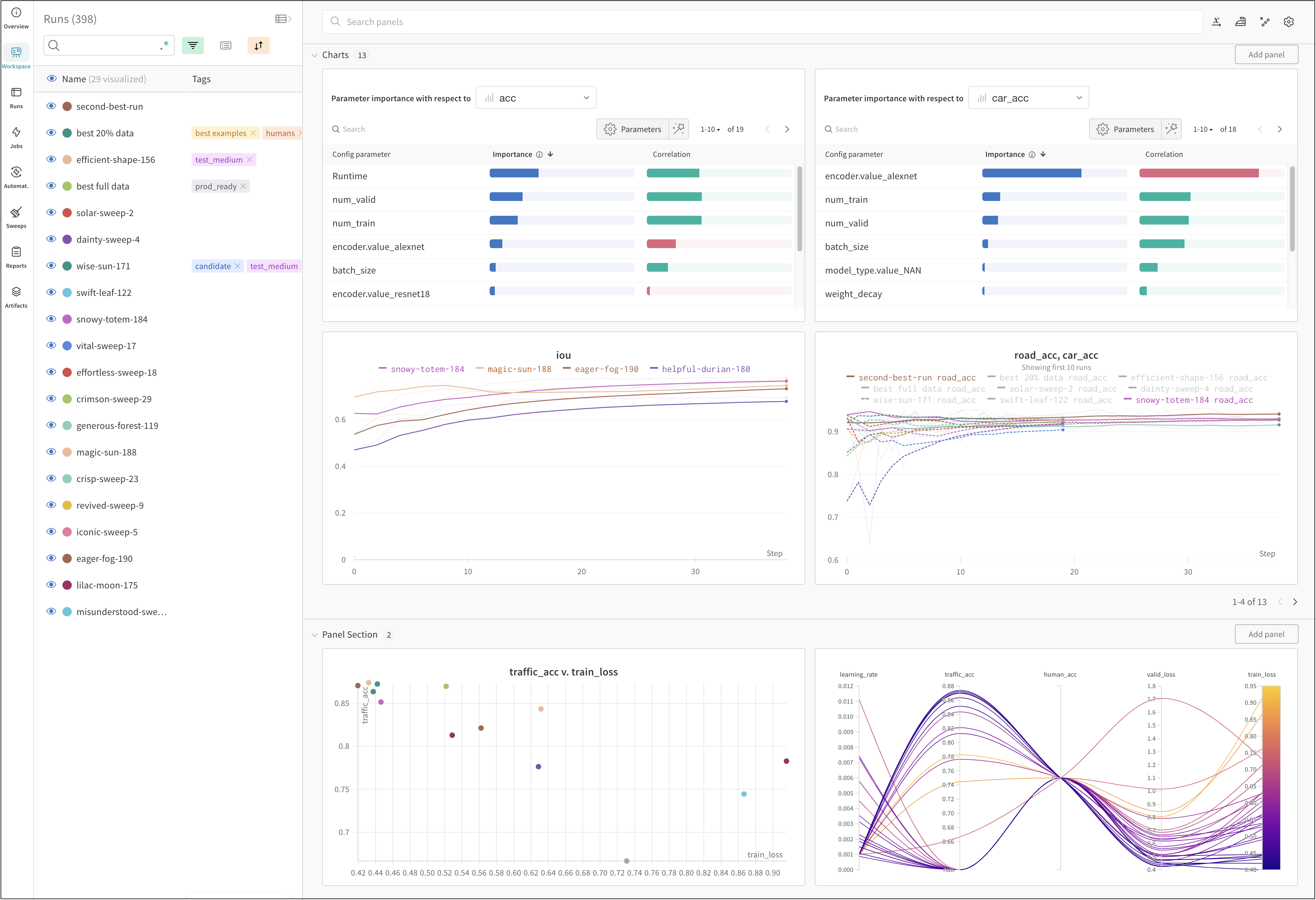

- Experiments の結果を確認する

- W&B API Reference Guide 内の W&B Python Library を参照してください。