W&B を使ってファインチューニングの実験、モデル、およびデータセットを追跡し、結果を同僚と共有する方法については、OpenAI ファインチューニングインテグレーション を参照してください。

OpenAI Python API ライブラリをインストールする

OpenAI の Python API を使用する

1. autolog をインポートして初期化する

wandb.integration.openai から autolog をインポートして初期化します。

wandb.init() が受け付ける引数を含む辞書を autolog に渡すことができます。これには、プロジェクト名、チーム名、エンティティ名などが含まれます。wandb.init() の詳細については、API リファレンスガイドを参照してください。

2. OpenAI API を呼び出す

3. OpenAI API の入力とレスポンスを確認する

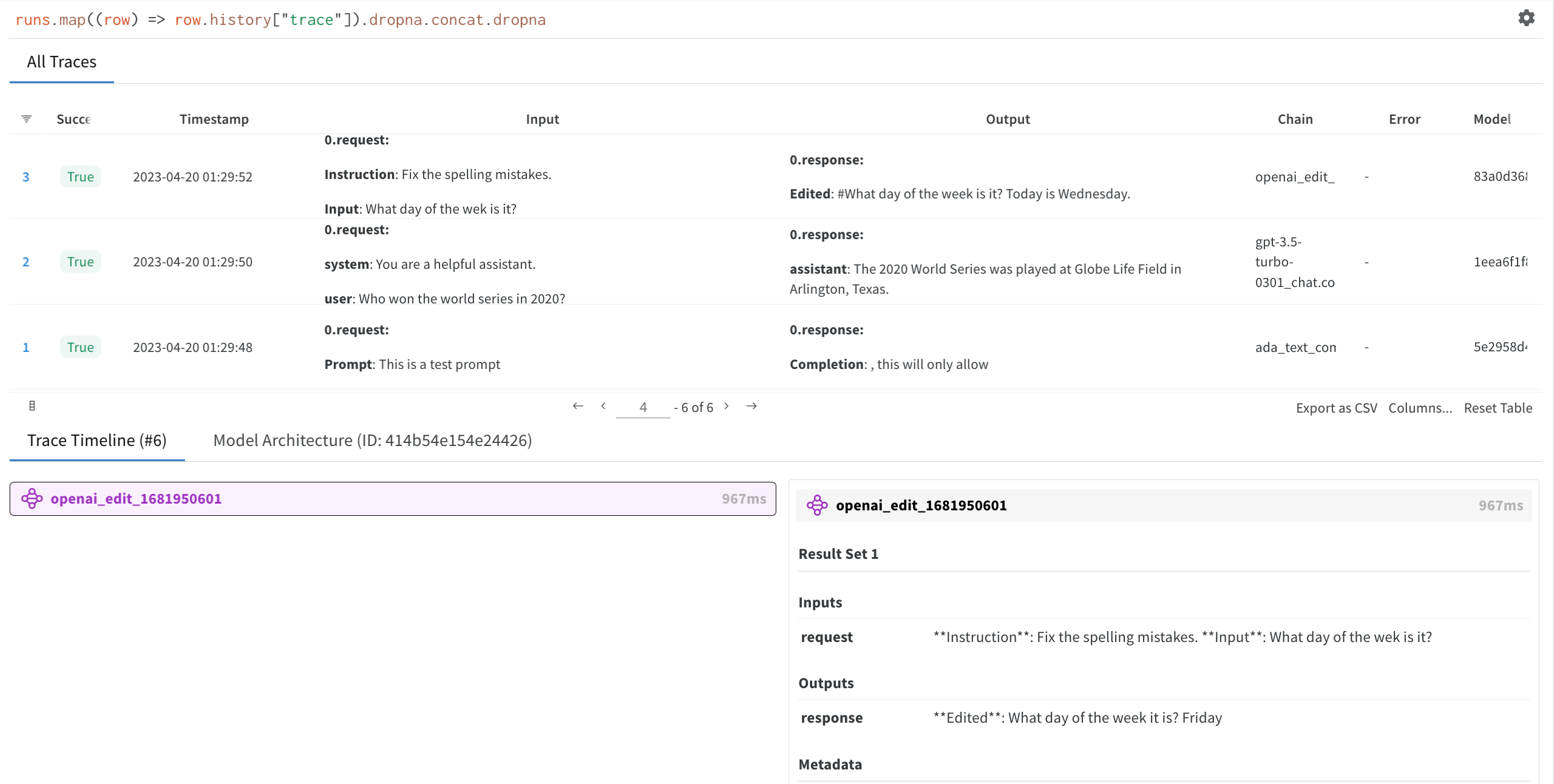

autolog によって生成された W&B の run リンクをクリックします。W&B App 内のあなたのプロジェクト Workspace にリダイレクトされます。

作成した run を選択して、トレーステーブル、トレースタイムライン、および使用されている OpenAI LLM のモデルアーキテクチャを確認します。

autolog をオフにする

disable() を呼び出すことを W&B は推奨しています。