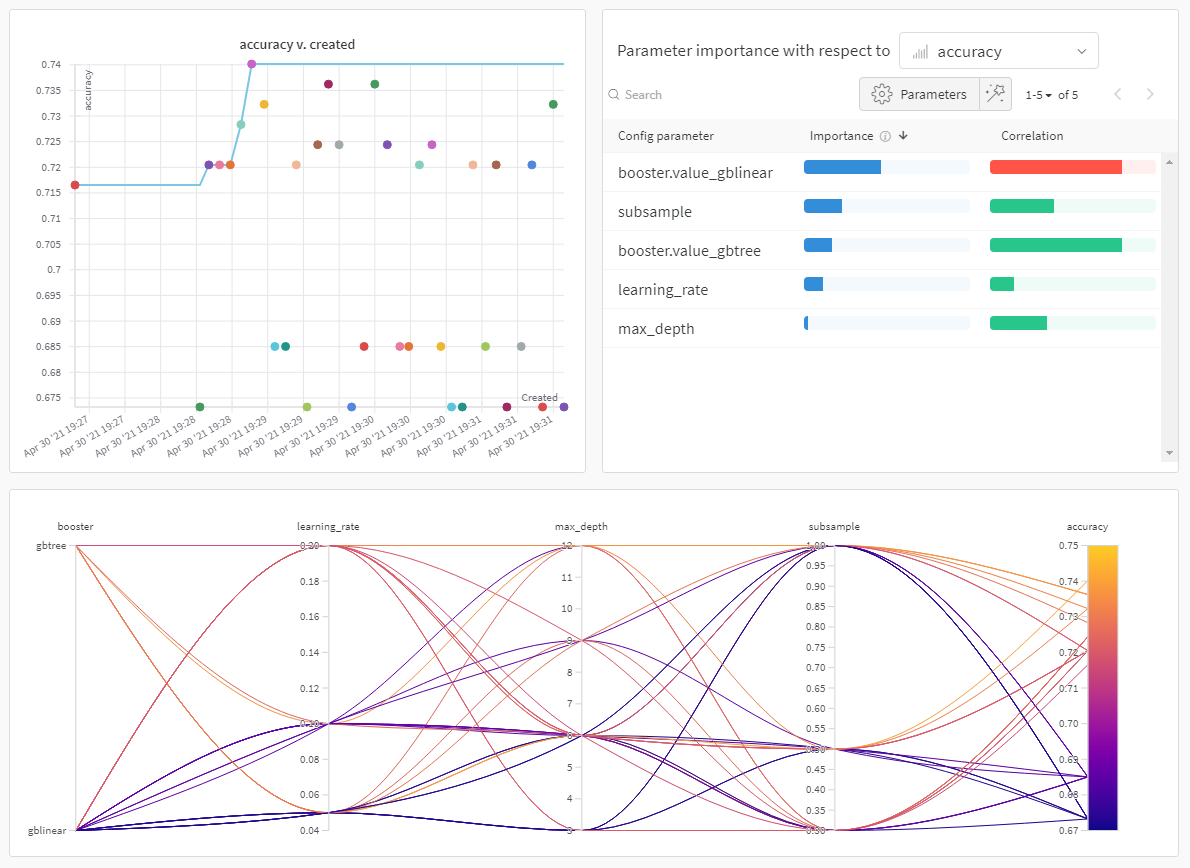

wandb inclut un callback WandbCallback pour journaliser les métriques, les configurations et les boosters enregistrés lors de l’entraînement avec XGBoost. Vous pouvez voir ici un tableau de bord W&B en direct avec les résultats du WandbCallback de XGBoost.

Prise en main

WandbCallback à XGBoost :

Référence de WandbCallback

Fonctionnalité

WandbCallback à un modèle XGBoost permet de :

- journaliser la configuration du modèle booster dans W&B

- journaliser les métriques d’évaluation collectées par XGBoost, comme rmse, accuracy, etc., dans W&B

- journaliser les métriques d’entraînement collectées par XGBoost (si vous fournissez des données à

eval_set) - journaliser le meilleur score et la meilleure itération

- enregistrer et téléverser votre modèle entraîné dans W&B Artifacts (lorsque

log_model = True) - journaliser le graphique d’importance des variables lorsque

log_feature_importance=True(par défaut). - Capturer la meilleure métrique d’évaluation dans

wandb.Run.summarylorsquedefine_metric=True(par défaut).

Arguments

-

log_model: (boolean) si True, enregistrez et envoyez le modèle vers W&B Artifacts -

log_feature_importance: (boolean) si True, journalisez un graphique à barres de l’importance des variables -

importance_type: (str) l’une des valeurs suivantes :{weight, gain, cover, total_gain, total_cover}pour un modèle arborescent.weightpour un modèle linéaire. -

define_metric: (boolean) si True (par défaut), enregistrez les performances du modèle à la meilleure étape de l’entraînement, plutôt qu’à la dernière, dans votrerun.summary.

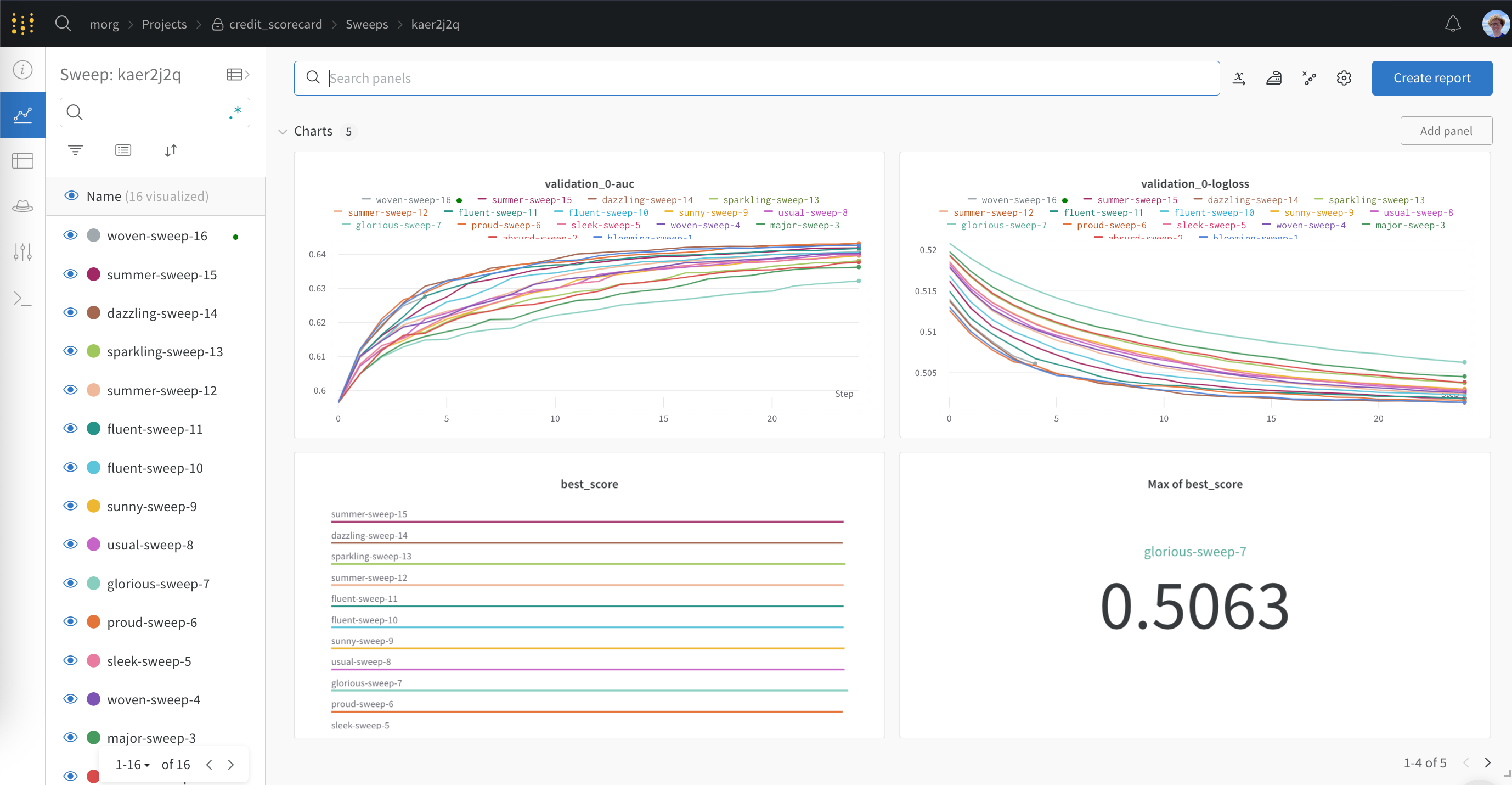

Ajustez vos hyperparamètres avec Sweeps