1. Suivi automatique des appels de bibliothèques LLM

openai, anthropic, cohere, mistral et LangChain.

Importez la bibliothèque LLM ou le framework, initialisez votre projet Weave, puis Weave trace automatiquement tous les appels effectués vers le LLM ou la plateforme dans votre projet,

sans aucune modification de code supplémentaire. Pour obtenir la liste complète des intégrations de bibliothèques prises en charge, voir Aperçu des intégrations.

- Python

- TypeScript

2. Suivi des fonctions personnalisées

- Python

- TypeScript

Weave vous permet de suivre manuellement ces appels à l’aide du décorateur Vous pouvez également suivre les méthodes de classe.

@weave.op. Par exemple :Suivre les méthodes de classe et d’instance

weave.op.

- Python

- TypeScript

Tracer des appels de fonction parallèles (multithread)

ThreadPoolExecutor.

- Python

- TypeScript

L’exemple de code suivant montre comment utiliser

ThreadPoolExecutor.

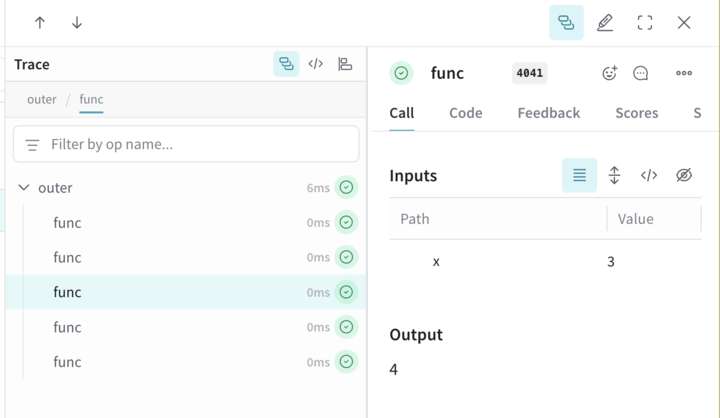

La première fonction, func, est un op simple qui prend x et renvoie x+1. La deuxième fonction, outer, est un autre op qui accepte une liste d’entrées.

Dans outer, l’utilisation de ThreadPoolExecutor et de exc.map(func, inputs) signifie que chaque appel à func conserve le même contexte de trace parent.

3. Suivi manuel des appels

- Python

- TypeScript

- HTTP API