weave.init() appelé.

Tracing

- Python

- TypeScript

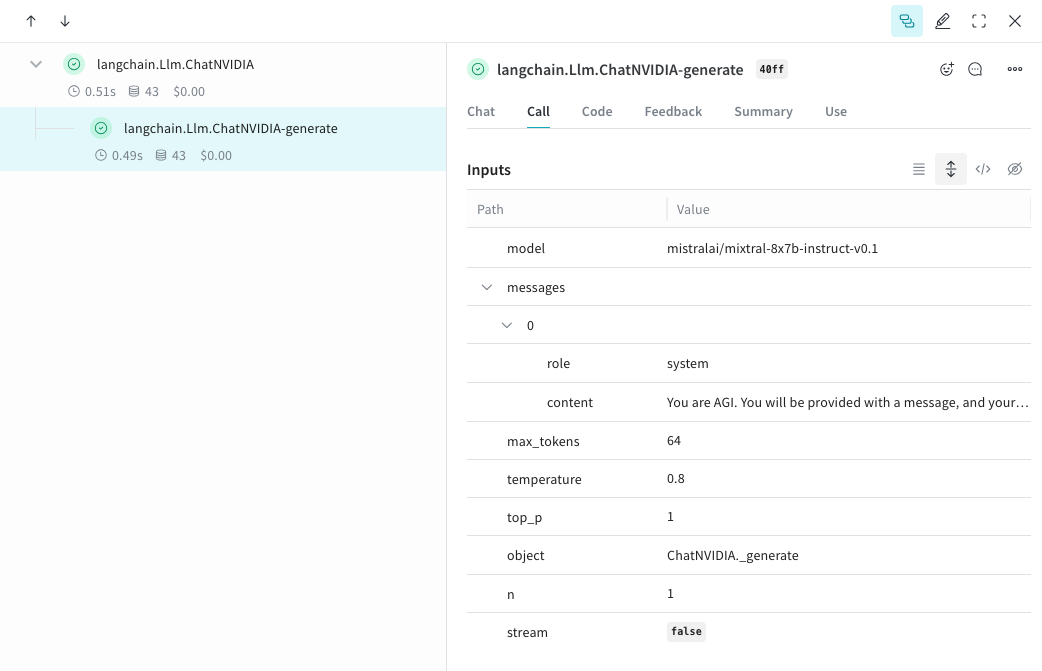

Weave peut automatiquement capturer les traces de la bibliothèque Python ChatNVIDIA.Commencez à capturer les traces en appelant

weave.init(<project-name>) avec le nom de projet de votre choix.

Suivez vos propres ops

- Python

- TypeScript

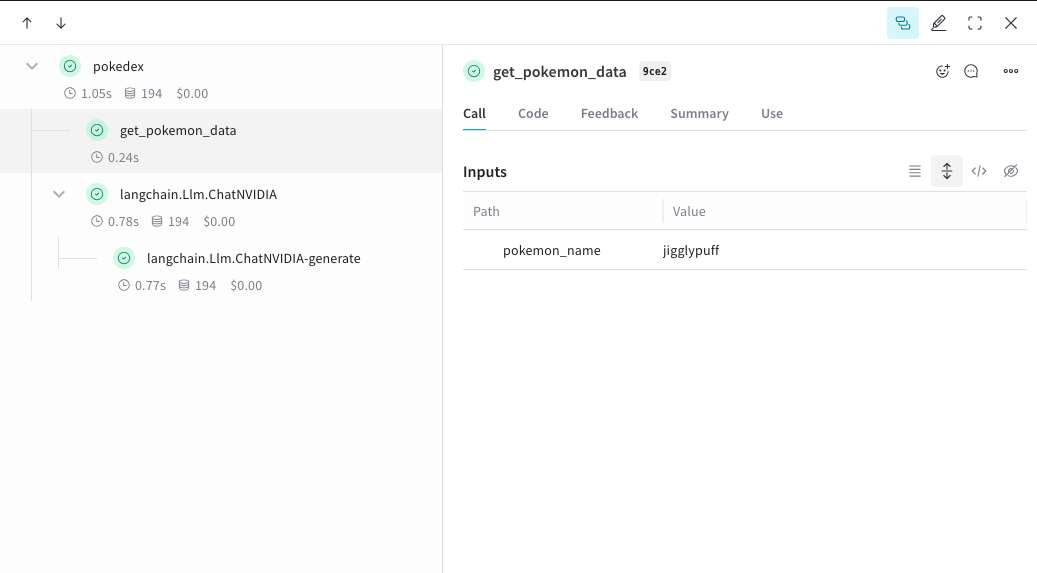

Décorer une fonction avec Accédez à Weave, puis cliquez sur

@weave.op commence à capturer les entrées, les sorties et la logique de l’application afin que vous puissiez déboguer la façon dont les données circulent dans votre application. Vous pouvez imbriquer des ops en profondeur et construire un arbre de fonctions que vous souhaitez suivre. Cela lance aussi automatiquement la gestion des versions du code pendant vos expérimentations afin de capturer des détails ad hoc qui n’ont pas été commités dans git.Créez simplement une fonction décorée avec @weave.op qui appelle la bibliothèque Python ChatNVIDIA.Dans l’exemple ci-dessous, 2 fonctions sont encapsulées dans un op. Cela nous aide à voir comment des étapes intermédiaires, comme l’étape de récupération dans une application RAG, influencent le comportement de notre application.get_pokemon_data dans l’interface pour voir les entrées et les sorties de cette étape.

Créez un Model pour expérimenter plus facilement

- Python

- TypeScript

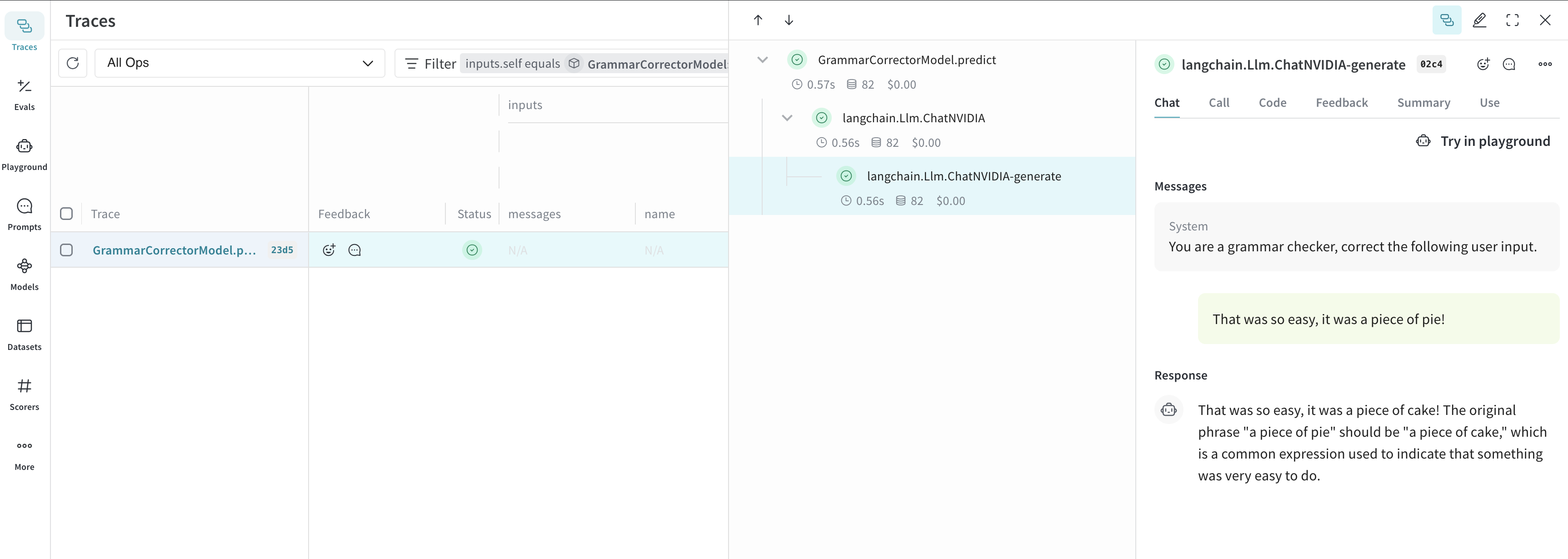

Il est difficile d’organiser une expérimentation lorsque de nombreux éléments entrent en jeu. En utilisant la classe

Model, vous pouvez capturer et organiser les détails expérimentaux de votre application, comme votre prompt système ou le modèle que vous utilisez. Cela facilite l’organisation et la comparaison des différentes itérations de votre application.En plus de la gestion des versions du code et de la capture des entrées/sorties, les Models capturent des paramètres structurés qui contrôlent le comportement de votre application, ce qui permet d’identifier facilement les paramètres qui donnent les meilleurs résultats. Vous pouvez également utiliser les Weave Models avec serve et les Evaluations.Dans l’exemple ci-dessous, vous pouvez tester model et system_message. Chaque fois que vous modifiez l’un de ces deux éléments, vous obtenez une nouvelle version de GrammarCorrectorModel.

Informations d’utilisation

invoke, stream ainsi que leurs variantes asynchrones. Elle prend également en charge l’utilisation d’outils.

Comme ChatNVIDIA est conçu pour être utilisé avec de nombreux types de modèles, il ne prend pas en charge les appels de fonction.