Nous prenons en charge le nouveau SDK Mistral v1.0. Consultez le guide de migration ici

Traces

weave.init() :

Encapsuler dans vos propres ops

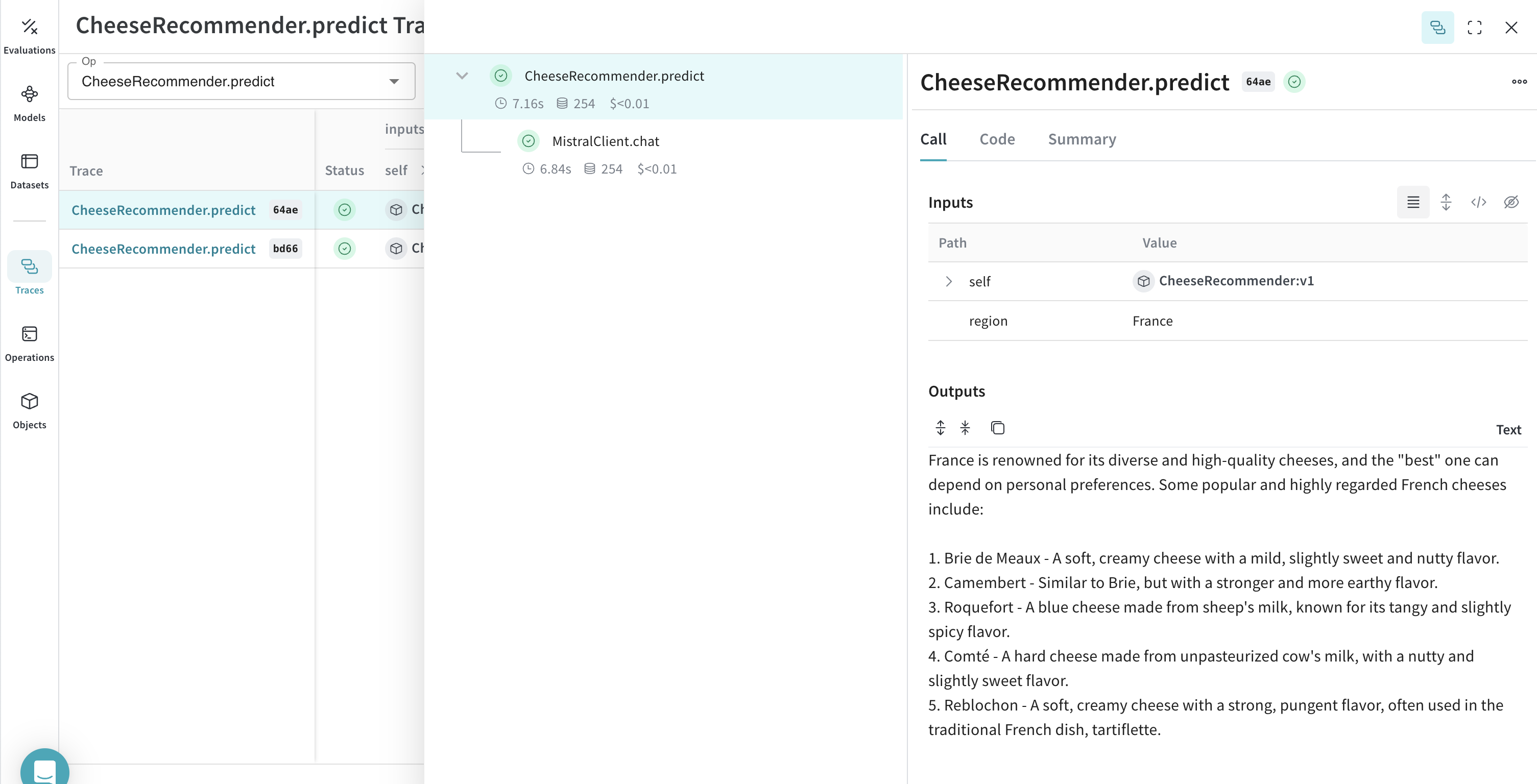

@weave.op() qui appelle mistralai.client.MistralClient.chat(), et Weave assurera pour vous le suivi des entrées et des sorties. Voyons comment procéder pour notre système de recommandation de fromages :

Créer un Model pour faciliter l’expérimentation

Model, vous pouvez capturer et organiser les détails expérimentaux de votre application, comme votre prompt système ou le modèle que vous utilisez. Cela facilite l’organisation et la comparaison des différentes itérations de votre application.

En plus de gérer les versions du code et de capturer les entrées/sorties, les Models capturent des paramètres structurés qui contrôlent le comportement de votre application, ce qui permet d’identifier facilement les paramètres les plus efficaces. Vous pouvez également utiliser les Weave Models avec serve et les Evaluations.

Dans l’exemple ci-dessous, vous pouvez expérimenter avec model et country. Chaque fois que vous modifiez l’un de ces éléments, vous obtenez une nouvelle version de CheeseRecommender.