Configurer les modèles de configuration de file d’attente

Configurer un modèle de file d’attente

- Accédez à la W&B Launch App.

- Sélectionnez View queue à côté du nom de la file d’attente à laquelle vous souhaitez ajouter un modèle.

- Sélectionnez l’onglet Config. Il affiche des informations sur votre file d’attente, notamment sa date de création, sa configuration et les remplacements existants au moment du lancement.

- Accédez à la section configuration de la file d’attente.

- Identifiez les paires clé-valeur de configuration pour lesquelles vous souhaitez créer un modèle.

- Remplacez la valeur dans la configuration par un champ de modèle. Les champs de modèle prennent la forme

{{variable-name}}. - Cliquez sur le bouton Parse configuration. Lorsque vous analysez votre configuration, W&B crée automatiquement des vignettes sous la configuration de la file d’attente pour chaque modèle créé.

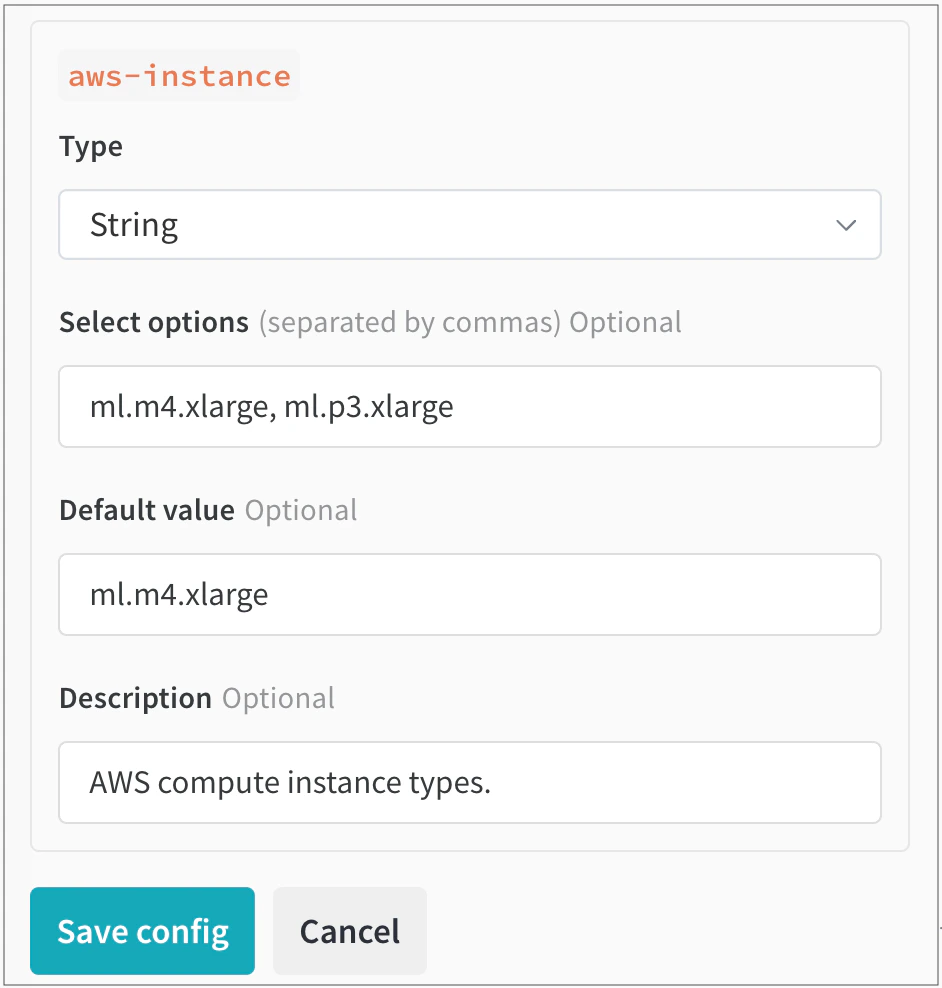

- Pour chaque vignette générée, vous devez d’abord spécifier le type de données (chaîne, entier ou nombre à virgule flottante) autorisé par la configuration de la file d’attente. Pour ce faire, sélectionnez le type de données dans le menu déroulant Type.

- Selon le type de données, renseignez les champs qui apparaissent dans chaque vignette.

- Cliquez sur Save config.

launch config

InstanceType, votre configuration ressemblera à ceci :

launch config

aws-instance apparaît sous configuration de la file d’attente.

À partir de là, sélectionnez String comme type de données dans le menu déroulant Type. Des champs s’affichent alors, dans lesquels vous pouvez spécifier les valeurs parmi lesquelles un utilisateur pourra choisir. Par exemple, dans l’image suivante, l’administrateur de l’équipe a configuré deux types d’instances AWS différents parmi lesquels les utilisateurs peuvent choisir (ml.m4.xlarge et ml.p3.xlarge) :

Configurer dynamiquement les jobs Launch

| Macro | Description |

|---|---|

${project_name} | Le nom du projet dans lequel le run est lancé. |

${entity_name} | Le propriétaire du projet dans lequel le run est lancé. |

${run_id} | L’ID du run en cours de lancement. |

${run_name} | Le nom du run en cours de lancement. |

${image_uri} | L’URI de l’image de conteneur de ce run. |

Toute macro personnalisée ne figurant pas dans le tableau ci-dessus (par exemple

${MY_ENV_VAR}) est remplacée par une variable d’environnement issue de l’environnement de l’agent.Utiliser l’agent Launch pour créer des images qui s’exécutent sur des accélérateurs (GPU)

- Compatibilité avec Debian (le Dockerfile de Launch utilise

apt-getpour récupérer Python) - Compatibilité des jeux d’instructions matériels CPU et GPU (assurez-vous que votre version de CUDA est prise en charge par le GPU que vous prévoyez d’utiliser)

- Compatibilité entre la version d’accélérateur que vous fournissez et les packages installés dans votre algorithme de ML

- Packages installés nécessitant des étapes supplémentaires pour assurer la compatibilité avec le matériel

Comment utiliser des GPU avec TensorFlow

builder.accelerator.base_image dans la configuration des ressources de la file d’attente.

Par exemple, l’image de base tensorflow/tensorflow:latest-gpu garantit que TensorFlow utilise correctement votre GPU. Vous pouvez la configurer dans la configuration des ressources de la file d’attente.

L’extrait JSON suivant montre comment spécifier l’image de base TensorFlow dans la configuration de votre file d’attente :

configuration de la file d'attente