Les jobs d’Évaluation LLM sont en Aperçu sur W&B Multi-tenant Cloud. Les ressources de calcul sont gratuites pendant la période d’aperçu. En savoir plus

Prérequis

- Consultez les exigences et limitations relatives aux jobs d’évaluation de LLM.

- Pour exécuter certains benchmarks, un administrateur d’équipe doit ajouter les clés API requises en tant que secrets au niveau de l’équipe. Tout membre de l’équipe peut ensuite spécifier le secret lors de la configuration d’un job d’évaluation. Voir le catalogue des modèles d’évaluation pour connaître les exigences.

- Une clé API OpenAPI : utilisée par les benchmarks qui s’appuient sur des modèles OpenAI pour le scoring. Requise si le champ Scorer API key apparaît après la sélection d’un benchmark. Le secret doit être nommé

OPENAI_API_KEY. - Un jeton d’accès utilisateur Hugging Face : requis pour certains benchmarks, comme

lingolyetlingoly2, qui nécessitent l’accès à un ou plusieurs Datasets Hugging Face à accès restreint. Requis si le champ Hugging Face Token apparaît après la sélection d’un benchmark. La clé API doit donner accès au jeu de données concerné. Consultez la documentation Hugging Face sur les jetons d’accès utilisateur et l’accès aux jeux de données à accès restreint.

- Une clé API OpenAPI : utilisée par les benchmarks qui s’appuient sur des modèles OpenAI pour le scoring. Requise si le champ Scorer API key apparaît après la sélection d’un benchmark. Le secret doit être nommé

- Créez un nouveau projet W&B pour les résultats de l’évaluation. Dans la barre latérale du projet, cliquez sur Créer un projet.

- Préparez le modèle dans un format compatible avec vLLM et enregistrez-le comme artifact dans W&B Models. Toute tentative d’exécuter un benchmark sur un autre type d’artifact échouera. Pour une méthode possible, voir Exemple : préparer un modèle à la fin de cette page.

- Consultez la documentation du benchmark concerné pour comprendre son fonctionnement et connaître ses exigences spécifiques. Pour vous faciliter la tâche, la référence Benchmarks d’évaluation disponibles inclut les liens pertinents.

Évaluez votre modèle

- Connectez-vous à W&B, puis cliquez sur Launch dans la barre latérale du projet. La page LLM Evaluation Jobs s’affiche.

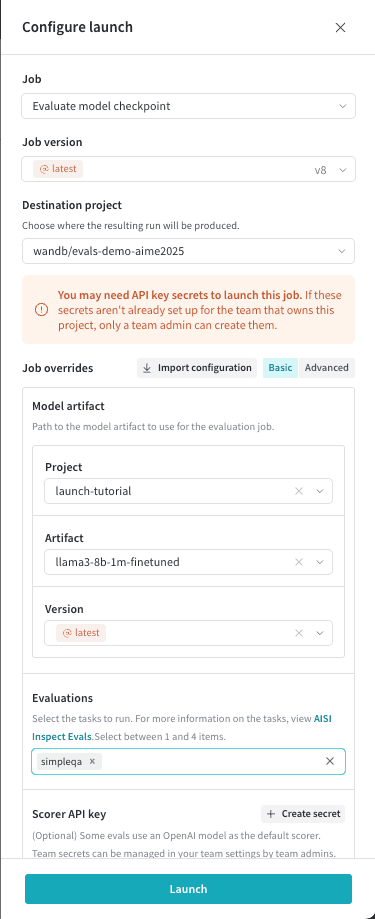

- Cliquez sur Evaluate model checkpoint pour configurer le job d’évaluation.

- Sélectionnez un projet de destination où enregistrer les résultats de l’évaluation.

- Dans la section Model artifact, indiquez le projet, l’artifact et la version du modèle préparé à évaluer.

- Cliquez sur Evaluations, puis sélectionnez jusqu’à quatre benchmarks.

- Si vous sélectionnez des benchmarks qui utilisent des modèles OpenAI pour le scoring, le champ Scorer API key s’affiche. Cliquez dessus, puis sélectionnez le secret

OPENAI_API_KEY. Pour plus de commodité, un administrateur d’équipe peut créer un secret depuis ce panneau en cliquant sur Create secret. - Si vous sélectionnez des benchmarks qui nécessitent l’accès à des jeux de données à accès restreint dans Hugging Face, un champ Hugging Face token s’affiche. Demandez l’accès au jeu de données concerné, puis sélectionnez le secret qui contient le jeton d’accès utilisateur Hugging Face.

- Si vous le souhaitez, définissez Sample limit sur un entier positif pour limiter le nombre maximal d’échantillons de benchmark à évaluer. Sinon, tous les échantillons de la tâche sont inclus.

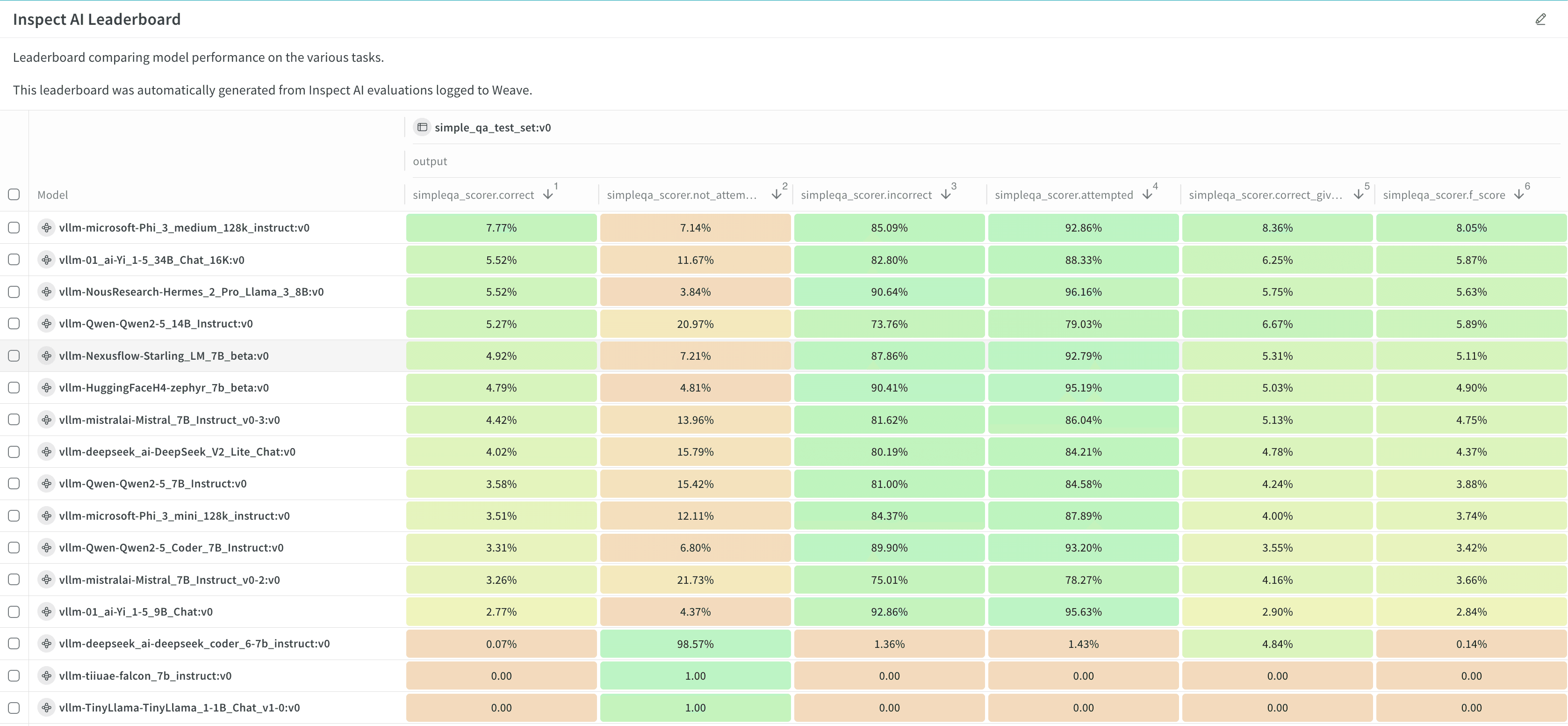

- Pour créer automatiquement un classement, cliquez sur Publish results to leaderboard. Le classement affichera toutes les évaluations dans un panneau Workspace, et vous pourrez aussi le partager dans un rapport.

- Cliquez sur Launch pour lancer le job d’évaluation.

- Cliquez sur l’icône en forme de flèche circulaire en haut de la page pour ouvrir la fenêtre modale des runs récents. Les jobs d’évaluation apparaissent avec vos autres runs récents. Cliquez sur le nom d’un run terminé pour l’ouvrir dans la vue d’un seul run, ou cliquez sur le lien Leaderboard pour ouvrir directement le classement. Pour en savoir plus, voir Afficher les résultats.

Consulter les résultats de l’évaluation

- Cliquez sur l’icône en forme de flèche circulaire en haut de la page pour ouvrir la fenêtre modale des runs récents, où les jobs d’évaluation apparaissent avec les autres Runs du projet. Si le job d’évaluation comporte un leaderboard, cliquez sur Leaderboard pour l’ouvrir en plein écran, ou cliquez sur un nom de run pour l’ouvrir dans le projet en vue d’exécution unique.

- Consultez les traces du job d’évaluation dans la section Évaluations d’un Workspace ou dans l’onglet Traces du panneau latéral Weave.

- Cliquez sur l’onglet Aperçu pour afficher des informations détaillées sur le job d’évaluation, notamment sa configuration et ses métriques récapitulatives.

- Cliquez sur l’onglet Logs pour afficher, rechercher ou télécharger les journaux de débogage du job d’évaluation.

- Cliquez sur l’onglet Files pour parcourir, afficher ou télécharger les fichiers du job d’évaluation, y compris le code, les journaux, la configuration et d’autres fichiers de sortie.

Personnaliser un leaderboard

- Par défaut, tous les jobs d’évaluation sont affichés. Filtrez ou recherchez un job d’évaluation à l’aide du sélecteur de run à gauche.

- Par défaut, les jobs d’évaluation ne sont pas regroupés. Pour regrouper par une ou plusieurs colonnes, cliquez sur l’icône Group. Vous pouvez afficher ou masquer un groupe, ou développer un groupe pour voir ses Runs.

- Par défaut, toutes les opérations sont affichées. Pour n’afficher qu’une seule opération, cliquez sur All ops et sélectionnez une opération.

- Pour trier par une colonne, cliquez sur l’en-tête de la colonne. Pour personnaliser l’affichage des colonnes, cliquez sur Colonne.

- Par défaut, les en-têtes sont organisés sur un seul niveau. Vous pouvez augmenter la profondeur des en-têtes pour regrouper les en-têtes associés.

- Sélectionnez ou désélectionnez des colonnes individuelles pour les afficher ou les masquer, ou affichez ou masquez toutes les colonnes en un clic.

- Épinglez des colonnes pour les afficher avant les colonnes non épinglées.

Exporter un leaderboard

- Cliquez sur l’icône de téléchargement, située à côté du bouton Colonnes.

- Pour réduire la taille de l’export, seules les racines de trace sont exportées par défaut. Pour exporter des traces complètes, désactivez Racines de trace uniquement.

- Pour réduire la taille de l’export, le feedback et les coûts ne sont pas exportés par défaut. Pour les inclure dans l’export, activez Feedback ou Coûts.

- Par défaut, l’export est au format JSONL. Pour personnaliser le format, cliquez sur Exporter vers un fichier et sélectionnez un format.

- Pour exporter le leaderboard depuis votre navigateur, cliquez sur Exporter.

- Pour exporter le leaderboard par code, sélectionnez Python ou cURL, puis cliquez sur Copier et exécutez le script ou la commande.

Relancer un job d’évaluation

- Pour relancer le dernier job d’évaluation, suivez les étapes de Évaluer votre modèle. Sélectionnez le projet de destination ; les détails de l’artifact de modèle et les benchmarks sélectionnés la dernière fois sont alors renseignés automatiquement. Au besoin, apportez des ajustements, puis lancez le job d’évaluation.

- Pour relancer un job d’évaluation depuis l’onglet Runs du projet ou le sélecteur de run, survolez le nom du run et cliquez sur l’icône de lecture. Le volet de configuration du job s’affiche avec les paramètres préremplis. Au besoin, ajustez les paramètres, puis cliquez sur Launch.

- Pour relancer un job d’évaluation depuis un autre projet, importez sa configuration :

- Suivez les étapes de Évaluer votre modèle. Après avoir sélectionné le projet de destination, cliquez sur Importer la configuration.

- Sélectionnez le projet qui contient le job d’évaluation à importer, puis sélectionnez le run correspondant. Le volet de configuration du job s’affiche avec les paramètres préremplis.

- Au besoin, ajustez la configuration.

- Cliquez sur Launch.

Exporter la configuration d’un job d’évaluation

- Ouvrez le run dans la vue dédiée à un seul run.

- Cliquez sur l’onglet Files.

- Cliquez sur le bouton de téléchargement à côté de

config.yamlpour le télécharger en local.