새로운 Mistral v1.0 SDK를 지원합니다. 마이그레이션 가이드는 여기에서 확인하세요.

트레이스

weave.init()을 호출하면 됩니다:

직접 정의한 ops로 감싸기

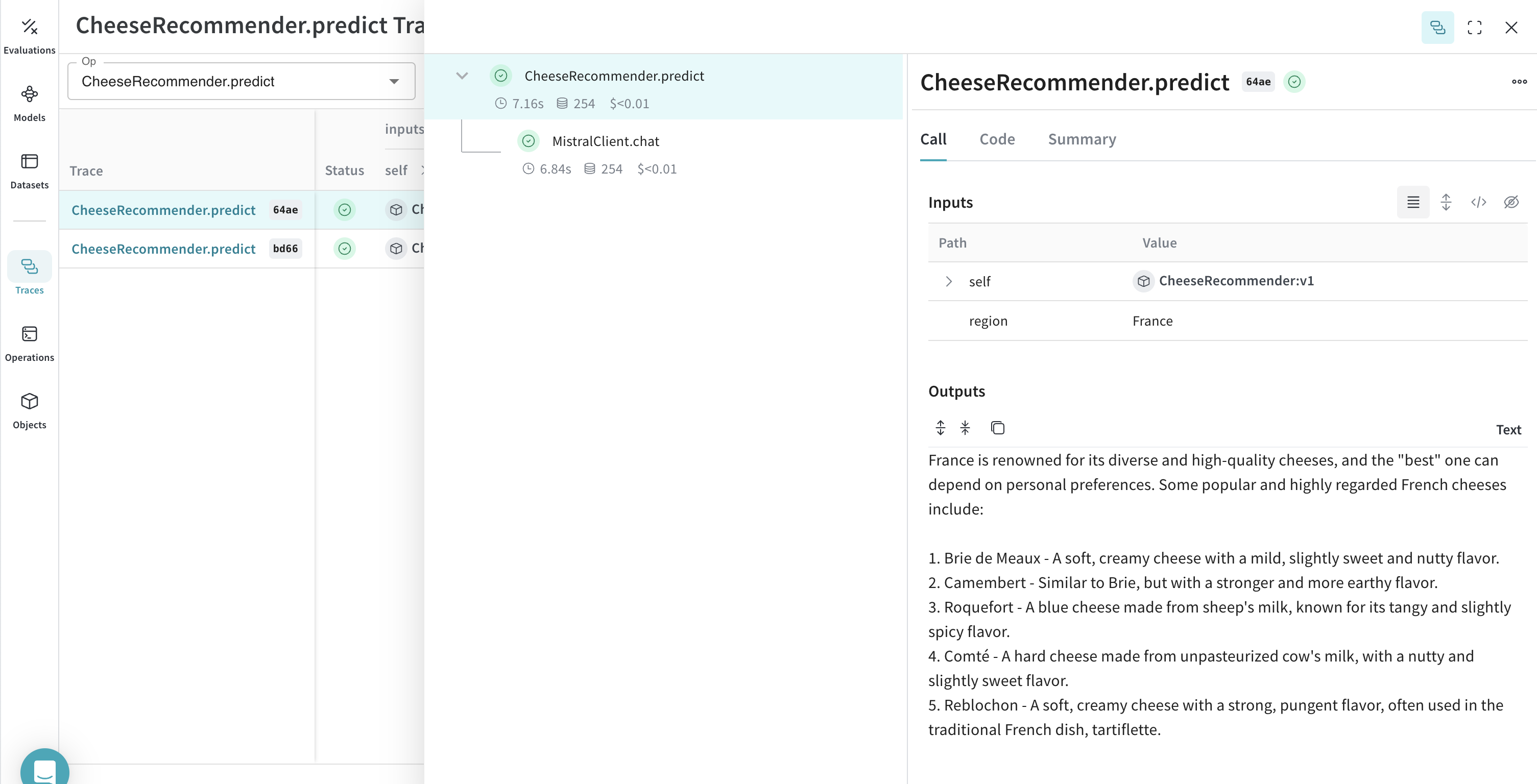

@weave.op() 데코레이터를 적용한 함수를 하나 만들고 그 안에서 mistralai.client.MistralClient.chat()을 호출하기만 하면, Weave가 해당 입력과 출력을 자동으로 추적합니다. 이제 이 방식을 우리 치즈 추천기(cheese recommender)에 어떻게 적용할 수 있는지 살펴보겠습니다:

더 쉬운 실험을 위해 Model 만들기

Model 클래스를 사용하면 시스템 프롬프트나 사용 중인 모델처럼 앱의 실험 관련 세부 정보를 캡처하고 정리할 수 있습니다. 이렇게 하면 앱의 다양한 반복 버전을 정리하고 비교하기가 더 쉬워집니다.

코드 버저닝과 입력/출력 캡처 외에도 Model은 애플리케이션 동작을 제어하는 구조화된 파라미터를 캡처하므로, 어떤 파라미터가 가장 잘 작동했는지 쉽게 찾을 수 있습니다. 또한 Weave Models를 serve 및 Evaluation과 함께 사용할 수 있습니다.

아래 예시에서는 model과 country를 변경하며 실험할 수 있습니다. 둘 중 하나를 변경할 때마다 CheeseRecommender의 새로운 버전이 생성됩니다.