이 노트북은 대화형 노트북입니다. 로컬에서 실행하거나 아래 링크를 통해 열 수 있습니다:

Not Diamond를 활용한 LLM 프롬프트 커스텀 라우팅

프롬프트 라우팅

커스텀 라우팅

- LLM 프롬프트 집합: 프롬프트는 문자열이어야 하며, 애플리케이션에서 사용하는 프롬프트를 대표해야 합니다.

- LLM 응답: 각 입력에 대한 후보 LLM들의 응답. 후보 LLM에는 지원되는 LLM과 직접 만든 커스텀 모델 모두를 포함할 수 있습니다.

- 후보 LLM의 각 입력에 대한 응답에 대한 평가 점수: 점수는 숫자이며, 필요에 맞는 어떤 메트릭이든 사용할 수 있습니다.

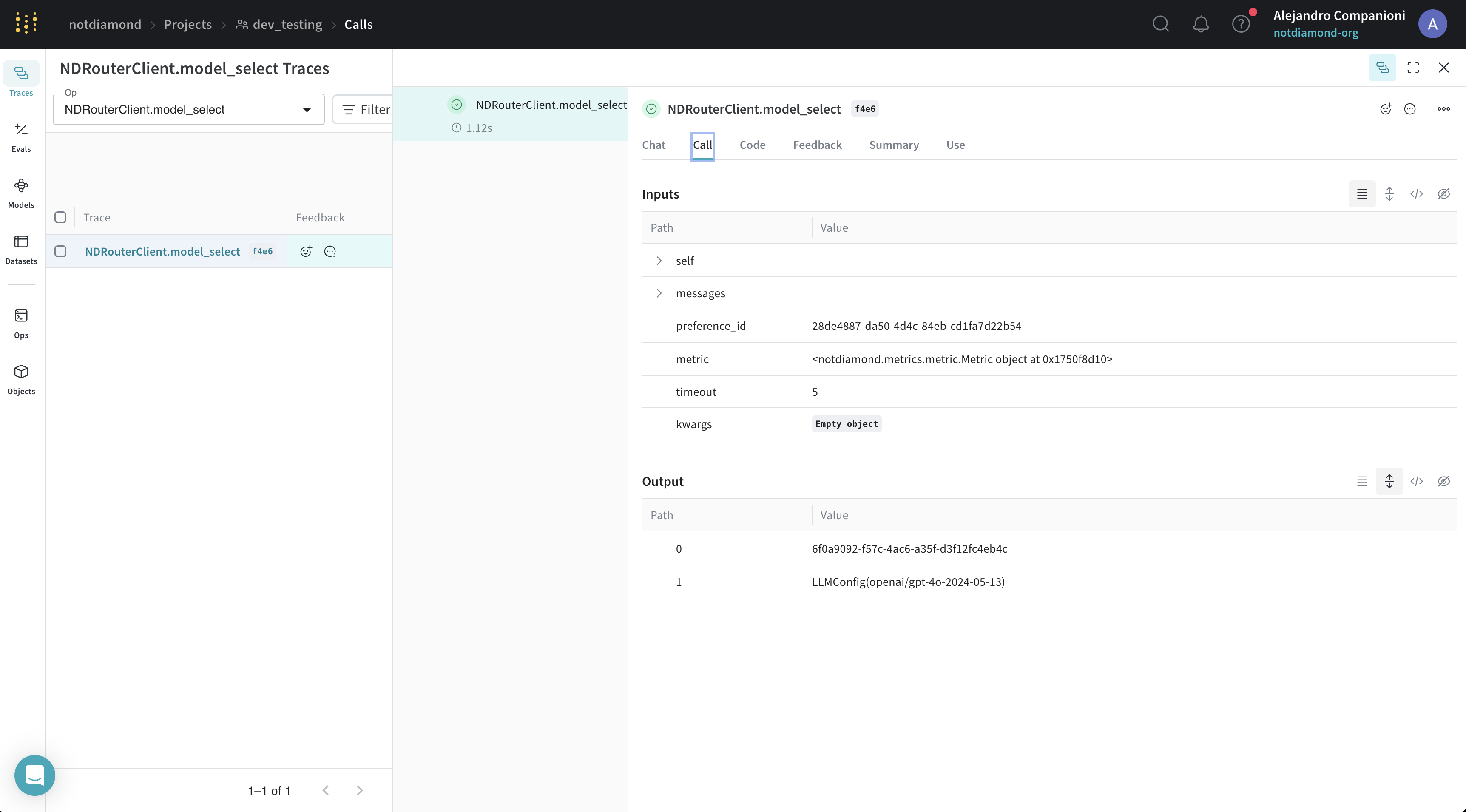

트레이닝 데이터 설정

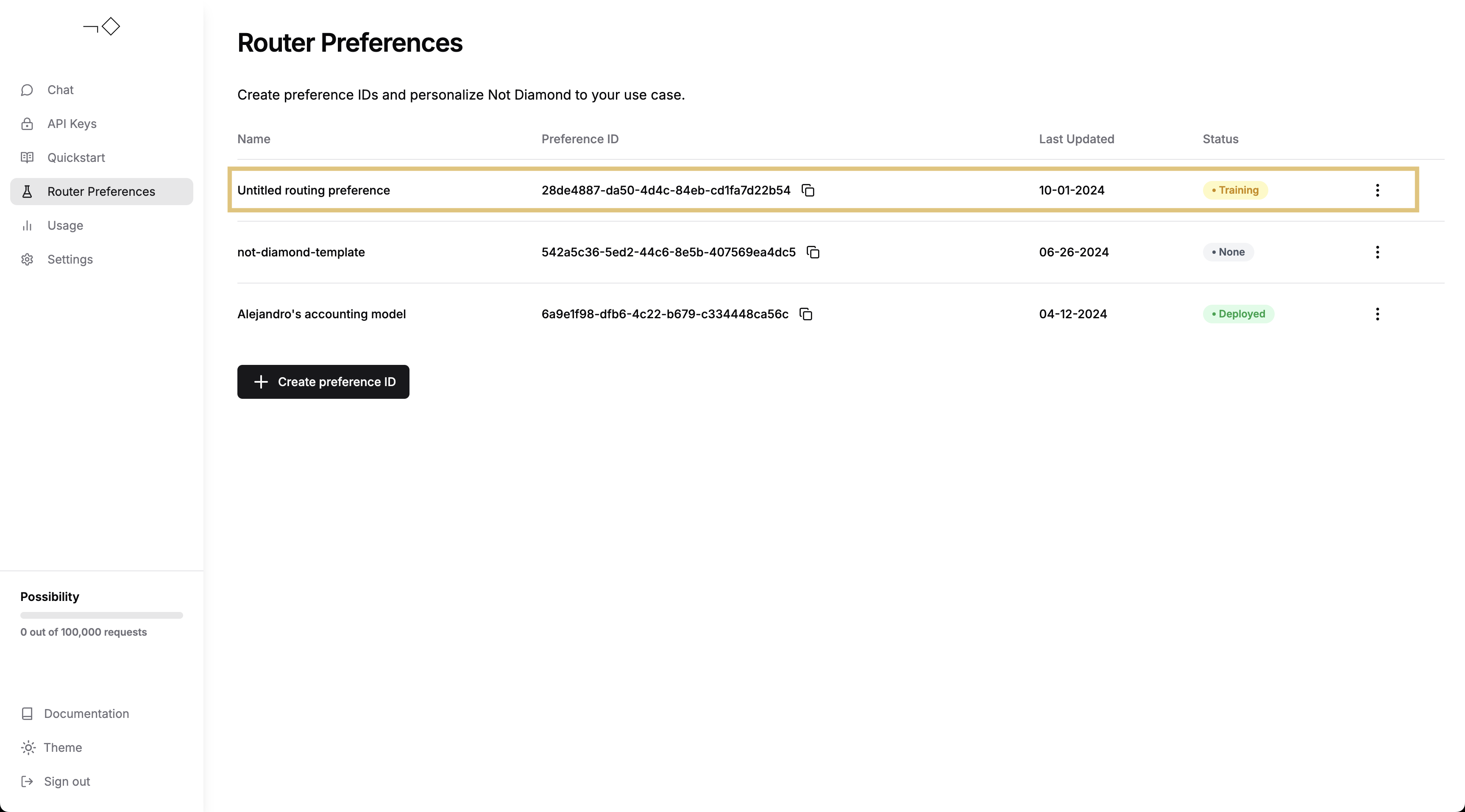

커스텀 라우터 트레이닝

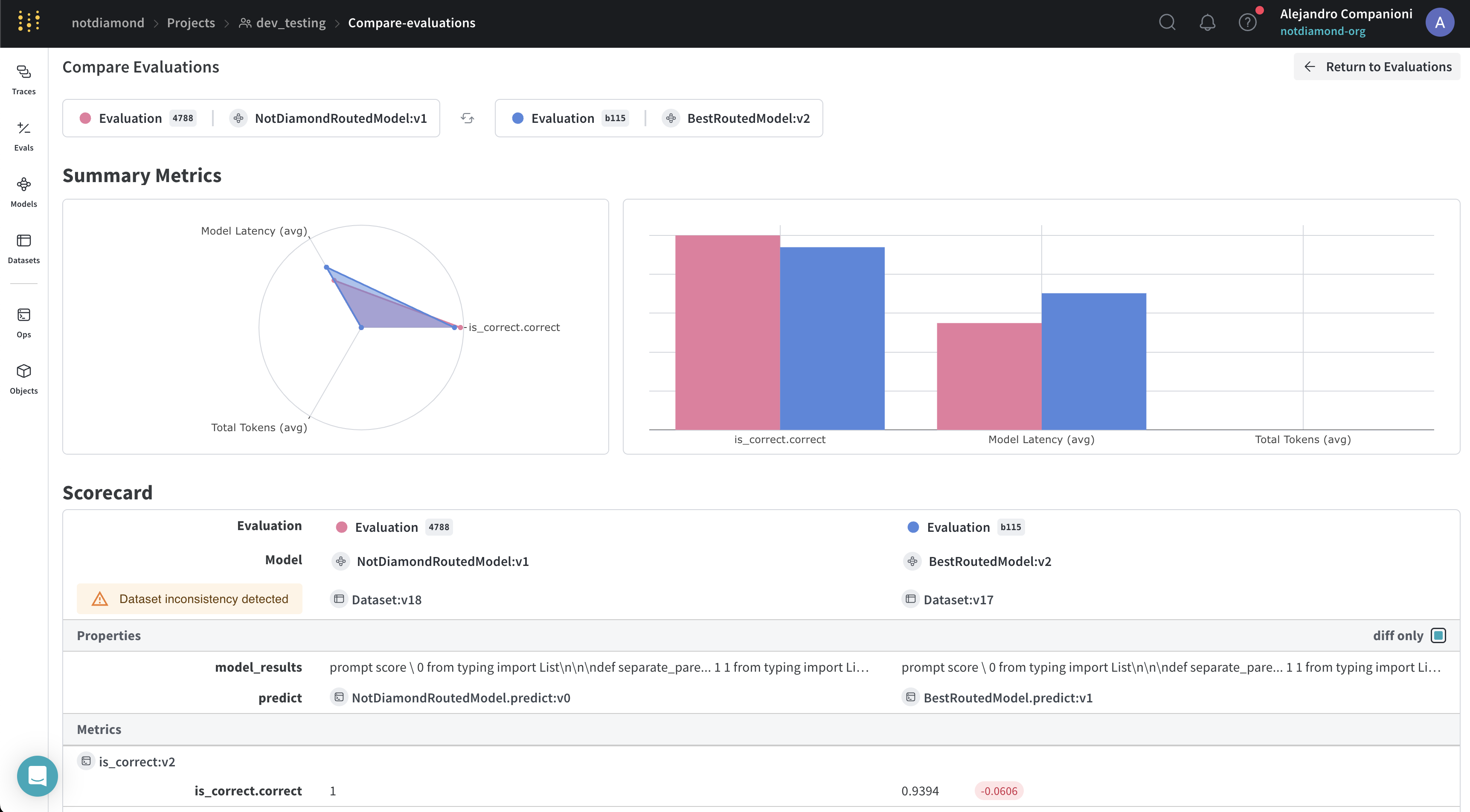

커스텀 라우터 평가하기

- 트레이닝 프롬프트를 제출하여 in-sample 성능을 평가하거나

- 새로운 프롬프트나 홀드아웃된 프롬프트를 제출하여 out-of-sample 성능을 평가합니다.