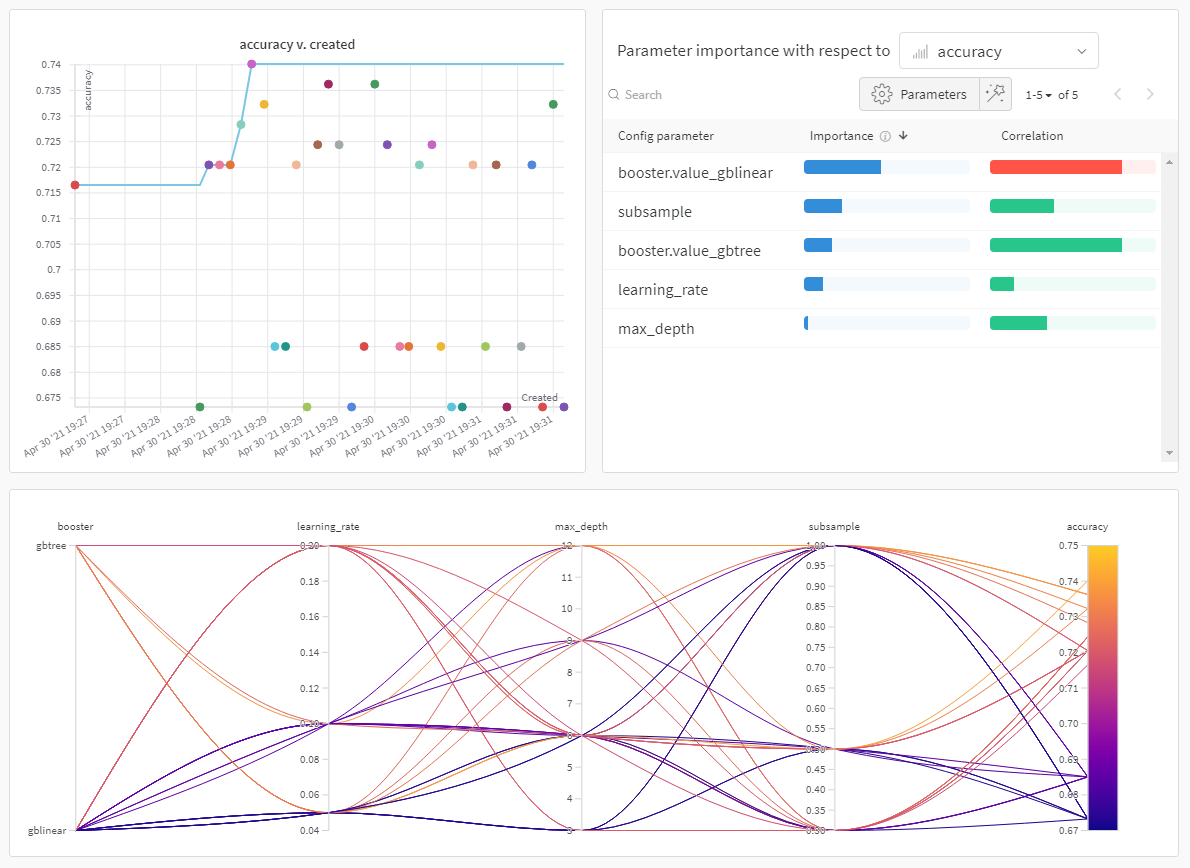

wandb 라이브러리는 XGBoost 트레이닝 중 생성되는 메트릭, 구성(config) 및 저장된 booster를 로깅하기 위한 WandbCallback 콜백을 제공합니다. 여기에서 XGBoost WandbCallback의 출력 결과를 보여주는 실시간 W&B 대시보드를 확인할 수 있습니다.

시작하기

WandbCallback만 XGBoost에 넘겨주면 될 정도로 간단합니다.

WandbCallback 참조

기능

WandbCallback을 XGBoost 모델에 전달하면 다음 작업을 수행합니다:

- booster 모델 설정을 W&B에 기록합니다

- XGBoost가 수집한 rmse, accuracy 등의 평가 메트릭을 W&B에 기록합니다

- XGBoost가 수집한 트레이닝 메트릭을 기록합니다 (eval_set에 데이터를 제공한 경우)

- 최상의 점수와 베스트 이터레이션을 기록합니다

- 학습된 모델을 저장하고 W&B Artifacts에 업로드합니다 (

log_model = True인 경우) log_feature_importance=True(기본값)일 때 feature importance 플롯을 기록합니다.define_metric=True(기본값)일 때 최상의 평가 메트릭을wandb.Run.summary에 저장합니다.

Arguments

-

log_model: (boolean) True이면 모델을 저장하고 W&B Artifacts에 업로드합니다 -

log_feature_importance: (boolean) True이면 feature importance 막대 그래프를 로깅합니다 -

importance_type: (str) 트리 모델의 경우{weight, gain, cover, total_gain, total_cover}중 하나입니다. 선형 모델의 경우 weight입니다. -

define_metric: (boolean) True(기본값)이면 트레이닝의 마지막 스텝이 아니라 최적 스텝에서의 모델 성능을run.summary에 기록합니다.

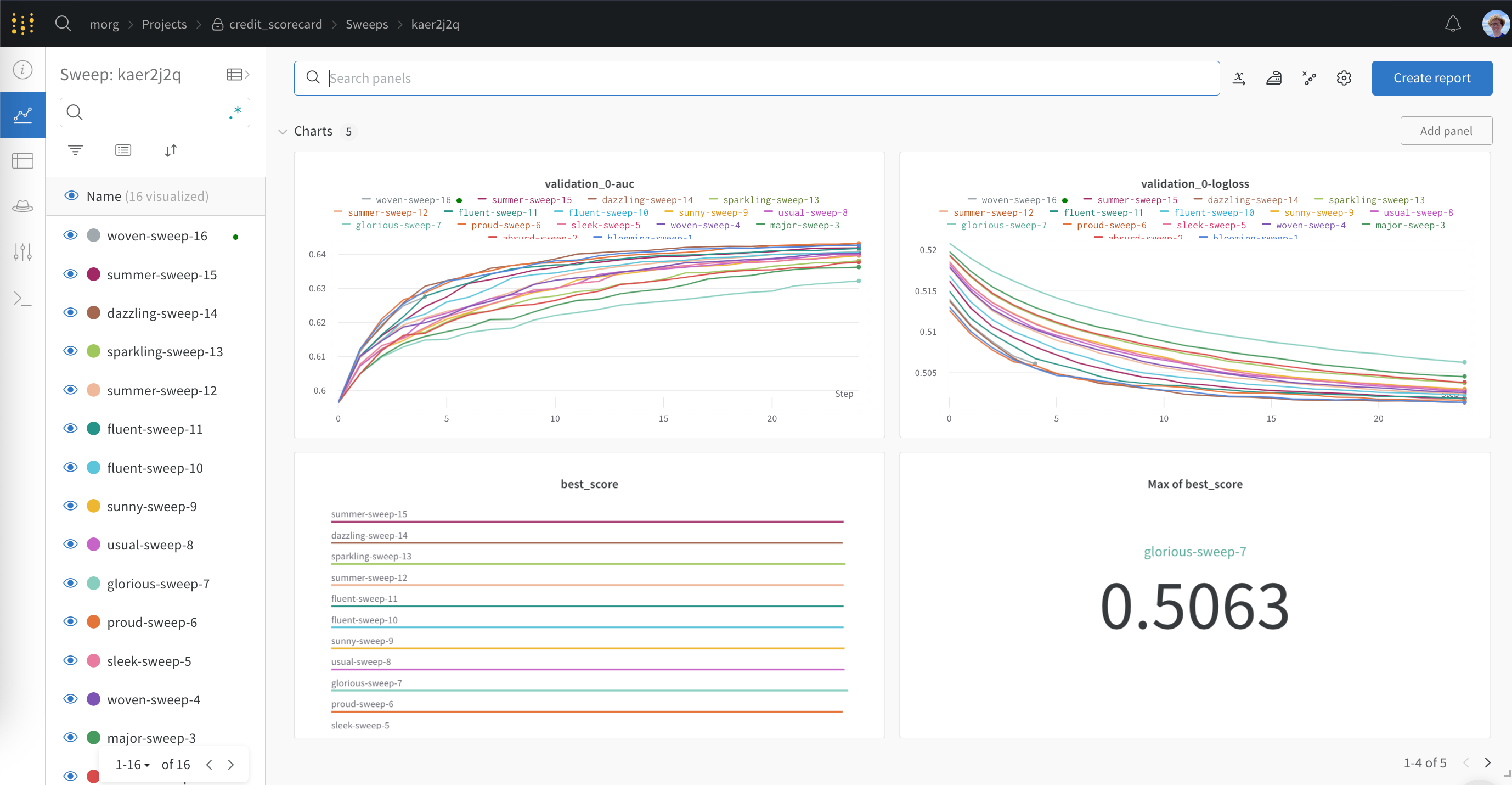

Sweeps로 하이퍼파라미터 튜닝하기