Voir la documentation OpenAI pour obtenir la liste des modèles que vous pouvez soumettre à un fine-tuning.

Installer ou mettre à jour OpenAI Python API

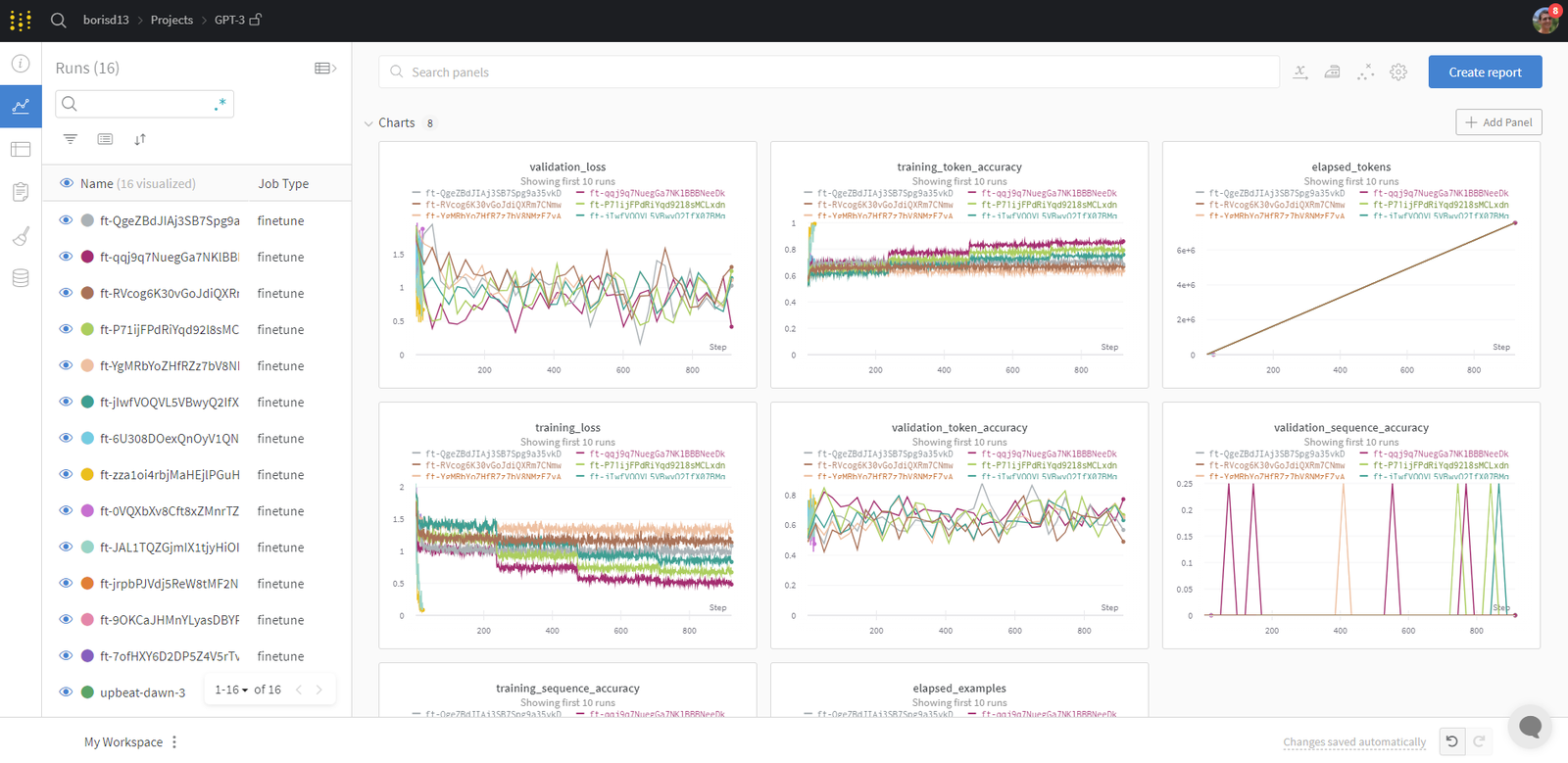

Synchronisez les résultats de votre fine-tuning OpenAI

WandbLogger du module wandb.integration.openai.fine_tuning.

Synchronisez vos fine-tunings

Référence

| Argument | Description |

|---|---|

| fine_tune_job_id | Il s’agit de l’ID OpenAI Fine-Tune que vous obtenez lorsque vous créez votre job de fine-tuning avec client.fine_tuning.jobs.create. Si cet argument vaut None (valeur par défaut), tous les jobs OpenAI de fine-tuning qui n’ont pas encore été synchronisés le seront avec W&B. |

| openai_client | Passez un client OpenAI initialisé à sync. Si aucun client n’est fourni, il est initialisé par le logger lui-même. Par défaut, sa valeur est None. |

| num_fine_tunes | Si aucun ID n’est fourni, tous les fine-tunings non synchronisés seront enregistrés dans W&B. Cet argument vous permet de sélectionner le nombre de fine-tunings récents à synchroniser. Si num_fine_tunes vaut 5, les 5 fine-tunings les plus récents sont sélectionnés. |

| project | nom du projet W&B dans lequel seront enregistrés vos métriques, modèles, données, etc. de fine-tuning. Par défaut, le nom du projet est “OpenAI-Fine-Tune.” |

| entity | Nom d’utilisateur W&B ou nom d’équipe vers lequel vous envoyez les runs. Par défaut, votre entité par défaut est utilisée, généralement votre nom d’utilisateur. |

| overwrite | Force la journalisation et écrase le run wandb existant du même job de fine-tuning. Par défaut, cette valeur est False. |

| wait_for_job_success | Une fois qu’un job OpenAI de fine-tuning est lancé, il prend généralement un certain temps. Pour garantir que vos métriques soient enregistrées dans W&B dès que le job de fine-tuning est terminé, ce paramètre vérifie toutes les 60 secondes si le statut du job de fine-tuning passe à succeeded. Dès que le job de fine-tuning est détecté comme réussi, les métriques sont automatiquement synchronisées avec W&B. La valeur par défaut est True. |

| model_artifact_name | Le nom de l’artifact de modèle enregistré. La valeur par défaut est "model-metadata". |

| model_artifact_type | Le type de l’artifact de modèle enregistré. La valeur par défaut est "model". |

| **kwargs_wandb_init | Tout argument supplémentaire transmis directement à wandb.init() |

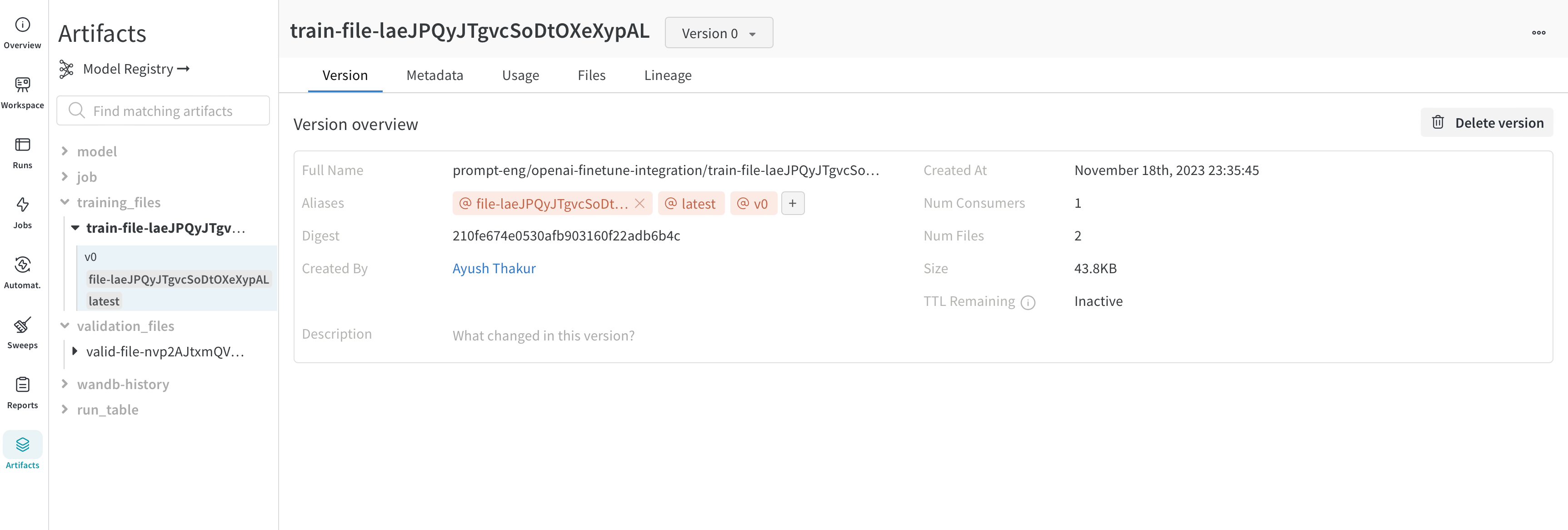

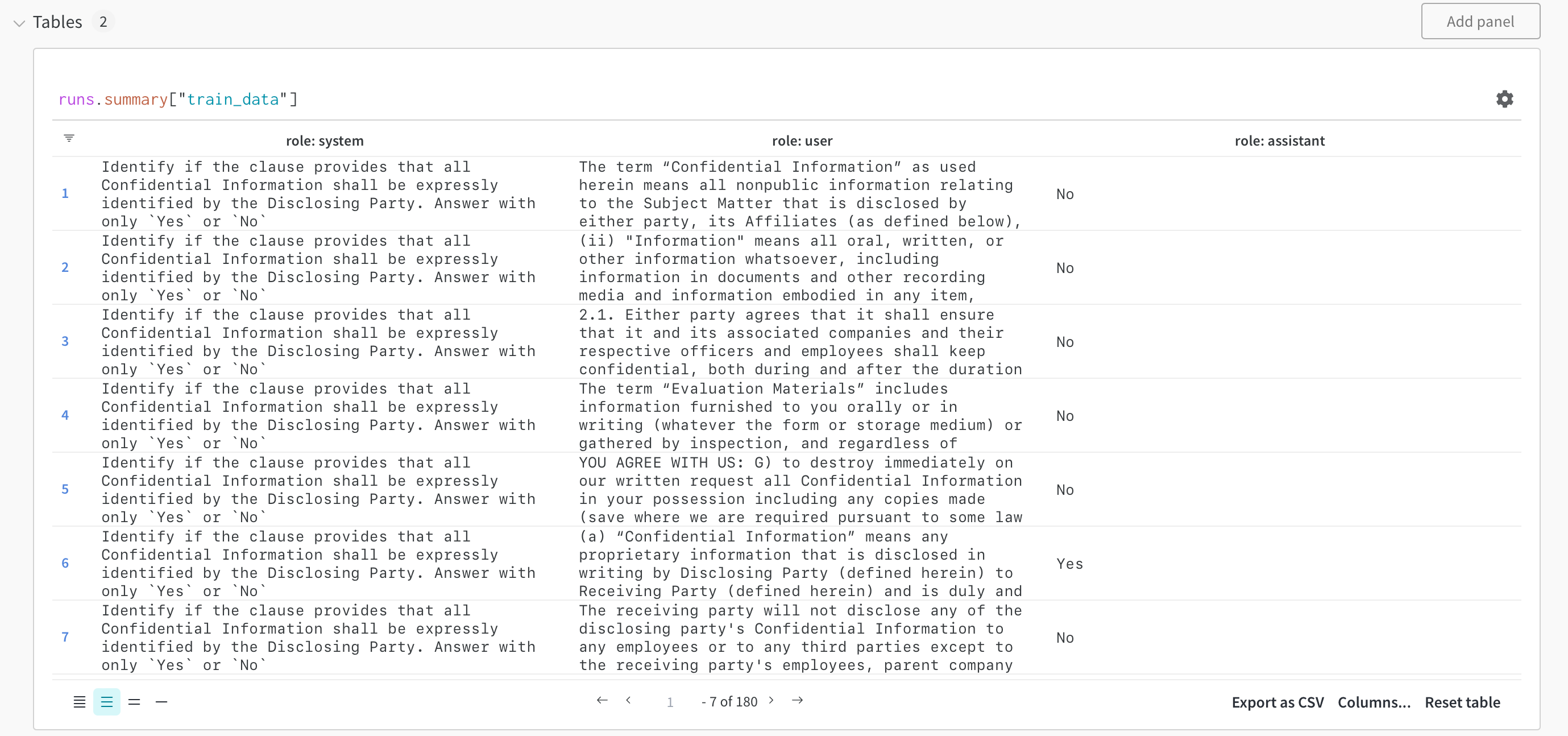

Gestion des versions et visualisation des jeux de données

Gestion des versions

Visualisation

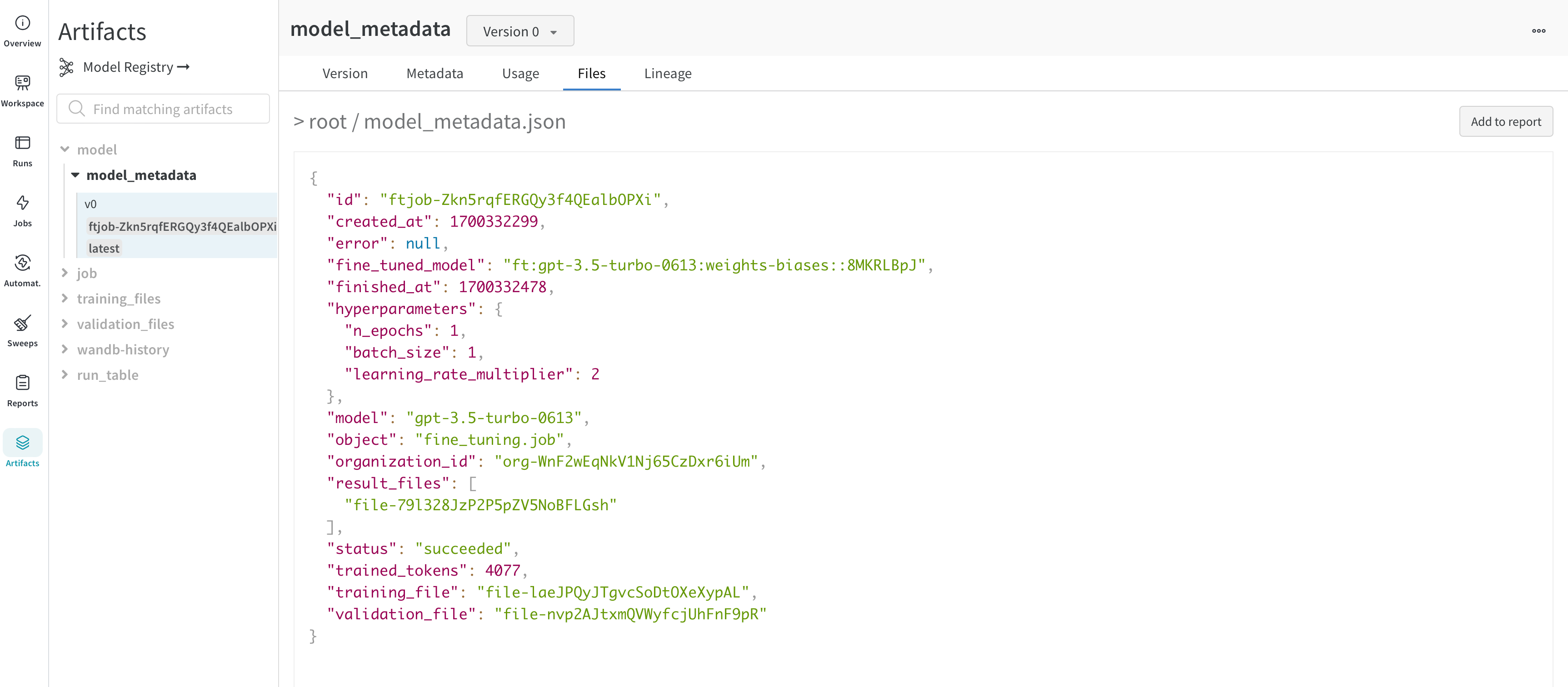

Le modèle affiné et la gestion des versions des modèles

WandbLogger crée un fichier model_metadata.json contenant tous les détails du modèle (hyperparamètres, ID des fichiers de données, etc.), ainsi que l’ID `fine_tuned_model“, puis l’enregistre en tant qu’Artifact W&B.

Cet Artifact de modèle (métadonnées) peut ensuite être lié à un modèle dans le W&B Registry.

Questions fréquentes

Comment puis-je organiser mes runs ?

Comment puis-je accéder à mon modèle affiné ?

model_metadata.json), ainsi que dans la configuration.

VERSION correspond à l’un des éléments suivants :

- un numéro de version comme

v2 - l’ID du fine-tuning, par exemple

ft-xxxxxxxxx - un alias ajouté automatiquement, comme

latest, ou ajouté manuellement

fine_tuned_model en lisant le fichier téléchargé model_metadata.json.

Que faire si un fine-tuning ne s’est pas synchronisé correctement ?

overwrite=True et passer l’ID du job de fine-tuning :

Puis-je suivre mes jeux de données et mes modèles avec W&B ?

wandb.Artifact, wandb.Run.log, etc. Cela vous permet d’assurer une traçabilité complète de vos données et de vos modèles.

Ressources

- La documentation OpenAI sur le Fine-tuning est très complète et contient de nombreux conseils utiles

- Colab de démonstration

- How to Fine-Tune Your OpenAI GPT-3.5 and GPT-4 Models with W&B Report