Voir l’intégration OpenAI pour le Fine-tuning pour savoir comment utiliser W&B afin de suivre vos expériences de Fine-tuning, vos modèles et vos jeux de données, et partager vos résultats avec vos collègues.

Installez la bibliothèque API Python d’OpenAI

Utiliser l’API Python d’OpenAI

1. Importez autolog et initialisez-le

autolog à partir de wandb.integration.openai, puis initialisez-le.

autolog un dictionnaire contenant les arguments acceptés par wandb.init(). Cela inclut un nom de projet, un nom d’équipe, une entité, et plus encore. Pour plus d’informations sur wandb.init(), consultez le guide de référence de l’API.

2. Appelez l’API OpenAI

3. Consultez les inputs et les réponses de votre API OpenAI

autolog à l’étape 1. Vous êtes alors redirigé vers l’espace de travail du projet dans W&B App.

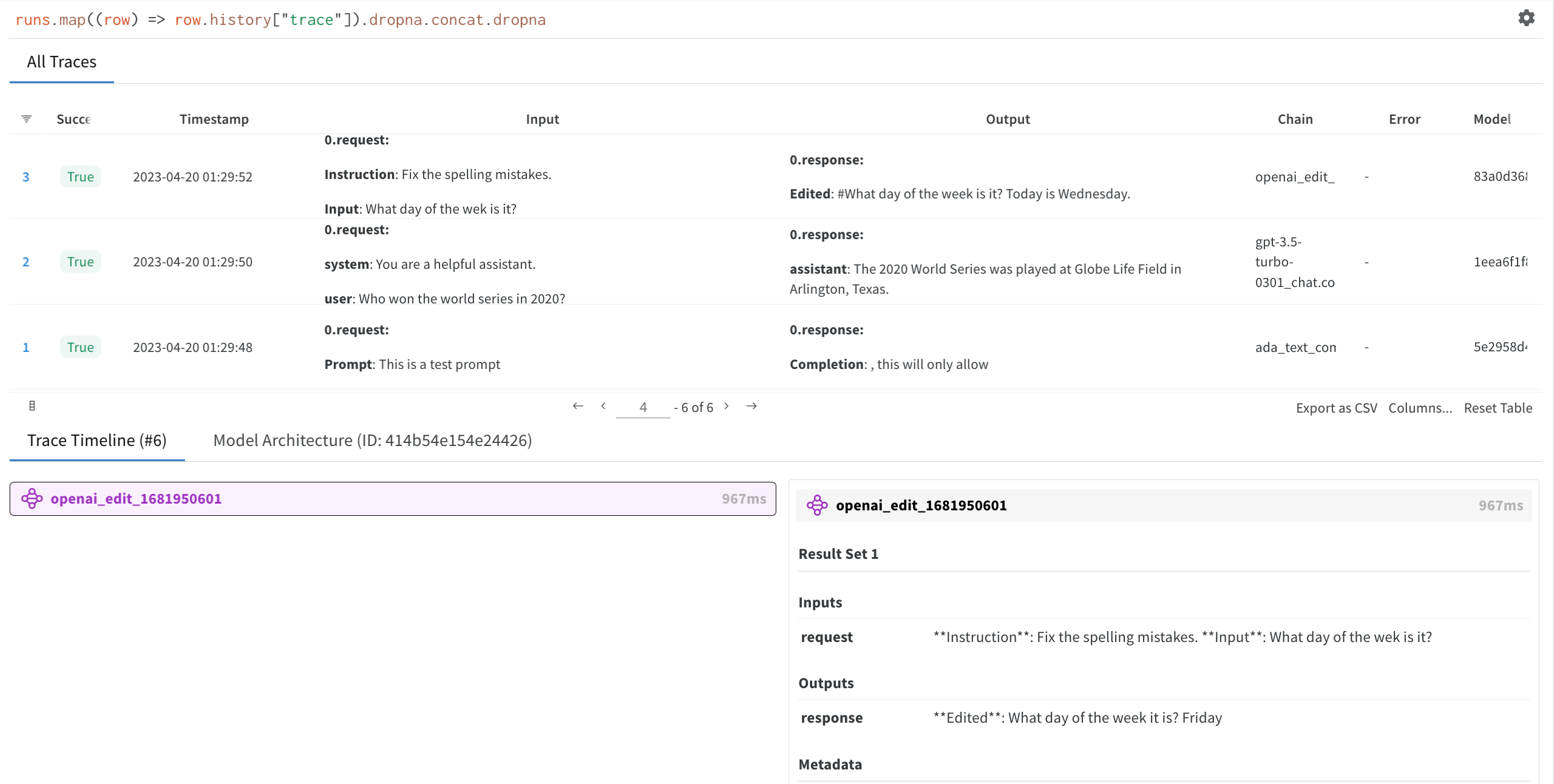

Sélectionnez un run que vous avez créé pour afficher le tableau des traces, la chronologie de la trace et l’architecture du modèle du LLM OpenAI utilisé.

Désactiver l’autolog

disable() pour fermer tous les processus W&B lorsque vous avez fini d’utiliser l’API OpenAI.