@weave.op() (Python), ou les encapsuler avec weave.op() (TypeScript).

Nous vous recommandons de décorer les fonctions et sous-fonctions de la manière la plus granulaire possible afin de capturer le flux d’exécution complet de l’application. Cela peut vous aider à mieux comprendre et à façonner le comportement de votre application.

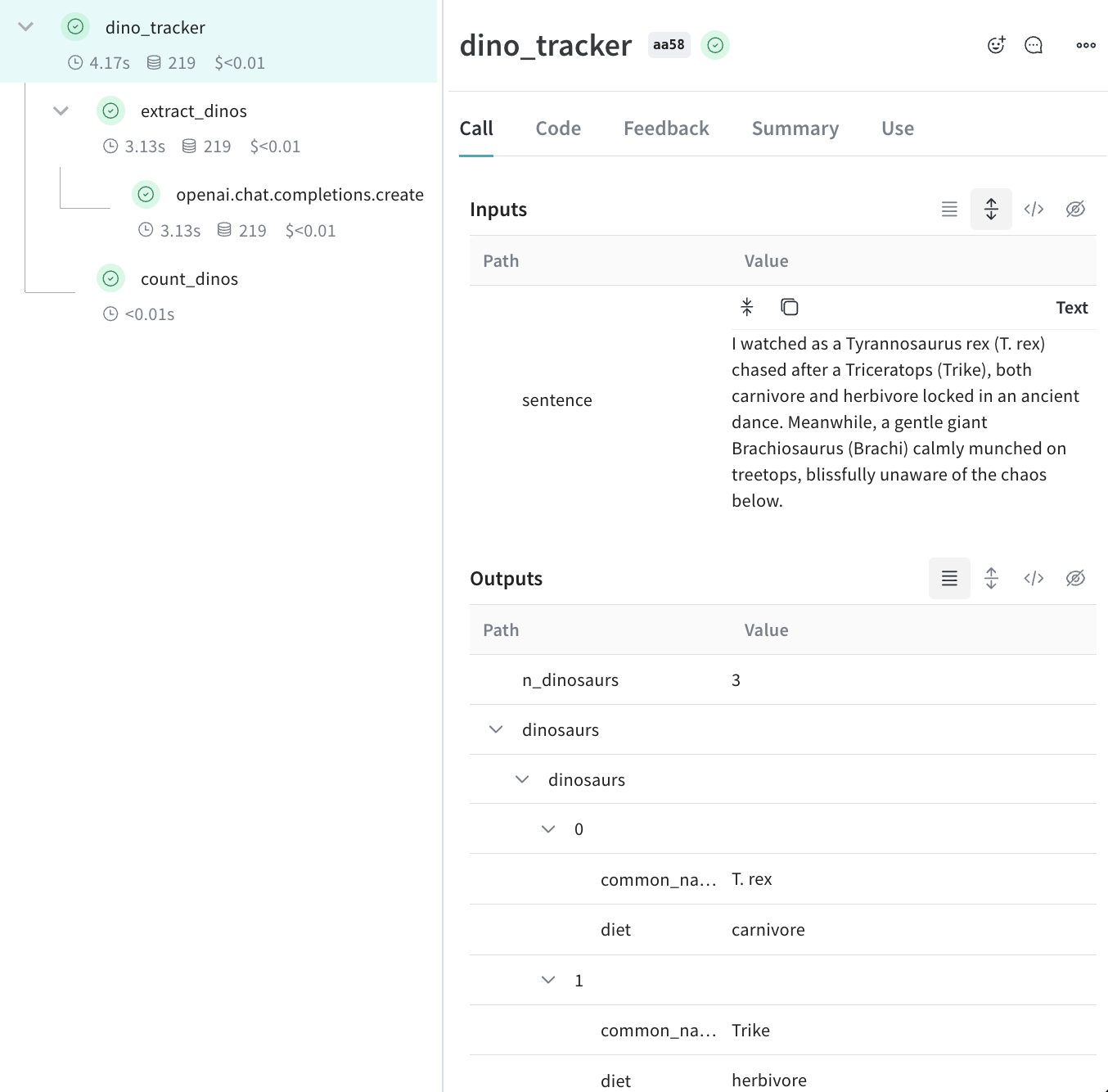

Le code suivant s’appuie sur l’exemple de démarrage rapide et ajoute une logique pour compter les éléments renvoyés par le LLM et les encapsuler dans une fonction de niveau supérieur. En outre, l’exemple utilise weave.op() pour tracer chaque fonction, son ordre d’appel et sa relation parent-enfant :

- Python

- TypeScript

extract_dinos et count_dinos), ainsi que la trace OpenAI enregistrée automatiquement.

Suivi des métadonnées

weave.attributes, en lui passant un dictionnaire contenant les métadonnées à suivre au moment de l’appel.

Pour reprendre notre exemple précédent :

- Python

- TypeScript

Nous vous recommandons de suivre les métadonnées au moment de l’exécution, comme les ID utilisateur et le statut de l’environnement de votre code (développement, staging ou production).Pour suivre les paramètres système, comme un prompt système, nous vous recommandons d’utiliser Weave Models.

Et ensuite ?

- Suivez le tutoriel sur la gestion des versions des applications pour enregistrer, gérer les versions et organiser les modifications ad hoc des prompts, des modèles et des applications.