- Accès rapide : Ouvrez le ‘Playground’ depuis le menu latéral de Weave pour démarrer une nouvelle session, ou depuis la page Appel pour tester un projet existant.

- Contrôles des messages : Modifiez, réessayez ou supprimez des messages directement dans le chat.

- Messagerie flexible : Ajoutez de nouveaux messages comme entrées utilisateur ou système, puis envoyez-les au LLM.

- Paramètres personnalisables : Configurez votre fournisseur LLM préféré et ajustez les paramètres du modèle.

- Prise en charge de plusieurs LLM : Passez d’un modèle à l’autre, avec une gestion des clés API au niveau de l’équipe.

- Comparer les modèles : Comparez la manière dont différents modèles répondent aux prompts.

- Fournisseurs personnalisés : Testez des API endpoints compatibles OpenAI pour des modèles personnalisés.

- Modèles enregistrés : Créez et configurez un préréglage de modèle réutilisable pour votre flux de travail

- Ajouter les identifiants et les informations du fournisseur

- Accéder au Playground

- Sélectionner un LLM

- Personnaliser les paramètres du Playground

- Contrôles des messages

- Comparer des LLM

- Fournisseurs personnalisés

- Modèles enregistrés

Ajouter les identifiants et informations du fournisseur

- Amazon Bedrock:

AWS_ACCESS_KEY_IDAWS_SECRET_ACCESS_KEYAWS_REGION_NAME

- Anthropic:

ANTHROPIC_API_KEY - Azure:

AZURE_API_KEYAZURE_API_BASEAZURE_API_VERSION

- Deepseek:

DEEPSEEK_API_KEY - Google:

GEMINI_API_KEY - Groq:

GROQ_API_KEY - Mistral:

MISTRAL_API_KEY - OpenAI:

OPENAI_API_KEY - X.AI:

XAI_API_KEY

Accéder au Playground

- Ouvrir une nouvelle page Playground avec un prompt système simple : dans la barre latérale d’un projet Weave, sélectionnez Playground. Playground s’ouvre dans le même onglet.

- Ouvrir Playground pour un Appel spécifique :

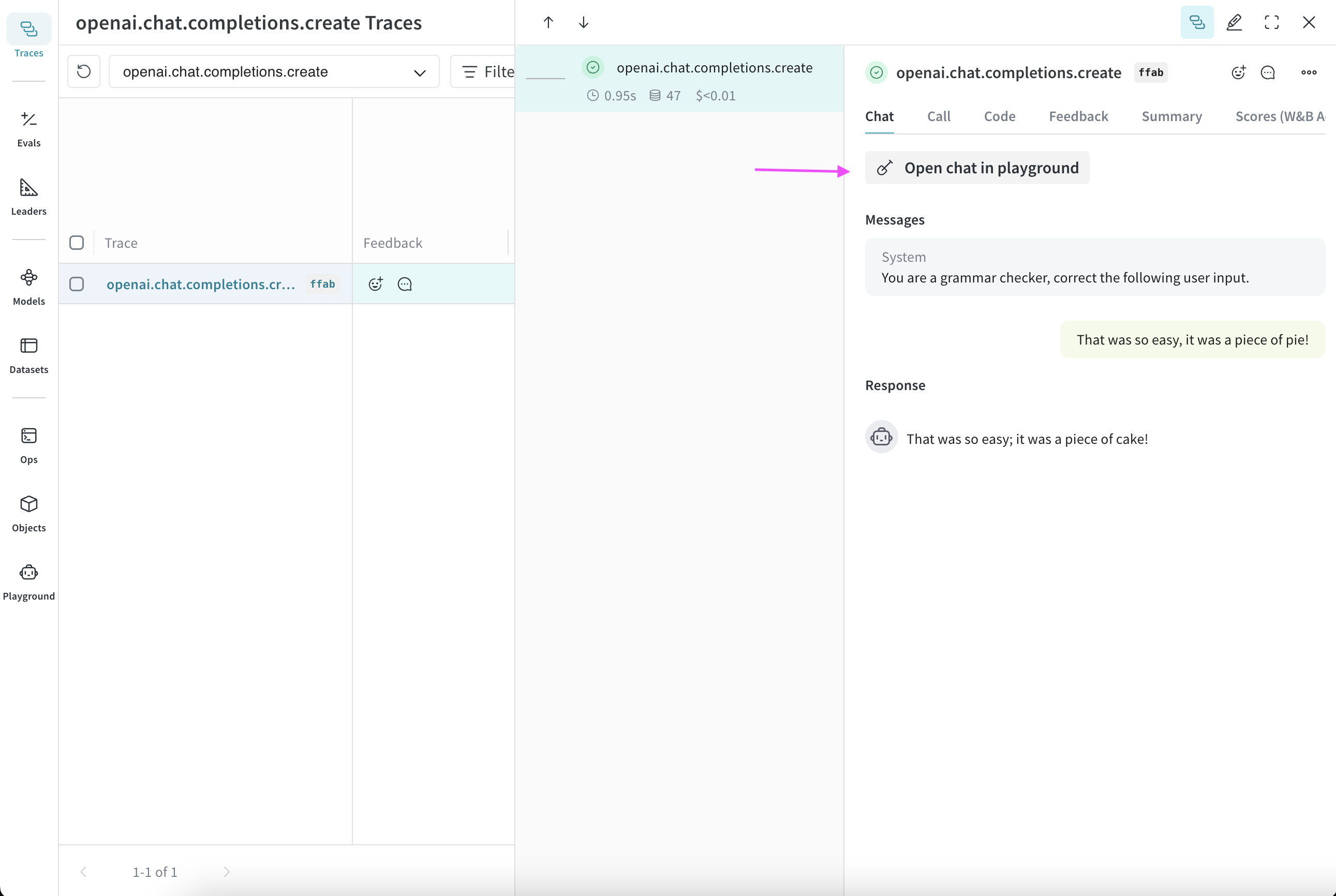

- Dans la barre latérale, sélectionnez l’onglet Traces. Une liste de traces s’affiche.

- Dans la liste des traces, cliquez sur le nom de l’Appel que vous souhaitez afficher. La page de détails de l’Appel s’ouvre.

- Cliquez sur Open chat in Playground. Playground s’ouvre dans un nouvel onglet.

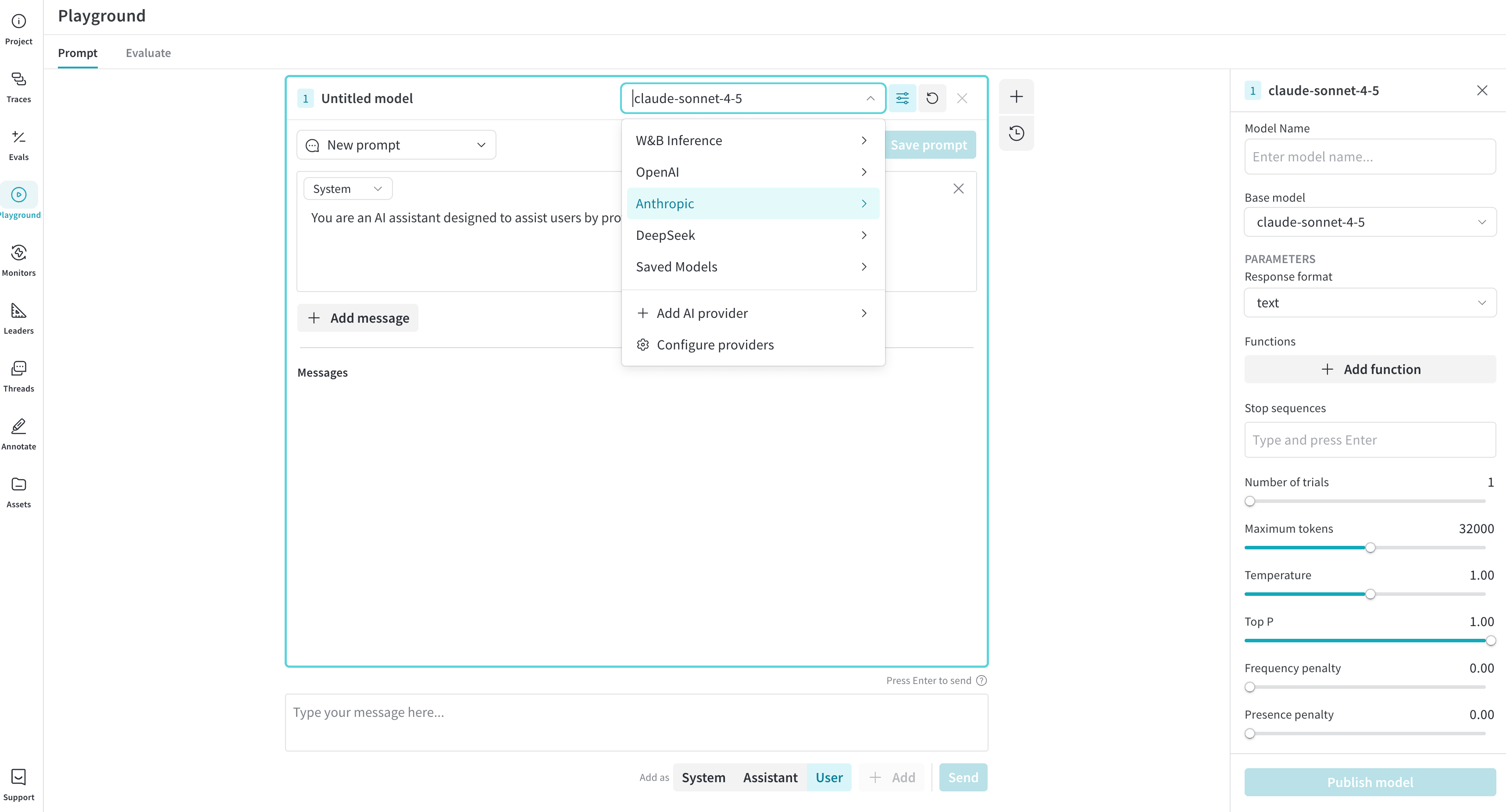

Sélectionner un LLM

- Amazon Bedrock

- Anthropic

- Azure

- Deepseek

- Groq

- Mistral

- OpenAI

- X.AI

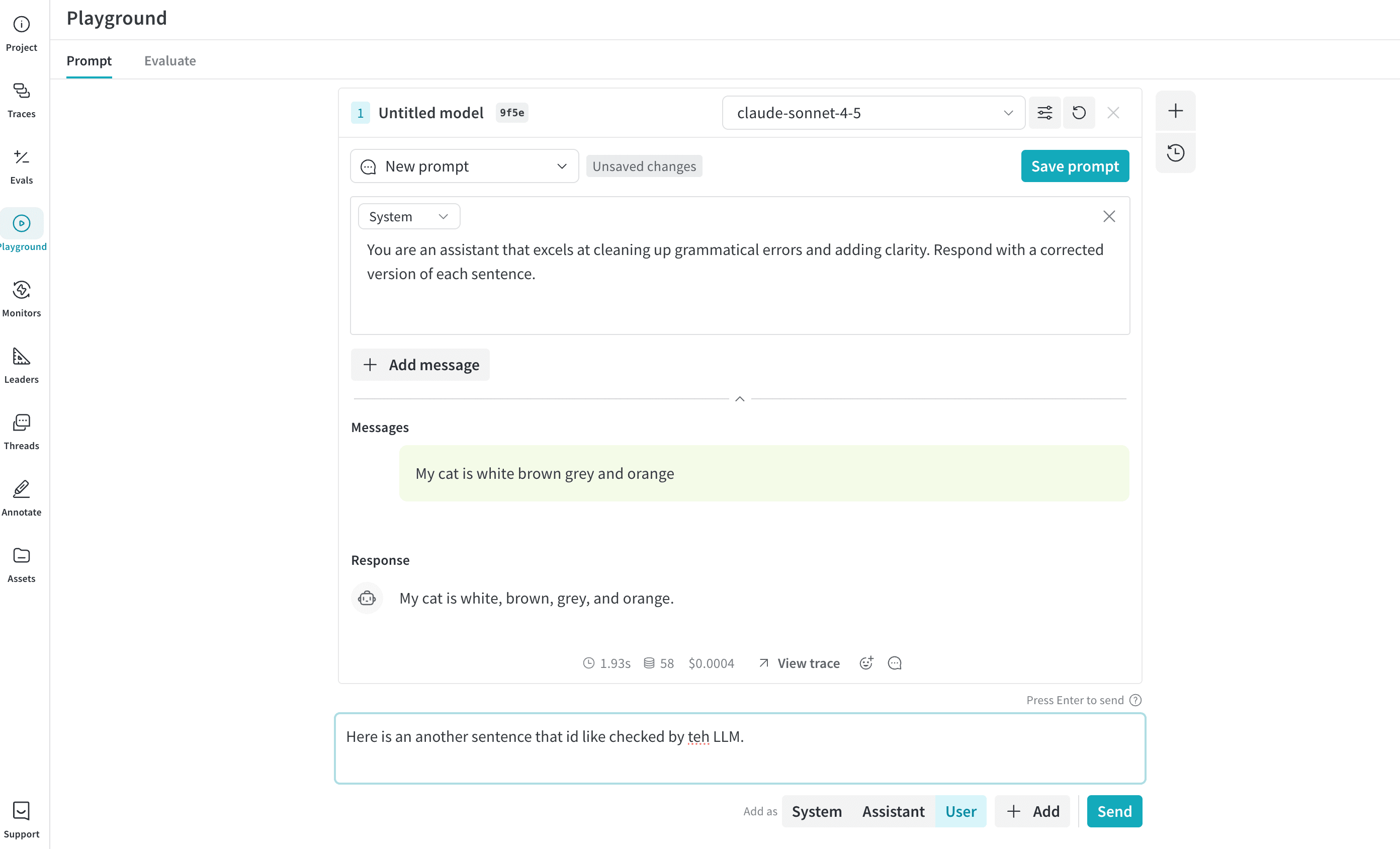

Personnaliser les paramètres du Playground

Ajuster les paramètres du LLM

- Dans le en-tête du prompt (en haut du panneau principal), cliquez sur le bouton Chat settings () pour ouvrir le panneau Chat settings.

- Dans le panneau Chat settings, ajustez les paramètres selon vos besoins. Vous pouvez également activer ou désactiver le suivi des appels Weave, et ajouter une fonction.

- Les modifications sont appliquées automatiquement. Cliquez de nouveau sur Chat settings, ou sur le x dans l’angle supérieur droit, pour fermer le panneau. Le texte au survol du bouton Chat settings se met à jour pour afficher les paramètres que vous avez modifiés.

1. Pour ajuster le nombre d’essais, ouvrez le panneau Chat settings et modifiez le paramètre Number of trials.

Ajouter une fonction

Options des messages

Zone de définition du prompt

- Sélecteur de prompt : sélectionnez un prompt enregistré existant ou créez-en un nouveau.

- Sélecteur de rôle du message : spécifiez le rôle du message que vous définissez (rôle System, Assistant ou User).

- Texte du prompt : saisissez le texte d’instruction qui définit la façon dont le modèle doit répondre.

- Bouton Add message : vous permet d’inclure des messages supplémentaires dans le contexte du prompt avant l’exécution.

- Ajouter des instructions système complémentaires.

- Fournir des exemples de messages de l’assistant pour orienter les réponses (par exemple avec le few-shot prompting).

- Prédéfinir des messages utilisateur afin de tester des scénarios spécifiques.

Panneau Messages

- Tous les messages prédéfinis inclus dans la configuration de l’invite.

- Les messages envoyés depuis le champ de saisie des messages.

- Les réponses renvoyées par le modèle.

Zone de composition des messages (champ de saisie)

Voir l’historique des messages

Comparer des LLM

Fournisseurs personnalisés

Ajouter un fournisseur personnalisé

- D’anciennes versions de fournisseurs de modèles pris en charge

- Des modèles locaux

- Dans le en-tête du prompt (en haut du panneau principal), cliquez sur la liste déroulante Select a model.

- Sélectionnez + Add AI provider.

- Sélectionnez Custom Provider.

- Dans la fenêtre modale, saisissez les informations du fournisseur :

- Provider name : un nom pour le fournisseur, comme

openaiouollama. - clé API : la clé API du fournisseur, par exemple une clé API OpenAI.

- Base URL : l’endpoint de base du fournisseur, comme

https://api.openai.com/v1/ou une URL ngrok telle quehttps://e452-2600-1700-45f0-3e10-2d3f-796b-d6f2-8ba7.ngrok-free.app. - Headers : (facultatif) une ou plusieurs paires clé-valeur d’en-têtes HTTP personnalisés.

- Models : un ou plusieurs modèles pour le fournisseur, comme

deepseek-r1ouqwq. - Max tokens : (facultatif) pour chaque modèle, le nombre maximal de tokens que le modèle peut générer dans une réponse.

- Une fois les informations du fournisseur saisies, cliquez sur Add provider.

- Sélectionnez votre nouveau fournisseur et le ou les modèles disponibles dans la liste déroulante Select a model.

Modifier un fournisseur personnalisé

- Dans l’en-tête du prompt, cliquez sur la liste déroulante Select a model. Sélectionnez ensuite +Configurer les fournisseurs.

- Vous pouvez également sélectionner Project dans le menu latéral, puis l’onglet Fournisseurs d’IA.

- Dans le tableau Fournisseurs personnalisés, repérez le fournisseur personnalisé que vous souhaitez mettre à jour.

- Dans la colonne Last Updated de l’entrée correspondant à votre fournisseur personnalisé, cliquez sur le bouton Modifier (l’icône en forme de crayon).

- Dans la fenêtre modale, modifiez les informations du fournisseur.

- Cliquez sur Enregistrer.

Supprimer un fournisseur personnalisé

- Dans le en-tête du prompt, cliquez sur la liste déroulante Select a model. Sélectionnez ensuite +Configure providers.

- Vous pouvez également, dans le menu latéral, sélectionner Project, puis l’onglet Fournisseurs d’IA.

- Dans le tableau Fournisseurs personnalisés, repérez le fournisseur personnalisé que vous souhaitez supprimer.

- Dans la colonne Last Updated de l’entrée correspondant à votre fournisseur personnalisé, cliquez sur le bouton de suppression (l’icône de corbeille).

- Dans la fenêtre modale, confirmez que vous souhaitez supprimer le fournisseur. Cette action est irréversible.

- Cliquez sur Delete.

Utiliser un modèle local comme fournisseur personnalisé

- Installez ngrok pour votre système d’exploitation.

-

Démarrez votre modèle Ollama :

-

Dans un autre terminal, créez un tunnel ngrok avec les en-têtes CORS requis :

-

Une fois ngrok lancé, une URL publique s’affiche, par exemple

https://xxxx-xxxx.ngrok-free.app. Utilisez cette URL comme Base URL lorsque vous ajoutez un fournisseur personnalisé dans le Playground.

Modèles enregistrés

Enregistrer un modèle

- Dans l’en-tête du prompt (en haut du panneau principal), dans la liste déroulante Select a model, sélectionnez un fournisseur et un modèle.

- Dans l’en-tête du prompt, cliquez sur le bouton Chat settings () pour ouvrir le panneau Chat settings.

- Dans le panneau Chat settings :

- Model Name (requis) : saisissez un nom pour votre modèle enregistré.

- Ajustez les paramètres selon vos besoins. Vous pouvez aussi activer ou désactiver le suivi des appels Weave, et ajouter une fonction.

- Cliquez sur Publish model. Le modèle est enregistré et accessible depuis Modèles enregistrés dans la liste déroulante Select a model. Vous pouvez maintenant utiliser et mettre à jour le modèle enregistré.

Utiliser un modèle enregistré

- Dans le en-tête du prompt, dans le menu déroulant Select a model, sélectionnez Modèles enregistrés.

- Dans la liste des modèles enregistrés, sélectionnez le modèle enregistré que vous souhaitez charger. Le modèle se charge et est prêt à être utilisé dans le Playground.

Mettre à jour un modèle enregistré

- Dans l’en-tête du prompt, dans le menu déroulant Select a model, sélectionnez Modèles enregistrés.

- Dans la liste des modèles enregistrés, sélectionnez le modèle enregistré que vous souhaitez mettre à jour.

- Dans l’en-tête du prompt, cliquez sur le bouton Chat settings () pour ouvrir le panneau Chat settings.

- Dans le panneau Chat settings, ajustez les paramètres selon vos besoins. Vous pouvez également activer ou désactiver le suivi des appels Weave, et ajouter une fonction.

- Cliquez sur Mettre à jour le modèle. Cela met à jour le modèle et le rend accessible depuis Modèles enregistrés dans le menu déroulant Select a model. La version de votre modèle enregistré augmente automatiquement.