Weave로 모델 평가하기

모델 평가의 주요 기능

- Scorers와 judges: 정확도, 관련성, 일관성 등 다양한 지표를 위한 기본 제공 및 사용자 정의 평가 메트릭

- 평가 데이터셋: 체계적인 평가를 위한 정답 레이블이 있는 구조화된 테스트 세트

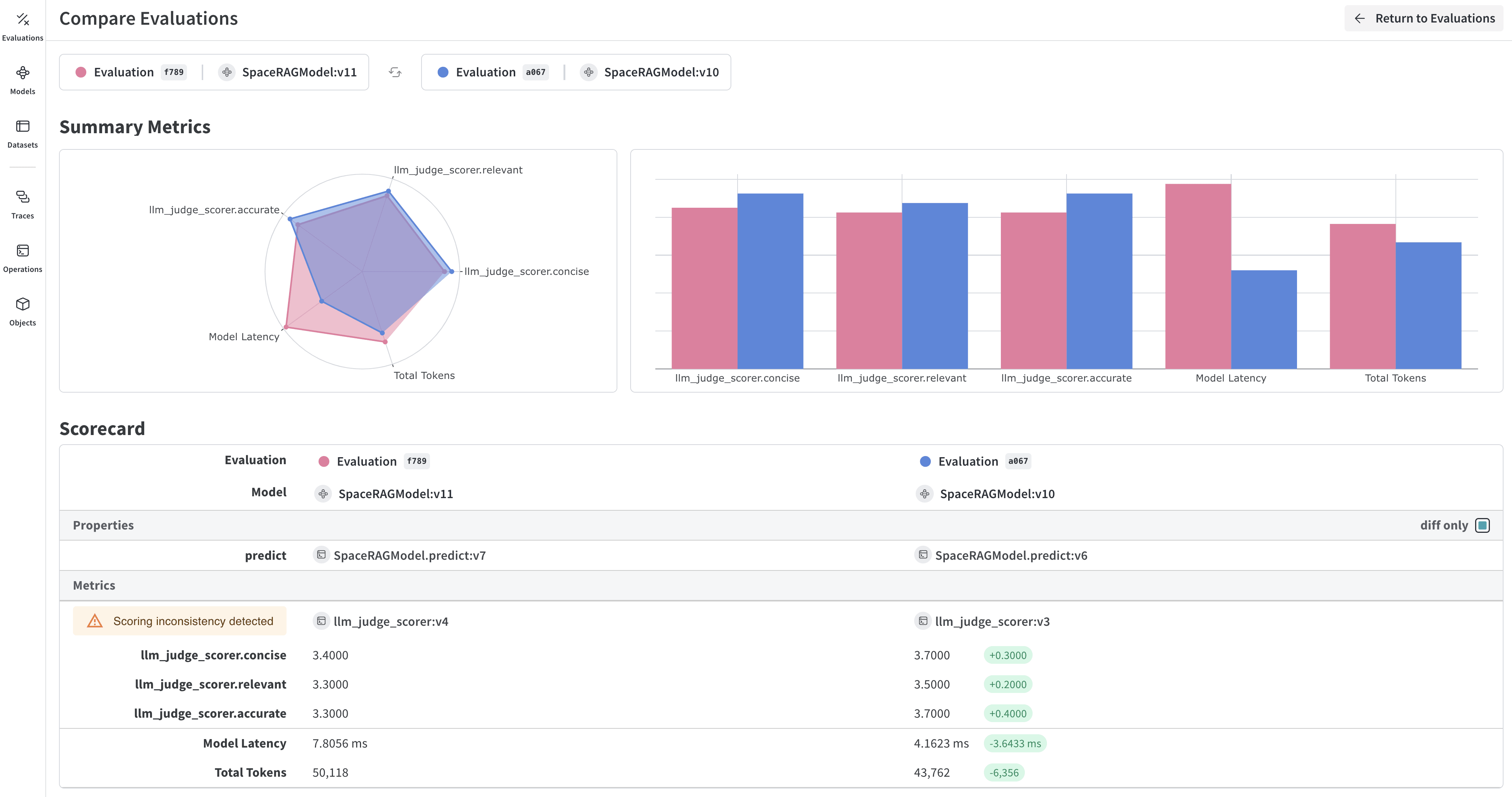

- 모델 버전 관리: 서로 다른 모델 버전의 추적 및 비교

- 상세 트레이싱: 전체 입력/출력 트레이스를 통한 모델 동작 분석

- 비용 추적: 평가 전반에 걸친 API 비용 및 토큰 사용량 모니터링

시작하기: W&B Models Registry에서 모델 평가하기

Weave 평가를 W&B Models와 통합하기

- Registry에서 모델 로드: W&B Models Registry에 저장된 파인튜닝된 모델을 다운로드합니다.

- 평가 파이프라인 생성: 커스텀 스코어러로 포괄적인 평가를 구성합니다.

- 결과를 W&B로 다시 로깅: 평가 메트릭을 모델 run과 연결합니다.

- 평가된 모델 버전 관리: 향상된 모델을 Registry에 다시 저장합니다.

Weave 고급 기능

사용자 정의 스코어러와 저지

배치 평가

다음 단계

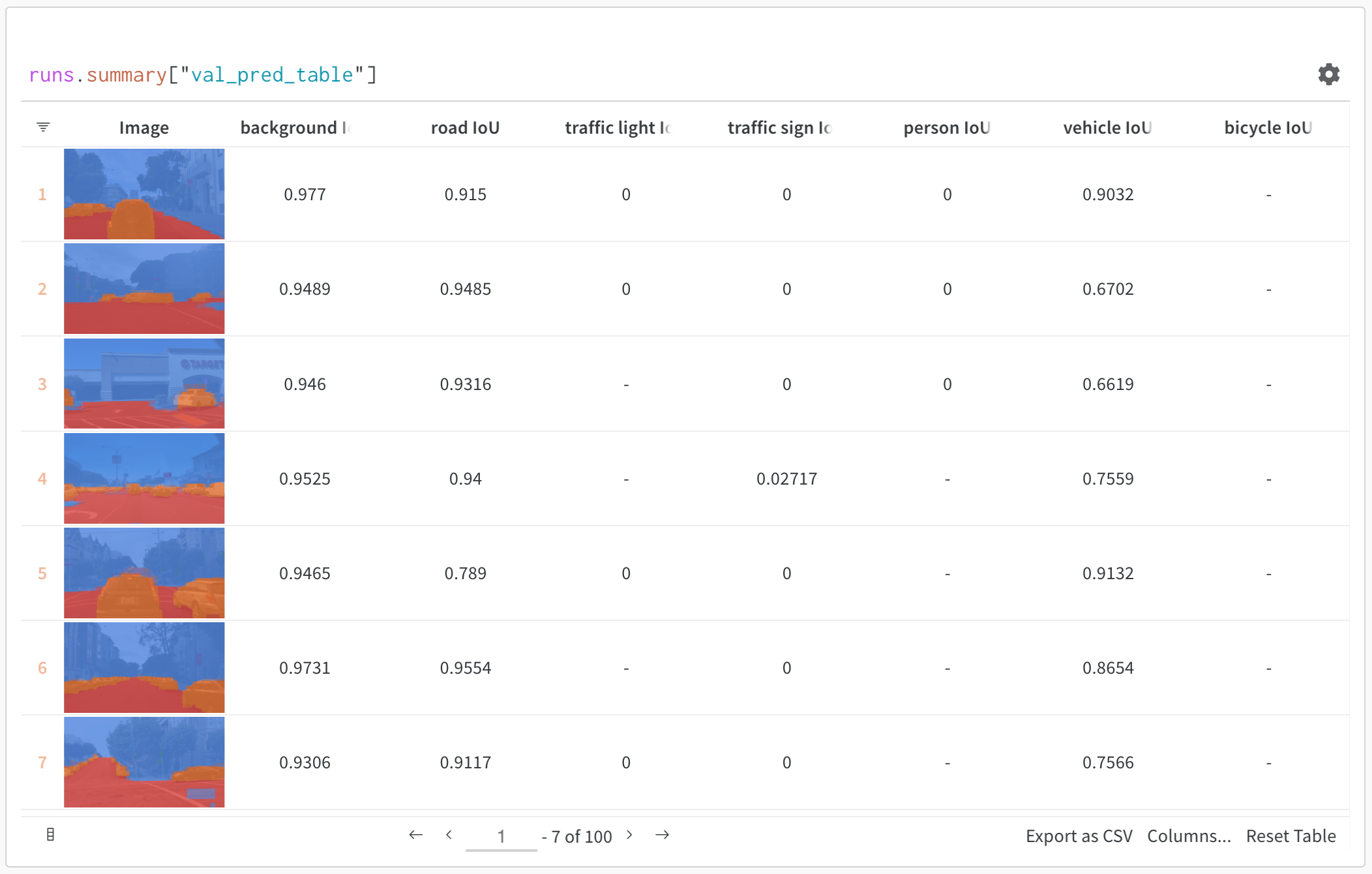

테이블로 모델 평가하기

- 모델 예측 비교: 서로 다른 모델이 동일한 테스트 세트에서 어떻게 동작하는지 나란히 비교해 볼 수 있습니다

- 예측 변화 추적: 에포크별 또는 모델 버전별로 예측이 어떻게 변화하는지 모니터링합니다

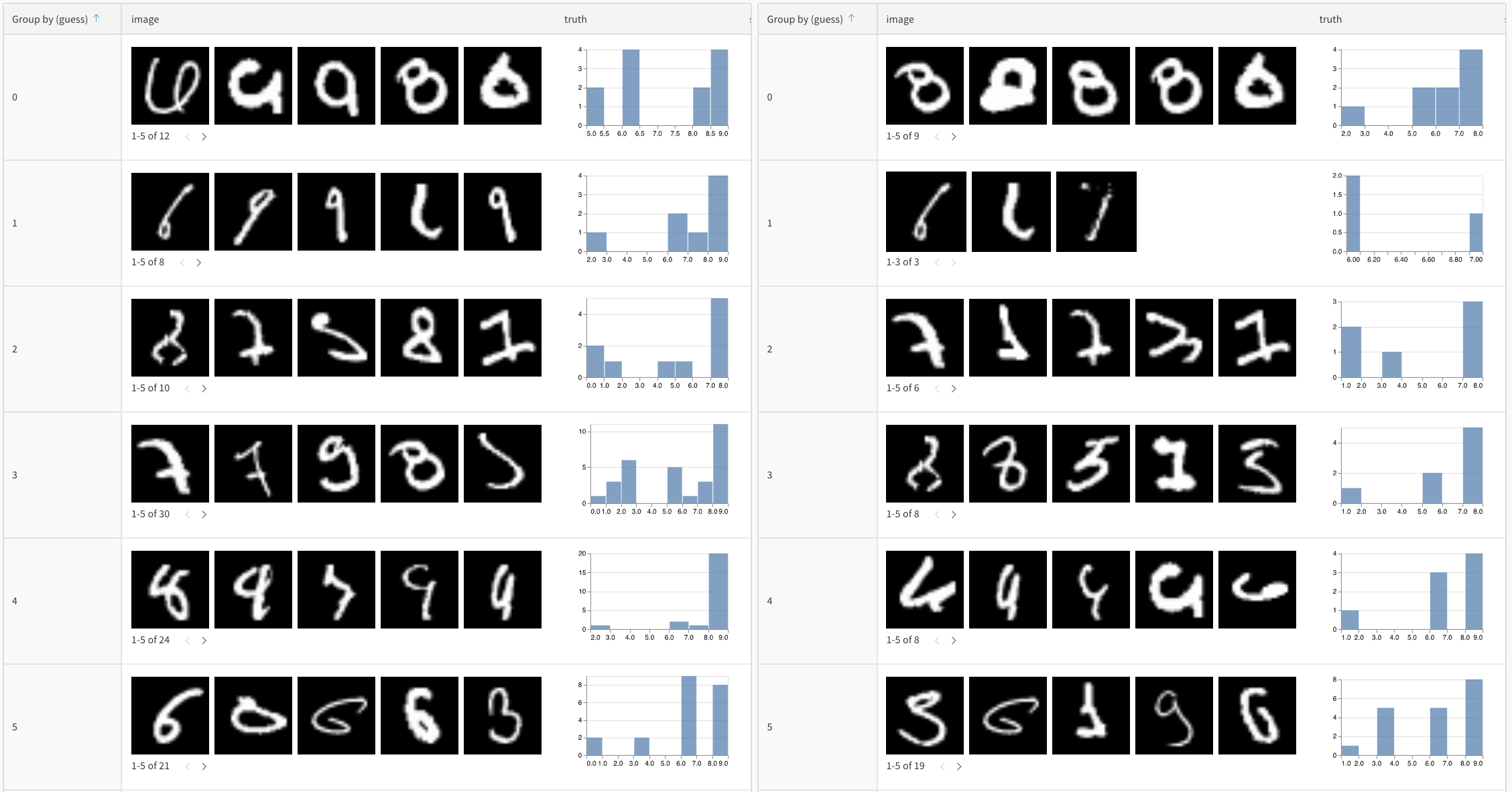

- 에러 분석: 자주 잘못 분류되는 예시와 에러 패턴을 필터링하고 쿼리하여 찾아냅니다

- 리치 미디어 시각화: 이미지, 오디오, 텍스트 등 다양한 미디어 타입을 예측값과 메트릭과 함께 표시합니다

기본 예제: 평가 결과 로깅

고급 테이블 워크플로

여러 모델 비교

시간 경과에 따른 예측 추적

W&B UI에서의 대화형 분석

- 결과 필터링: 열 헤더를 클릭해 예측 정확도, 신뢰도 임계값, 특정 클래스 등으로 필터링합니다

- 테이블 비교: 여러 테이블 버전을 선택해 나란히 비교합니다

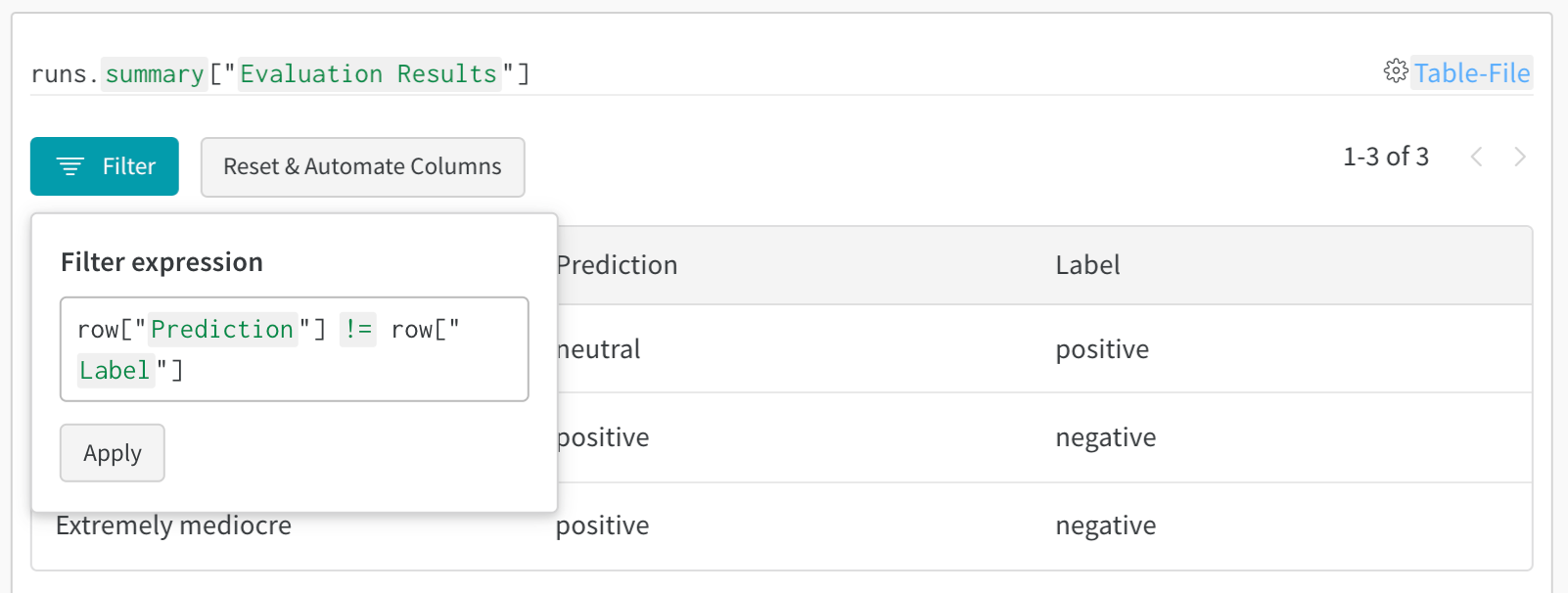

- 데이터 쿼리: 쿼리 바를 사용해 특정 패턴을 찾습니다(예:

"correct" = false AND "confidence" > 0.8) - 그룹 및 집계: 예측된 클래스로 그룹화하여 클래스별 정확도 메트릭을 확인합니다