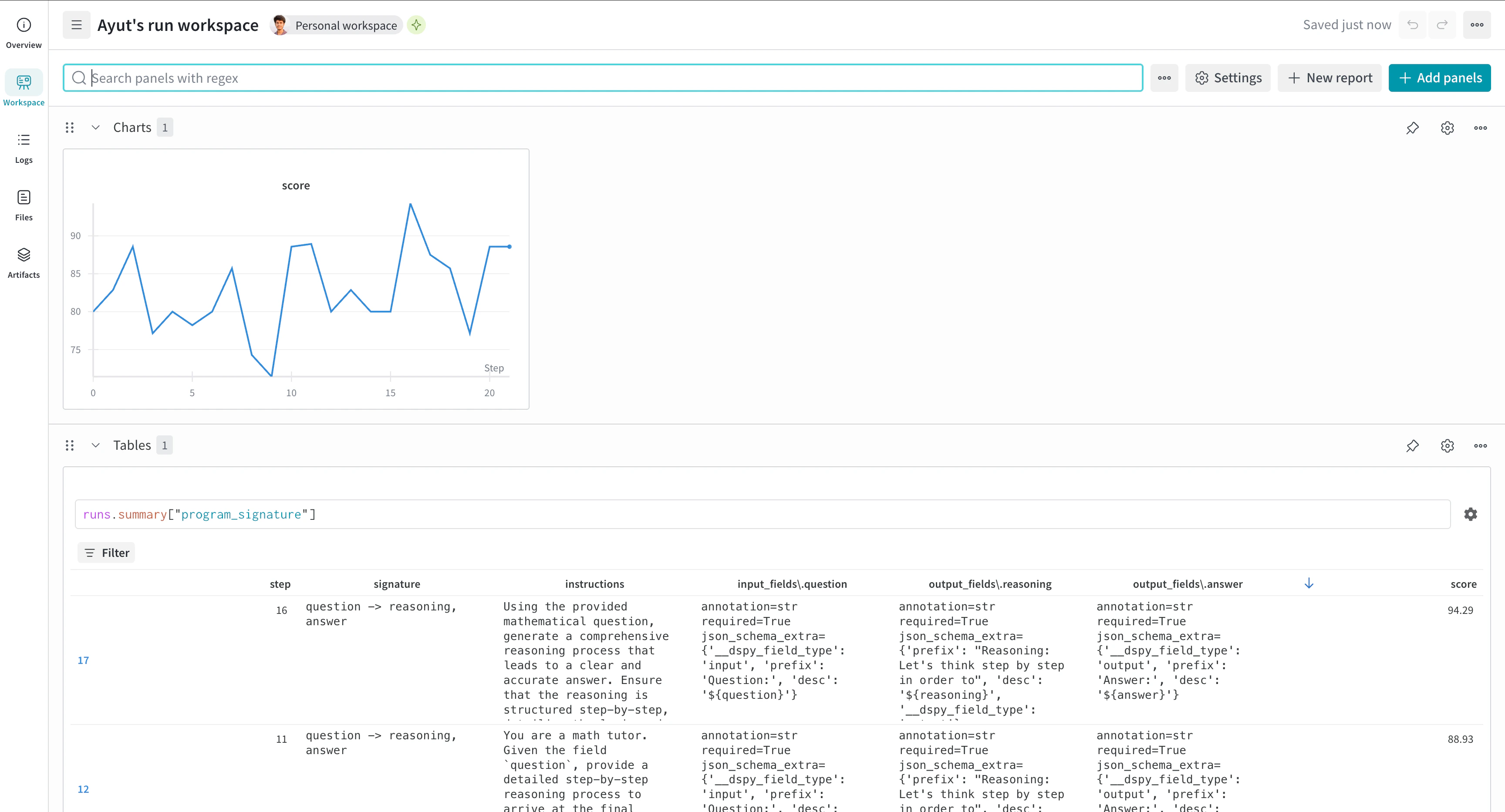

- 시간에 따른 평가 메트릭 추적

- 프로그램 시그니처 변화 확인을 위한 W&B Tables

- MIPROv2와 같은 DSPy 옵티마이저와의 인테그레이션

참고

wandb==0.21.2 및 weave==0.52.5부터는 W&B와 함께 사용할 때 Weave가 자동으로 초기화됩니다:weave를 임포트한 다음wandb.init()를 호출하는 경우(스크립트 환경)wandb.init()를 호출한 뒤 나중에weave를 임포트하는 경우(노트북/Jupyter 환경)

weave.init(...)를 호출할 필요는 없습니다.설치 및 인증

- 명령줄

- Python

- Notebook

-

필요한 라이브러리를 설치합니다:

-

WANDB_API_KEY환경 변수를 설정하고 로그인합니다:

프로그램 최적화 추적 (실험적)

dspy.Evaluate를 사용하는 DSPy 옵티마이저(MIPROv2 등)의 경우 WandbDSPyCallback을 사용해 시간에 따른 평가 메트릭을 기록하고, W&B Tables에서 프로그램 시그니처가 어떻게 변화하는지 추적하세요.

run 객체가 WandbDSPyCallback에 전달되지 않으면 전역 run 객체가 사용됩니다.

예측을 W&B Tables에 기록하기

예측 데이터 액세스

- run의 Overview 페이지로 이동합니다.

predictions_0,predictions_1등과 같은 패턴으로 이름이 지정된 Table 패널을 찾습니다.- 실패 사례를 분석하려면

is_correct로 필터링합니다. - 프로젝트 Workspace에서 여러 run의 테이블을 비교합니다.

example: 입력 데이터prediction: 모델 출력is_correct: Evaluation 결과