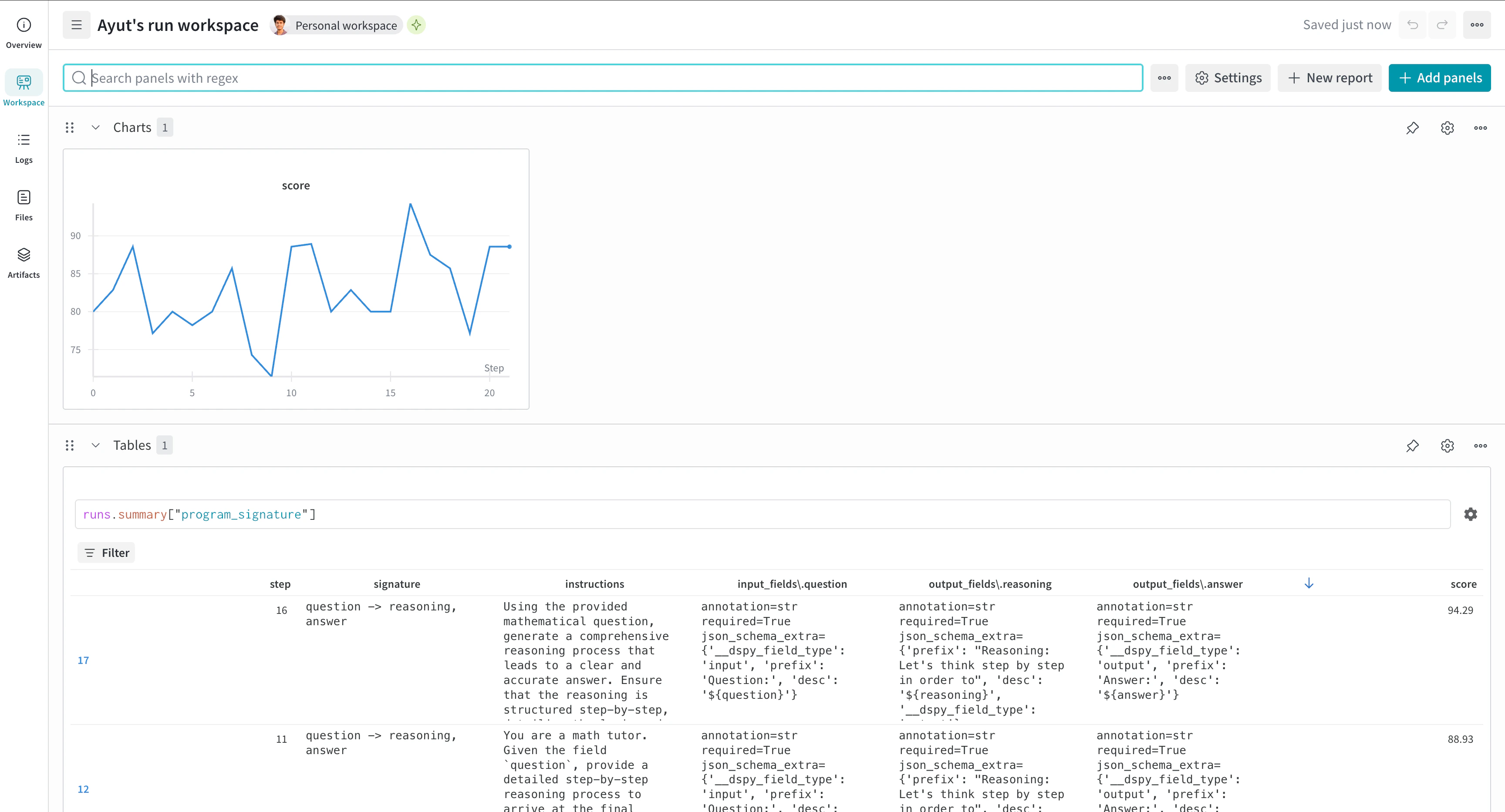

- Le suivi des métriques d’évaluation dans le temps

- W&B Tables pour suivre l’évolution des signatures de programme

- L’intégration avec des optimiseurs DSPy comme MIPROv2

RemarqueDepuis

wandb==0.21.2 et weave==0.52.5, Weave s’initialise automatiquement lorsqu’il est utilisé avec W&B :- Si

weaveest importé, puiswandb.init()est appelé (cas d’un script) - Si

wandb.init()a été appelé, puisweaveest importé plus tard (cas d’un notebook/Jupyter)

weave.init(...) n’est nécessaire.Installer et s’authentifier

- Ligne de commande

- Python

- Notebook

-

Installez les bibliothèques requises :

-

Définissez la variable d’environnement

WANDB_API_KEY, puis connectez-vous :

Suivez l’optimisation du programme (expérimental)

dspy.Evaluate (comme MIPROv2), utilisez WandbDSPyCallback pour journaliser les métriques d’évaluation au fil du temps et suivre l’évolution de la signature du programme dans les W&B Tables.

run n’est passé à WandbDSPyCallback, l’objet global run est utilisé.

Enregistrez les prédictions dans W&B Tables

Accéder aux données de prédiction

- Accédez à la page Aperçu de votre run.

- Recherchez les panneaux de tableau nommés selon un format comme

predictions_0,predictions_1, etc. - Filtrez sur

is_correctpour analyser les échecs. - Comparez les tableaux entre les runs dans l’espace de travail du projet.

example: données d’entréeprediction: sortie du modèleis_correct: résultat de l’évaluation