はじめに

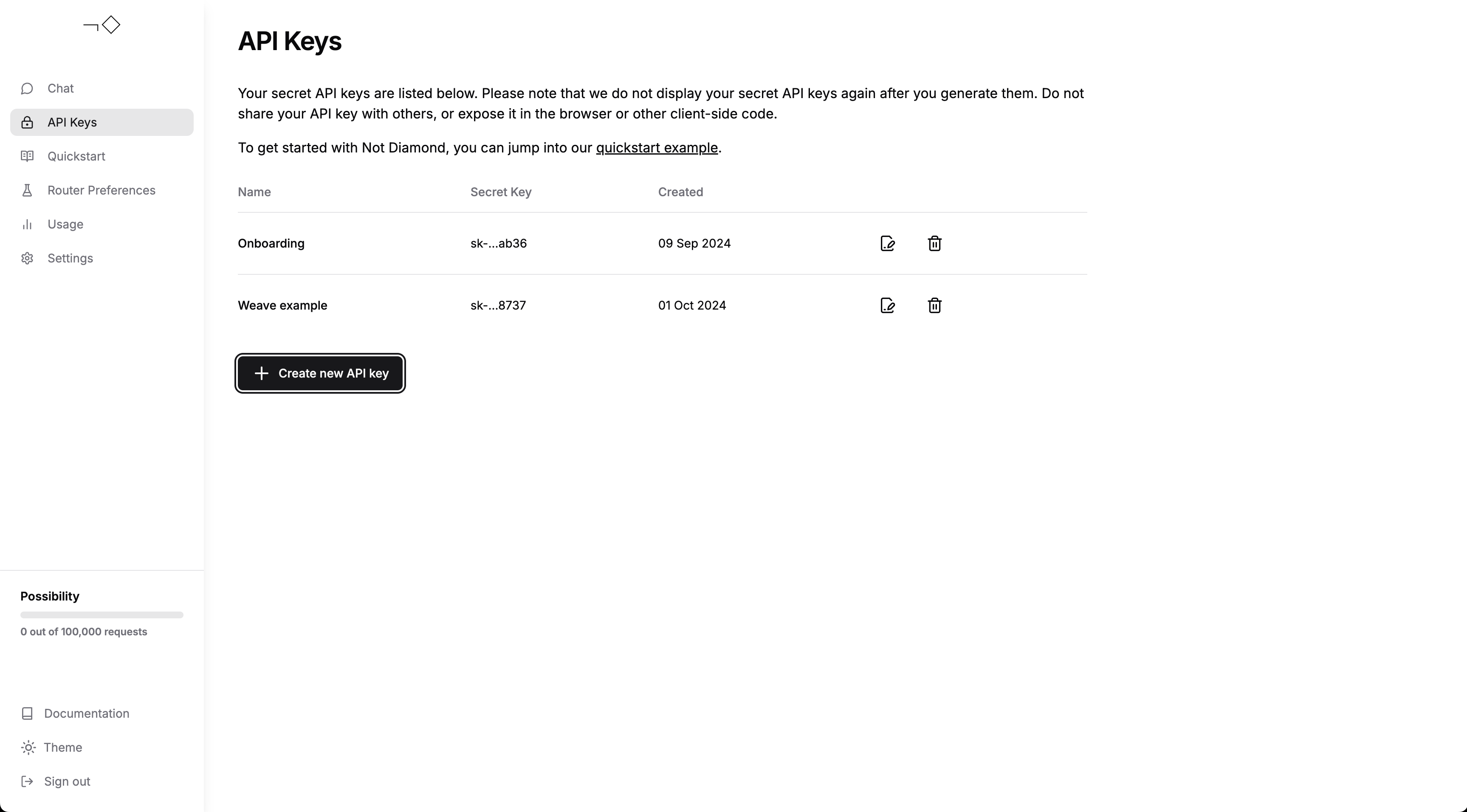

NOTDIAMOND_API_KEY として設定してください。

- [クイックスタートガイド]を試す

- W&B Weave と Not Diamond を使ってカスタムルーターを構築する、または

- Not Diamond とチャットして、ルーティングの動作を確認する

トレース

weave.init() を実行するだけで、その後は通常どおりルーティングされた

プロバイダを使用できます。

カスタムルーティング

model_select リクエストで再利用すると、評価データに対するパフォーマンスを最大化しつつ、コストを最小限に抑えられるようにプロンプトをルーティングできます: