W&B prend en charge l’intégration de TensorBoard pour W&B Multi-tenant SaaS.

Premiers pas

git, la commande de terminal utilisée pour le run, et plus encore.

W&B prend en charge TensorBoard avec toutes les versions de TensorFlow. W&B prend également en charge TensorBoard 1.14 et les versions ultérieures avec PyTorch, ainsi que TensorBoardX.

Questions fréquentes

Comment puis-je consigner dans W&B des métriques qui ne sont pas enregistrées dans TensorBoard ?

wandb.Run.log() dans votre code : run.log({"custom": 0.8})

Le paramètre step dans run.log() est désactivé lors de la synchronisation avec TensorBoard. Si vous souhaitez définir un nombre d’étapes différent, vous pouvez consigner les métriques avec une métrique d’étape, comme suit :

run.log({"custom": 0.8, "global_step": global_step})

Comment puis-je configurer TensorBoard lorsque je l’utilise avec wandb ?

wandb.tensorboard.patch au lieu de passer sync_tensorboard=True à wandb.init.

tensorboard_x=False à cette méthode pour vous assurer que le TensorBoard standard est patché. Si vous utilisez TensorBoard > 1.14 avec PyTorch, vous pouvez passer pytorch=True pour vous assurer qu’il est patché. Ces deux options ont des valeurs par défaut intelligentes selon les versions de ces bibliothèques qui ont été importées.

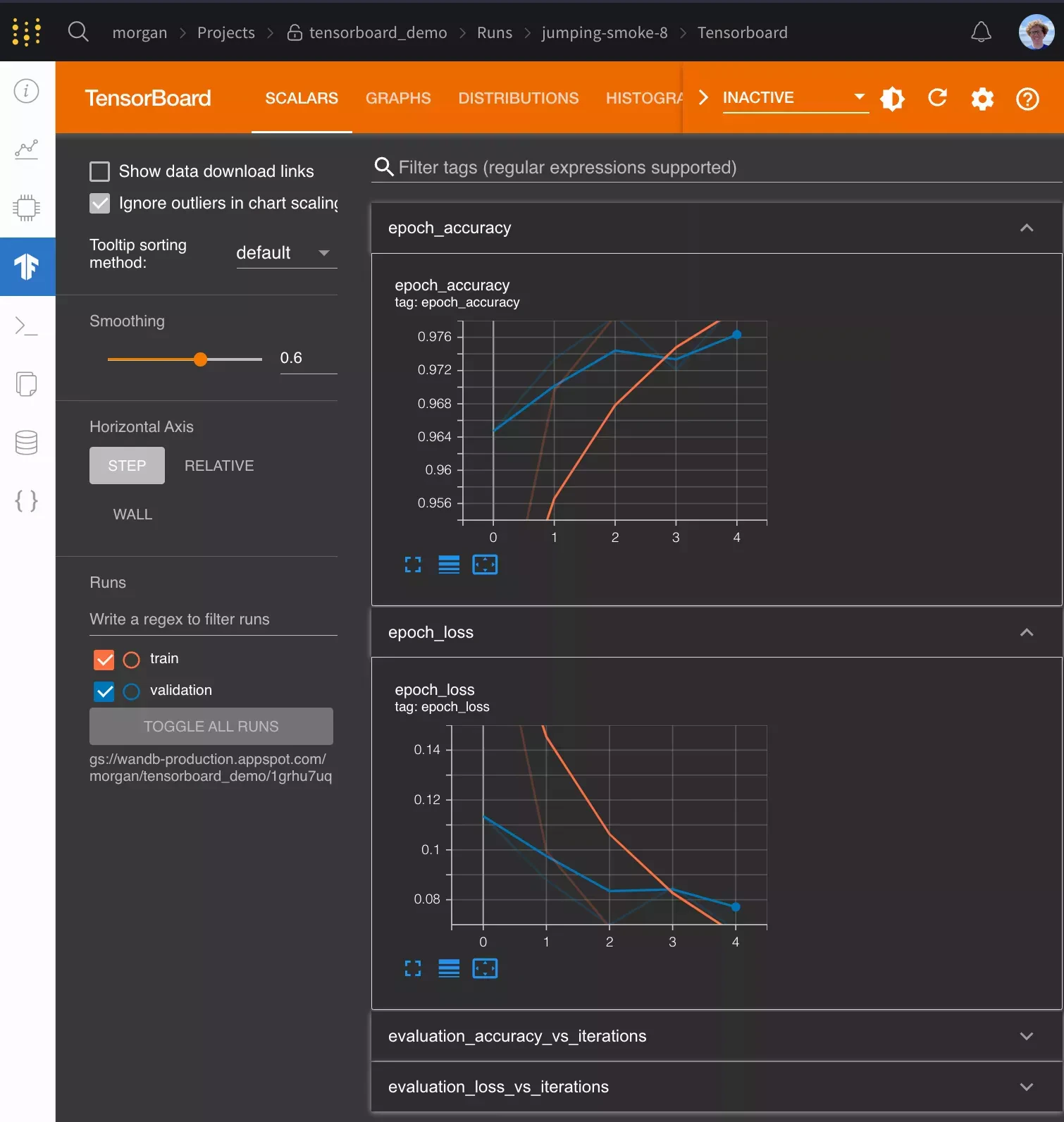

Par défaut, nous synchronisons également les fichiers tfevents ainsi que tous les fichiers .pbtxt. Cela nous permet de lancer une instance TensorBoard pour votre compte. Vous verrez un onglet TensorBoard sur la page du run. Ce comportement peut être désactivé en passant save=False à wandb.tensorboard.patch

Comment puis-je synchroniser d’anciens runs TensorBoard ?

tfevents déjà stockés localement et que vous souhaitez les importer dans W&B, vous pouvez exécuter wandb sync log_dir, où log_dir est un répertoire local contenant les fichiers tfevents.

Comment puis-je utiliser Google Colab ou Jupyter avec TensorBoard ?

wandb.Run.finish() à la fin de votre entraînement. Cela mettra fin au run wandb et importera les journaux TensorBoard dans W&B pour que vous puissiez les visualiser. Cela n’est pas nécessaire lorsque vous exécutez un script .py, car wandb se termine automatiquement à la fin du script.

Pour exécuter des commandes shell dans un environnement de notebook, vous devez les faire précéder d’un !, comme dans !wandb sync directoryname.

Comment puis-je utiliser PyTorch avec TensorBoard ?

Puis-je synchroniser des fichiers tfevents stockés dans le cloud ?

wandb 0.20.0 et les versions ultérieures prennent en charge la synchronisation des fichiers tfevents stockés dans S3, GCS ou Azure. wandb utilise les identifiants par défaut de chaque fournisseur cloud, correspondant aux commandes du tableau suivant :

| Fournisseur cloud | Identifiants | Format du répertoire des journaux |

|---|---|---|

| S3 | aws configure | s3://bucket/path/to/logs |

| GCS | gcloud auth application-default login | gs://bucket/path/to/logs |

| Azure | az login1 | az://account/container/path/to/logs |

Footnotes

-

Vous devez également définir les variables d’environnement

AZURE_STORAGE_ACCOUNTetAZURE_STORAGE_KEY. ↩