wandb inclut un callback spécial pour LightGBM. Il est également facile d’utiliser les fonctionnalités de journalisation génériques de W&B pour suivre des expériences à grande échelle, comme les Sweeps d’hyperparamètres.

Vous cherchez des exemples de code prêts à l’emploi ? Consultez notre dépôt d’exemples sur GitHub.

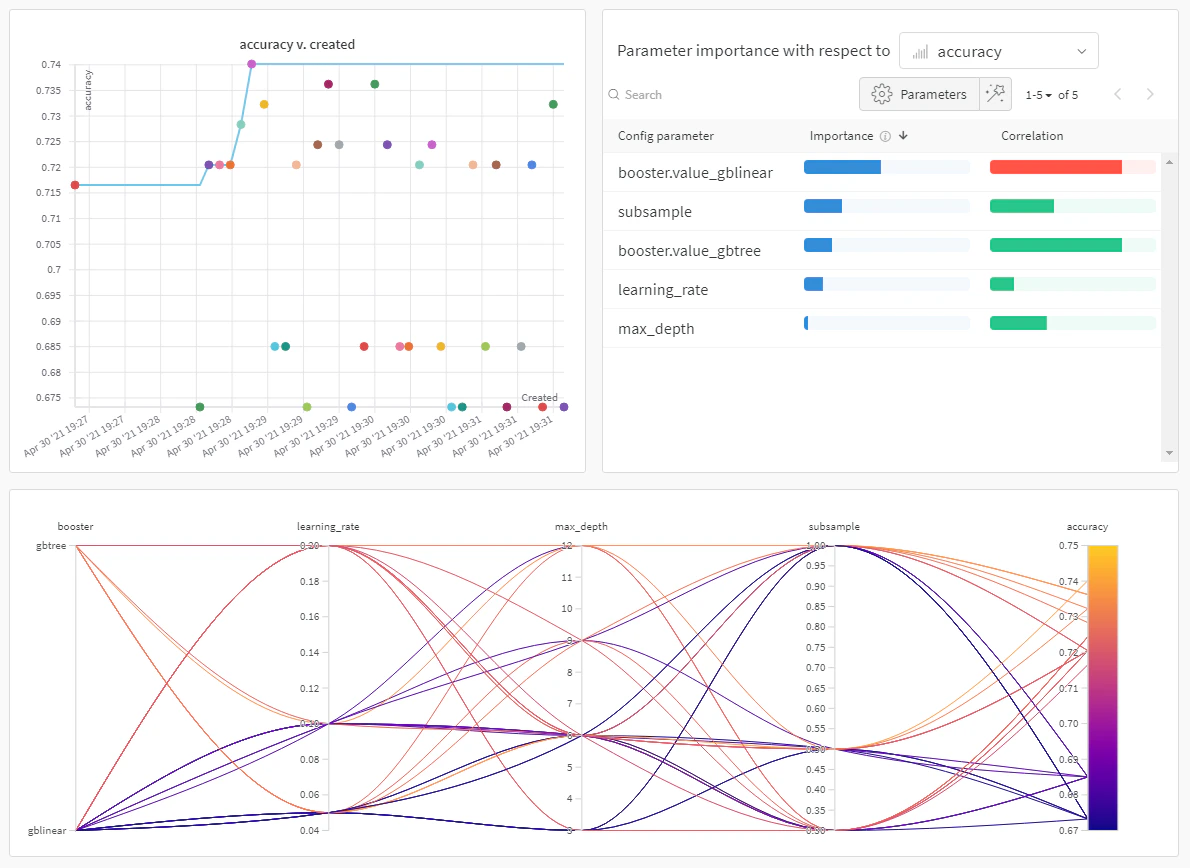

Ajustez vos hyperparamètres avec Sweeps